Topologie de réseau MSP pour débutants

Pour les fournisseurs de services gérés (MSP), la mise en place d’un réseau hautement performant et évolutif est la clé du succès. Dans un précédent article de blog, nous avons abordé les types de topologies réseau de base. Dans cet article, nous examinons des types de topologies réseau plus complexes pour les fournisseurs de services, notamment celles privilégiées pour les réseaux MSP. Lisez cet article de blog pour découvrir quelle topologie est la meilleure pour un centre de données MSP, et pourquoi.

Réseaux hiérarchiques traditionnels à trois niveaux

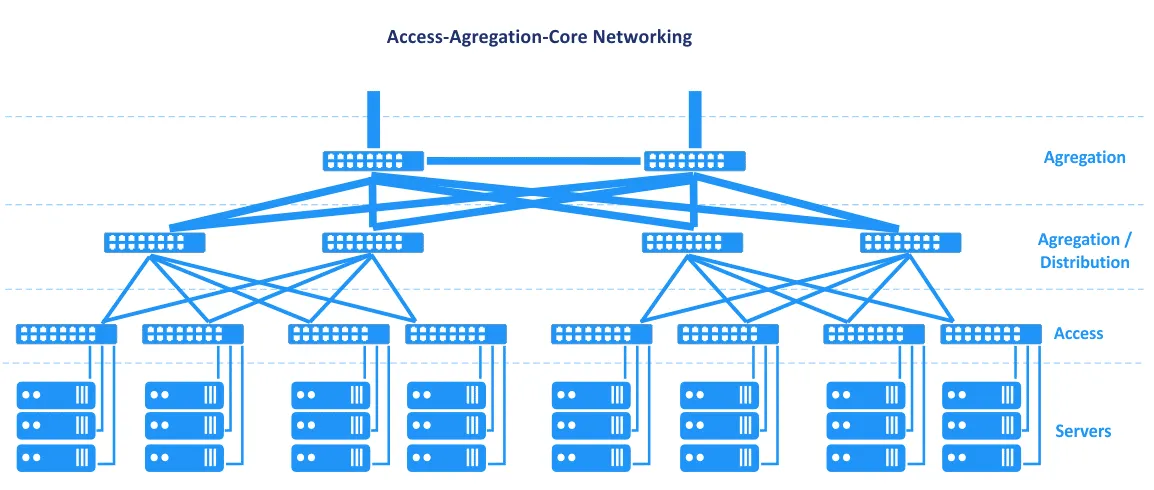

Avant que les réseaux définis par logiciel ne se généralisent, les réseaux dans les centres de données reposaient sur une topologie hiérarchique en arborescence. Cette topologie se décompose en trois couches principales : la couche centrale, la couche d’agrégation ou de distribution et la couche d’accès. Dans cette topologie, les serveurs sont connectés à des commutateurs dans la couche d’accès. Les routeurs périphériques sont connectés au cœur pour fournir un accès depuis/vers le WAN (réseau étendu) et Internet. Ces routeurs sont situés entre le cœur et Internet, comme illustré dans le schéma ci-dessous. En ce qui concerne le modèle OSI (Open Systems Interconnection), qui divise le réseau en une couche liaison de données (L2) et une couche réseau (L3), entre autres, la topologie du réseau d’accès-agrégation-cœur chevauche les couches, comme le montre le graphique.Examinons ces trois couches tour à tour.

En ce qui concerne le modèle OSI (Open Systems Interconnection), qui divise le réseau en une couche liaison de données (L2) et une couche réseau (L3), entre autres, la topologie du réseau d’accès-agrégation-cœur chevauche les couches, comme le montre le graphique.Examinons ces trois couches tour à tour.

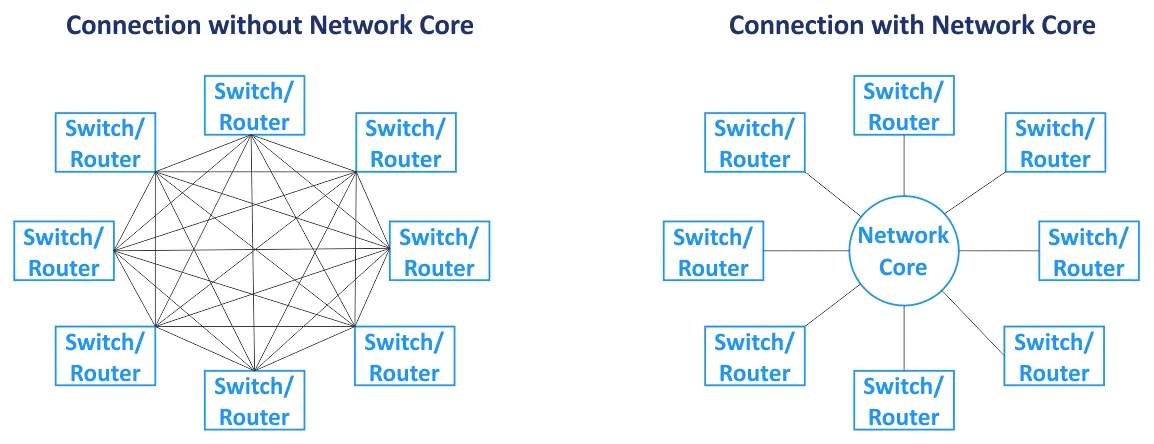

Couche centrale

Le cœur du réseau (également appelé réseau central) est le composant central de l’ensemble du réseau. Les nœuds principaux sont connectés au cœur. Le réseau central est généralement basé sur la topologie de réseau maillé, dans laquelle tous les nœuds sont connectés à tous les autres nœuds au sein du cœur (pour un type de topologie de réseau maillé complet). Les commutateurs et les routeurs du cœur du réseau sont interconnectés par des liaisons à haut débit (également appelées connexions dorsales). Comme des routeurs sont utilisés dans le cœur du réseau, la couche centrale fonctionne avec le trafic L3.

Couche de distribution/agrégation

Il s’agit d’une couche intermédiaire utilisée pour agréger les liaisons montantes de la couche sous-jacente de la topologie réseau à trois niveaux (la couche d’accès, qui fonctionne sur L2) vers la couche centrale du réseau (qui fonctionne généralement sur L3) par l’intermédiaire de liaisons à bande passante plus élevée. La couche de distribution combine un grand nombre de ports à faible débit avec un petit nombre de ports trunk à haut débit. Le routage commence au niveau de la couche de distribution/agrégation de cette topologie réseau lorsque les données sont transférées depuis la couche d’accès. Le pare-feu, l’équilibrage de charge et d’autres configurations de sécurité sont définis au niveau de la couche d’agrégation. La couche d’agrégation/distribution est utilisée pour réduire et simplifier le schéma de câblage dans le centre de données afin de faciliter la gestion. Les commutateurs installés sur la couche d’agrégation doivent prendre en charge le stockage d’un plus grand nombre d’adresses MAC dans la table d’adresses MAC de leur mémoire. Alors que la couche d’accès fonctionne avec le trafic L2, la couche de distribution fonctionne avec le trafic L2 et L3.

Couche d’accès

Cette couche est constituée de commutateurs qui fonctionnent sur L2. Les serveurs et les postes de travail sont connectés aux commutateurs de la couche d’accès. Les VLAN (réseaux locaux virtuels) sont généralement utilisés pour séparer les domaines de diffusion L2 afin de réduire le trafic de diffusion et d’augmenter la sécurité.Pour éviter les goulots d’étranglement, des liaisons plus épaisses sont utilisées plus près du cœur du réseau. Par exemple, les serveurs sont connectés aux commutateurs d’accès par l’intermédiaire d’interfaces réseau 10 Gbit/s, les commutateurs d’accès sont connectés aux commutateurs d’agrégation par l’intermédiaire d’interfaces 10 Gbit/s, et les commutateurs/routeurs de la couche d’agrégation sont connectés aux commutateurs/routeurs du cœur du réseau via des liaisons 100 Gbit/s. Dans ce cas, l’agrégation de liaisons peut être utilisée pour augmenter la bande passante et la redondance. Tout le trafic provenant des serveurs est transféré vers les liaisons montantes. Un ensemble d’équipements réseau intelligents, surnommés « god boxes », se trouve au sommet de la hiérarchie de cette topologie réseau. Les god boxes sont responsables du routage et de tous les autres services. La topologie réseau hiérarchique vous permet de créer un réseau modulaire.Dans la topologie réseau illustrée dans le schéma précédent, la défaillance d’une liaison entraîne la défaillance de ce segment du réseau. C’est la raison pour laquelle des canaux réservés et une redondance sont utilisés pour ce type de topologie réseau (voir le schéma suivant) à chaque couche du réseau. La défaillance d’un appareil ou d’une liaison entraîne une dégradation des performances, mais le réseau continue de fonctionner. Cette topologie réseau redondante nécessite généralement le protocole STP (Spanning Tree Protocol). MAINTENANCE. Si vous déconnectez certains équipements réseau au sommet de cette topologie réseau à trois niveaux afin de mettre à jour des logiciels ou d’effectuer d’autres tâches de maintenance, les performances du réseau se dégradent. Certains services peuvent être temporairement indisponibles.Évolutivité. Le nombre de services exécutés sur les serveurs augmente chaque année, tout comme le volume de trafic. Cette situation nécessite une mise à niveau et une augmentation de la bande passante du réseau MSP. L’augmentation de la bande passante réseau dans un centre de données classique nécessitait généralement les éléments suivants :

MAINTENANCE. Si vous déconnectez certains équipements réseau au sommet de cette topologie réseau à trois niveaux afin de mettre à jour des logiciels ou d’effectuer d’autres tâches de maintenance, les performances du réseau se dégradent. Certains services peuvent être temporairement indisponibles.Évolutivité. Le nombre de services exécutés sur les serveurs augmente chaque année, tout comme le volume de trafic. Cette situation nécessite une mise à niveau et une augmentation de la bande passante du réseau MSP. L’augmentation de la bande passante réseau dans un centre de données classique nécessitait généralement les éléments suivants :

- Augmentation des connexions LAG (Link Aggregation Group)

- Achat de cartes réseau

- S’il n’y a pas de slots disponibles pour installer des cartes réseau, acheter de nouveaux serveurs ou du matériel connexe

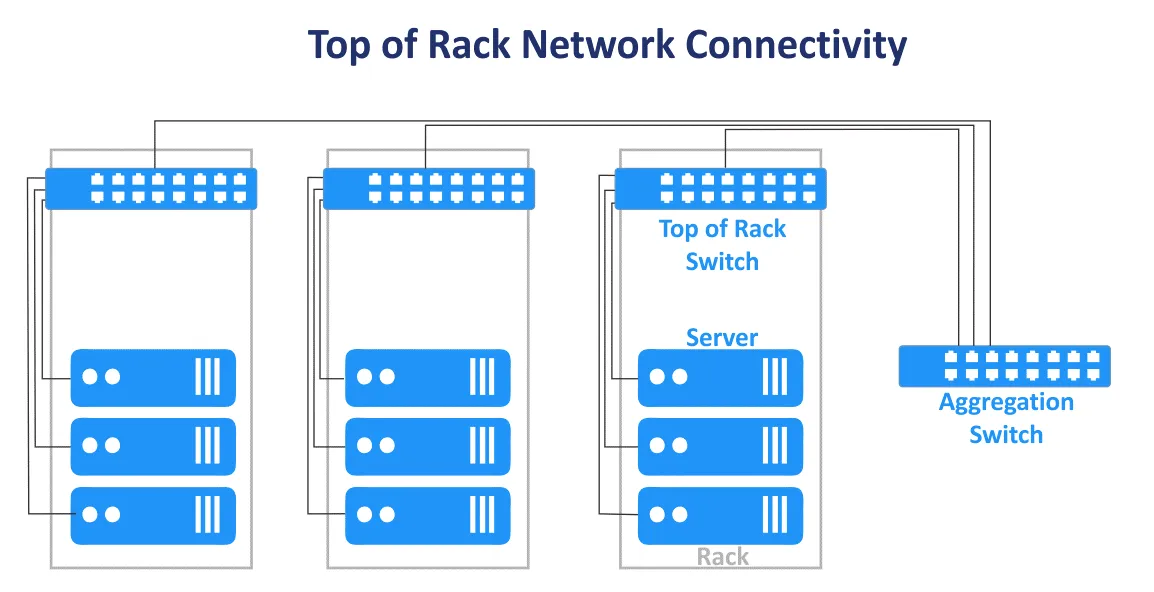

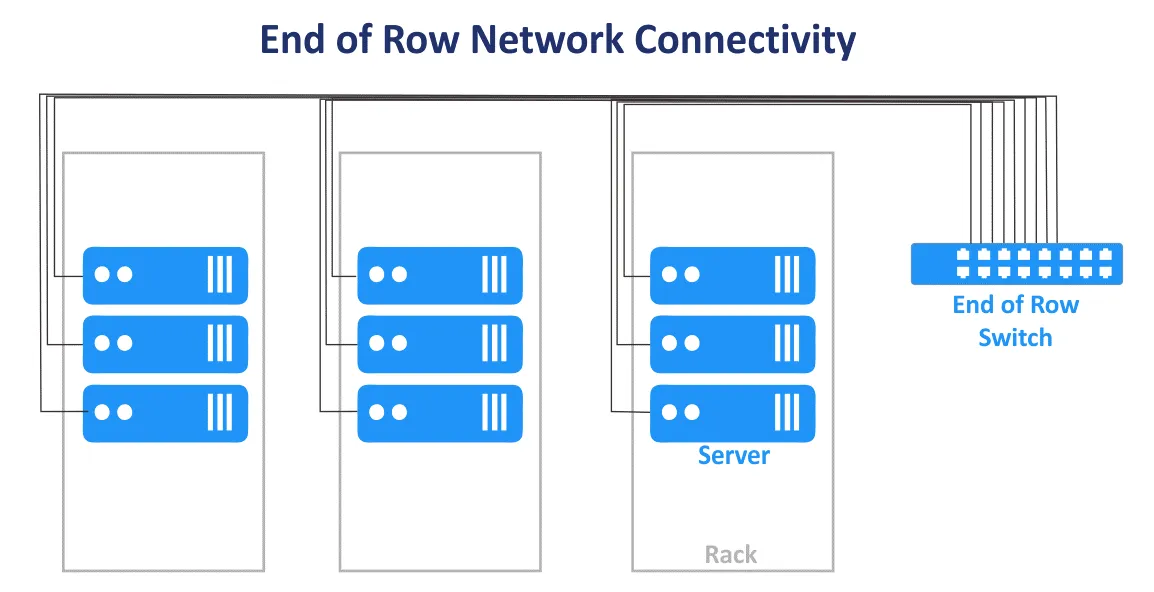

Si vous devez ajouter un nouveau rack de serveurs (cabine rack) en tant que nouveau module dans votre centre de données, vous pouvez augmenter la bande passante réseau vers ce rack et les serveurs qui y sont installés. Ce type de topologies réseau ne peut pas garantir un niveau élevé de réservation de liaison et de redondance en raison des fonctionnalités du protocole L2 telles que STP et MSTP (Multiple Spanning Tree Protocol).La topologie réseau classique à trois niveaux dans un centre de données peut être combinée avec les conceptions End of Row et Top of Rack. Le schéma de connexion Top of Rack est désormais plus populaire. Ce nom est utilisé car les serveurs et les commutateurs sont connectés au commutateur principal de chaque rack. Les commutateurs Top of Rack (commutateurs ToR) sont connectés aux commutateurs/routeurs des niveaux supérieurs du réseau MSP. Les commutateurs ToR sont différents des commutateurs périphériques utilisateur et disposent de plusieurs ports uplink à très haut débit (tels que des ports 10 Gbit/s) et d’un nombre élevé de ports pour connecter les serveurs. Les commutateurs ToR sont installés par paires pour assurer la redondance et permettre la maintenance des commutateurs. Les avantages de ce schéma de connexion ToR sont la longueur réduite des câbles lors du câblage des appliances dans un rack et entre les racks. Les commutateurs d’accès de la topologie de réseau hiérarchique à plusieurs niveaux sont généralement utilisés comme commutateurs ToR.

Sens de circulation

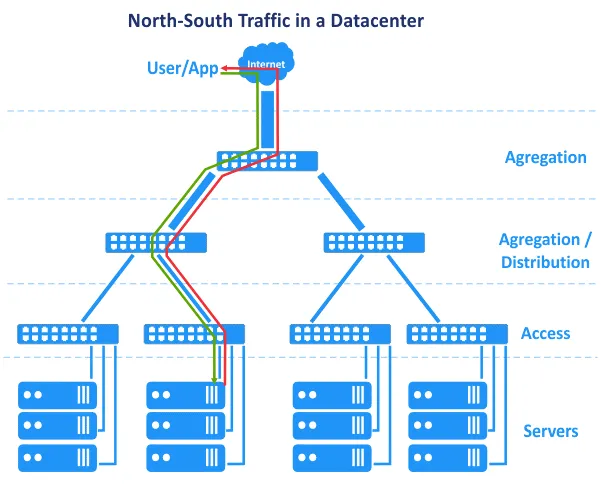

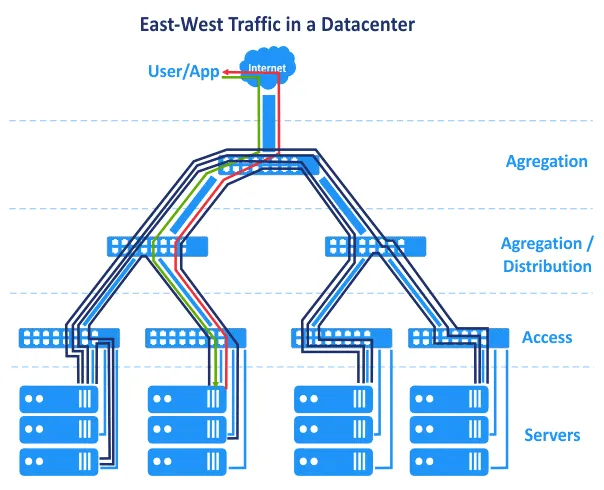

Les inconvénients précédemment évoqués ne sont pas trop graves, et un réseau de centre de données peut fonctionner correctement avec une administration adéquate. Le passage de L2 à L3 dans une partie du réseau permet de résoudre un certain nombre de problèmes. Il existe une autre fonctionnalité liée à l’évolution des centres de données et à la manière dont les applications fonctionnent aujourd’hui, qui diffère de ce qui se faisait auparavant. Dans les années 2000, les applications étaient créées à l’aide d’une architecture centralisée, et les applications de l’architecture client-serveur étaient principalement monolithiqueCela signifie que les composants d’une application peuvent être situés sur un seul serveur. Par conséquent, dans notre schéma, la requête utilisateur a été envoyée depuis le sommet du réseau, et la requête générée par l’application a été renvoyée depuis le niveau inférieur du serveur vers le sommet du réseau. La requête utilisateur a été traitée sur un seul hôte. Le trafic horizontal (est-ouest) entre les hôtes était minime, et le trafic nord-sud était privilégié. La topologie réseau traditionnelle hiérarchique à plusieurs niveaux utilisée pour les réseaux MSP dans les centres de données répond à ces conditions à remplir. Cependant, au fil du temps, de nouvelles architectures ont été privilégiées lors du développement d’applications. Architecture en couches N-tiers. Les composants d’application sont répartis sur plusieurs niveaux, par exemple le niveau logique, le niveau présentation et le niveau données. Les applications Web qui comportent plusieurs composants nécessitent que ces composants s’exécutent sur différents serveurs, par exemple un serveur Web, un serveur d’applications et serveur de base de donnéesLes composants d’application fonctionnant sur plusieurs serveurs interagissent entre eux via un réseau.Architecture microservice suppose que les composants d’une application (services) s’exécutent dans des conteneurs distincts, isolés logiquement, qui sont connectés les uns aux autres via un réseau. Conteneurs peut fonctionner sur différents hôtes dans grappesCette architecture est hautement évolutive et largement utilisée dans les clouds aujourd’hui.De plus, les centres de données fonctionnent désormais avec le Big Data, les bases de données volumineuses, l’analyse, la publicité contextuelle, les applications basées sur l’intelligence artificielle et d’autres logiciels qui nécessitent une interconnexion avec plusieurs serveurs, baies de stockage, machines virtuelles ou conteneurs. Les composants des applications sont répartis sur plusieurs serveurs ou VMs dans le centre de données.Par conséquent, le trafic est-ouest est plus important que le trafic nord-sud dans le réseau MSP. Le trafic interne d’un réseau de centre de données (trafic intra-DC) est plus important que le trafic provenant/à destination d’un utilisateur externe qui envoie une requête au centre de données. N’oubliez pas le trafic interne entre les systèmes de stockage, réplication de base de données, la sauvegarde des données et d’autres activités de service utilisant le réseau dans un centre de données.

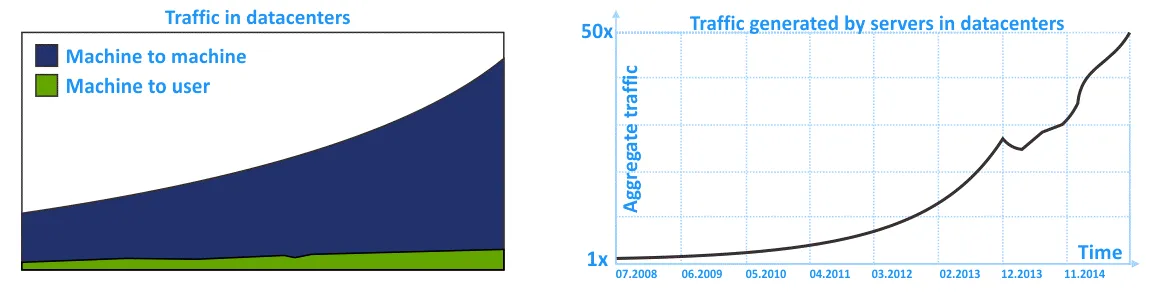

Architecture en couches N-tiers. Les composants d’application sont répartis sur plusieurs niveaux, par exemple le niveau logique, le niveau présentation et le niveau données. Les applications Web qui comportent plusieurs composants nécessitent que ces composants s’exécutent sur différents serveurs, par exemple un serveur Web, un serveur d’applications et serveur de base de donnéesLes composants d’application fonctionnant sur plusieurs serveurs interagissent entre eux via un réseau.Architecture microservice suppose que les composants d’une application (services) s’exécutent dans des conteneurs distincts, isolés logiquement, qui sont connectés les uns aux autres via un réseau. Conteneurs peut fonctionner sur différents hôtes dans grappesCette architecture est hautement évolutive et largement utilisée dans les clouds aujourd’hui.De plus, les centres de données fonctionnent désormais avec le Big Data, les bases de données volumineuses, l’analyse, la publicité contextuelle, les applications basées sur l’intelligence artificielle et d’autres logiciels qui nécessitent une interconnexion avec plusieurs serveurs, baies de stockage, machines virtuelles ou conteneurs. Les composants des applications sont répartis sur plusieurs serveurs ou VMs dans le centre de données.Par conséquent, le trafic est-ouest est plus important que le trafic nord-sud dans le réseau MSP. Le trafic interne d’un réseau de centre de données (trafic intra-DC) est plus important que le trafic provenant/à destination d’un utilisateur externe qui envoie une requête au centre de données. N’oubliez pas le trafic interne entre les systèmes de stockage, réplication de base de données, la sauvegarde des données et d’autres activités de service utilisant le réseau dans un centre de données. Les diagrammes suivants illustrent graphiquement l’augmentation du trafic interne dans les réseaux MSP au sein des centres de données au cours des dernières années. La tendance montre que le trafic intra-DC augmente davantage que le trafic entrant/sortant.

Les diagrammes suivants illustrent graphiquement l’augmentation du trafic interne dans les réseaux MSP au sein des centres de données au cours des dernières années. La tendance montre que le trafic intra-DC augmente davantage que le trafic entrant/sortant. Les réseaux traditionnels, construits selon la topologie hiérarchique à trois niveaux, sont fiables mais ne sont pas adaptés de manière optimale aux flux de trafic latéraux. Cela s’explique par l’importance accordée à la mise en réseau L2 et au trafic nord-sud.

Les réseaux traditionnels, construits selon la topologie hiérarchique à trois niveaux, sont fiables mais ne sont pas adaptés de manière optimale aux flux de trafic latéraux. Cela s’explique par l’importance accordée à la mise en réseau L2 et au trafic nord-sud.

Topologie du réseau Clos

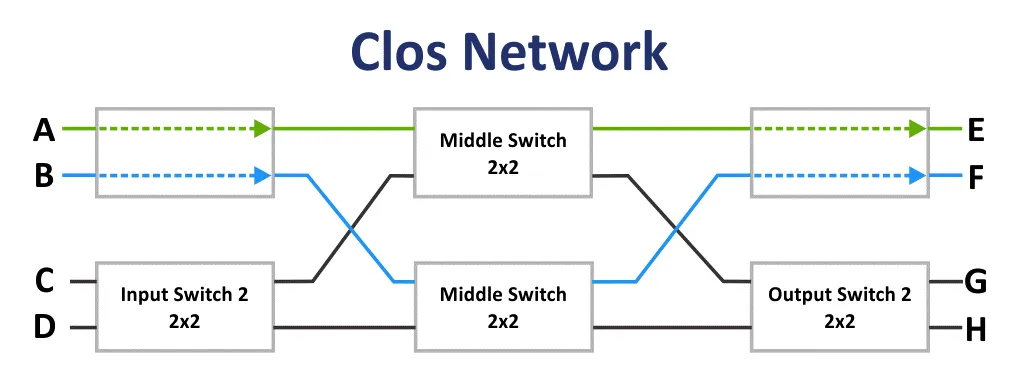

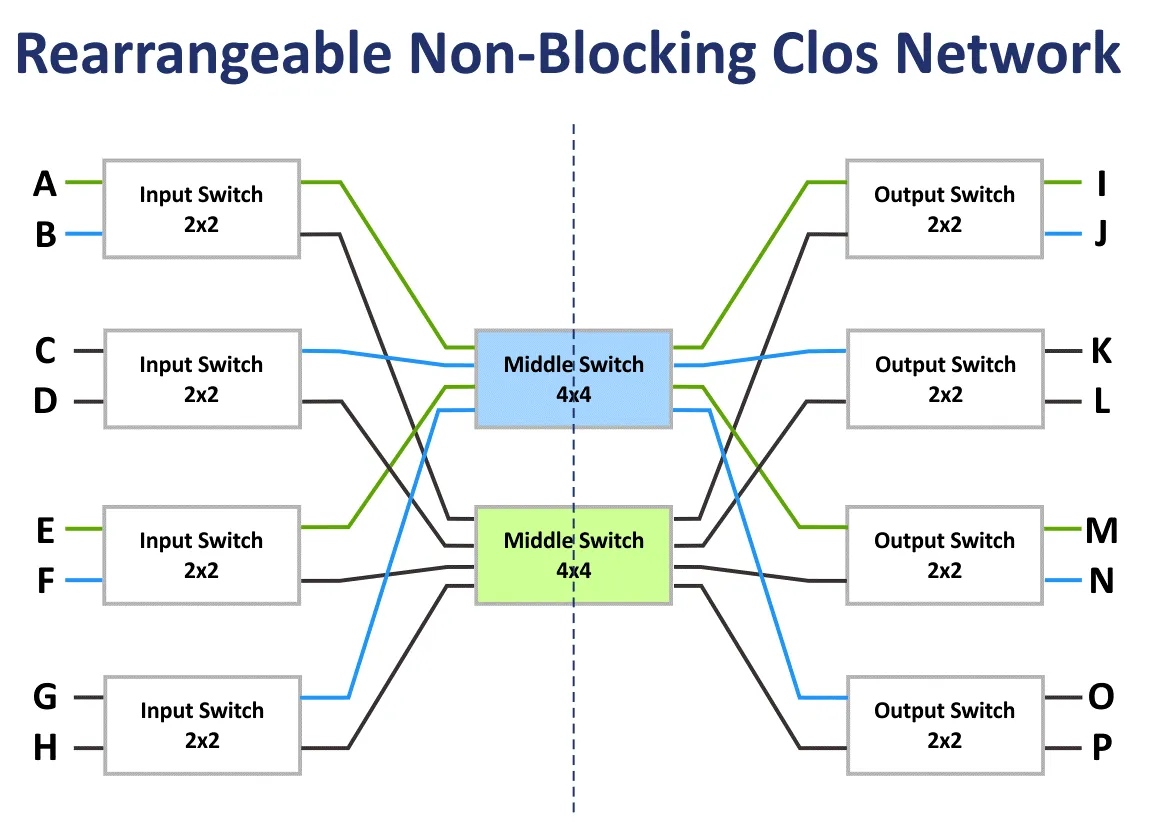

Au départ, le réseau Clos a été inventé par Edson Erwin en 1938. En 1953, Charles Clos a décidé d’utiliser des réseaux de commutation non bloquants dans les systèmes téléphoniques afin de rationaliser l’utilisation des communications par rapport au schéma de communication à barres croisées. Avec des matrices comportant un faible nombre d’interconnexions, d’entrées et de sorties, le schéma de connexion semble difficile à première vue. Cependant, le réseau Clos est moins complexe en raison d’un nombre réduit de points de connexion selon la formule suivante : 6n^(3/2)-3nCe fait devient évident à partir de 36 points de connexion. Si m est le nombre de commutateurs d’entrée et n est le nombre de commutateurs de sortie, alors les caractéristiques de blocage du réseau Clos sont calculées par la formule. Selon le théorème de Clos, un réseau Clos est strictement non bloquant si le nombre de commutateurs de deuxième niveau m ≥ 2n−1.Le réseau de blocage est un réseau dans lequel il est impossible de trouver un chemin de communication entre un port d’entrée libre et un port de sortie libre.Le réseau non bloquant est le réseau dans lequel il existe toujours un chemin permettant de connecter n’importe quel port d’entrée et de sortie. Les réseaux non bloquants sont créés par l’ajout d’un étage de commutation supplémentaire.Le réseau réorganisable sans blocage est le réseau dans lequel tous les chemins possibles pour connecter tous les ports d’entrée et de sortie peuvent être réorganisés.

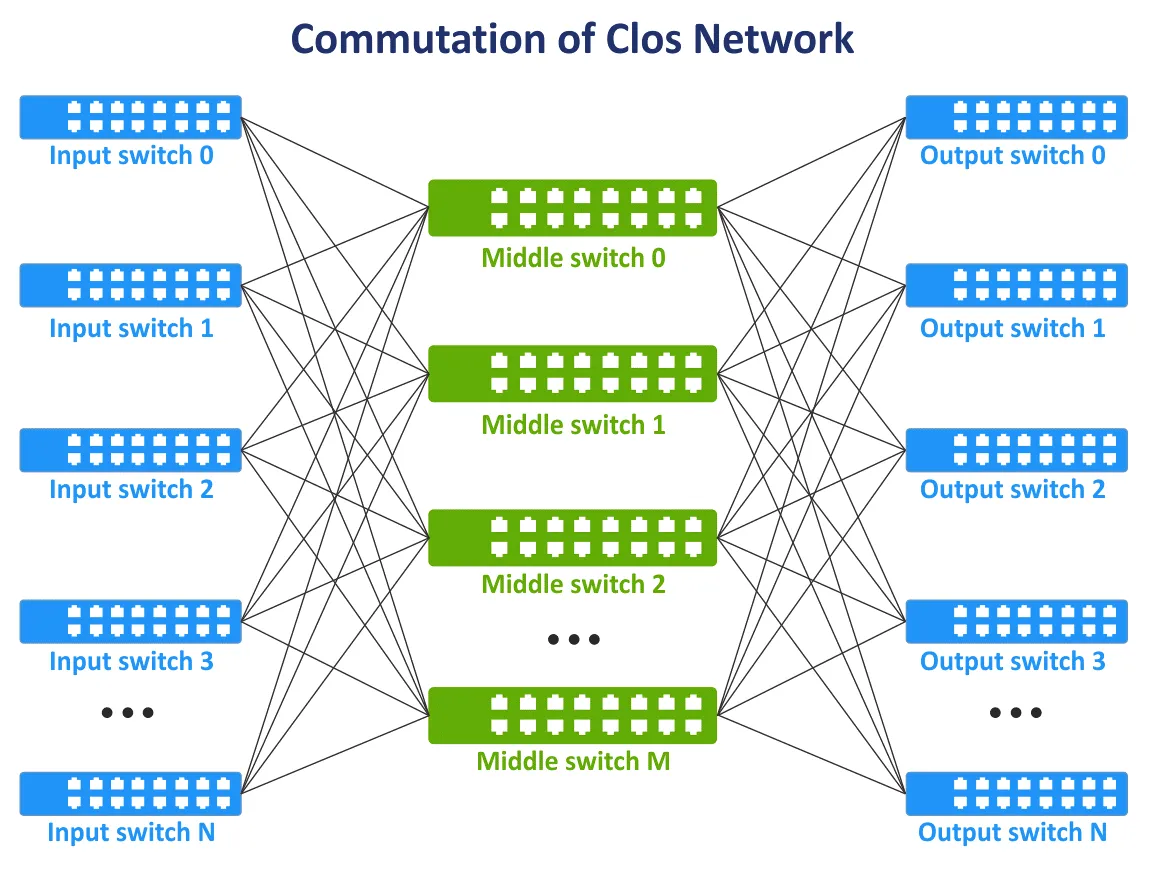

Si m est le nombre de commutateurs d’entrée et n est le nombre de commutateurs de sortie, alors les caractéristiques de blocage du réseau Clos sont calculées par la formule. Selon le théorème de Clos, un réseau Clos est strictement non bloquant si le nombre de commutateurs de deuxième niveau m ≥ 2n−1.Le réseau de blocage est un réseau dans lequel il est impossible de trouver un chemin de communication entre un port d’entrée libre et un port de sortie libre.Le réseau non bloquant est le réseau dans lequel il existe toujours un chemin permettant de connecter n’importe quel port d’entrée et de sortie. Les réseaux non bloquants sont créés par l’ajout d’un étage de commutation supplémentaire.Le réseau réorganisable sans blocage est le réseau dans lequel tous les chemins possibles pour connecter tous les ports d’entrée et de sortie peuvent être réorganisés. À la fin des années 1990, avec l’évolution des technologies de télécommunication et des réseaux informatiques, le concept des réseaux Clos a retrouvé toute sa pertinence. Il est nécessaire que tous les nœuds communiquent entre eux dans la structure du réseau et, si possible, de ne pas utiliser la topologie maillée complète lorsque tous les appareils sont interconnectés. Une nouvelle couche de communication a été ajoutée pour interconnecter les appliances réseau. Le concept de réseau Clos a ainsi été relancé sous une nouvelle forme. L’image suivante présente un schéma type du réseau Clos à trois couches.

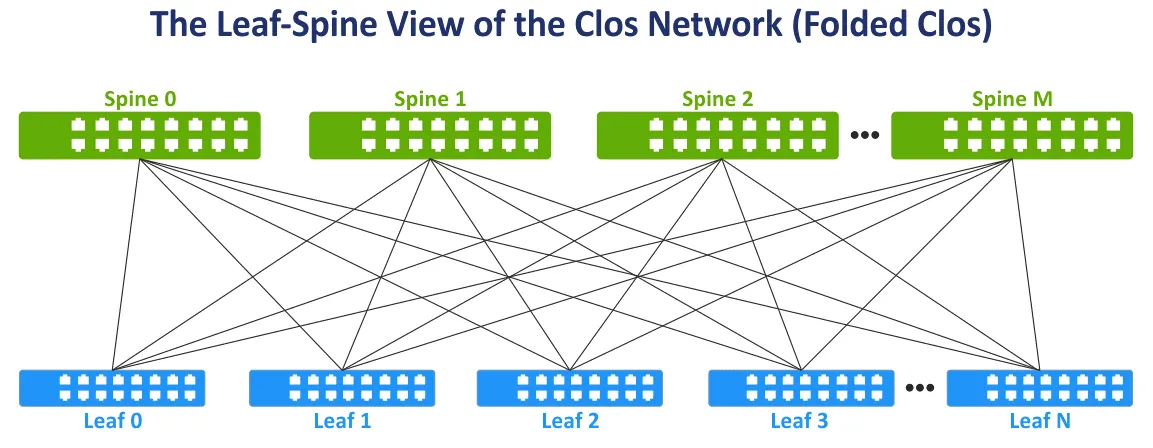

À la fin des années 1990, avec l’évolution des technologies de télécommunication et des réseaux informatiques, le concept des réseaux Clos a retrouvé toute sa pertinence. Il est nécessaire que tous les nœuds communiquent entre eux dans la structure du réseau et, si possible, de ne pas utiliser la topologie maillée complète lorsque tous les appareils sont interconnectés. Une nouvelle couche de communication a été ajoutée pour interconnecter les appliances réseau. Le concept de réseau Clos a ainsi été relancé sous une nouvelle forme. L’image suivante présente un schéma type du réseau Clos à trois couches. Modifions la vue du réseau Clos pour obtenir la vue Leaf-Spine largement utilisée, plus pratique, en repliant les côtés gauche et droit du schéma. Cette topologie de réseau est connue sous les noms de Leaf-Spine, Folded Clos et réseau Clos à 3 niveaux (voir l’image suivante).La couche vertébrale. Les commutateurs spine sont utilisés pour interconnecter tous les commutateurs leaf dans la topologie de réseau maillé complet. La couche spine remplace, dans une certaine mesure, la couche d’agrégation utilisée dans la topologie de réseau hiérarchique traditionnelle à trois niveaux. Mais la couche spine n’est pas l’équivalent direct de la couche d’agrégation. La tâche principale de la couche spine est le transfert rapide des données d’un leaf à un autre. Les appliances ne sont pas connectées aux commutateurs spine.La couche foliaire. Dans ce modèle, les serveurs ou autres appliances du centre de données sont connectés aux feuilles. Toutes les feuilles sont connectées à toutes les épines. Il en résulte un nombre élevé de connexions réseau avec une bande passante égale entre tous les serveurs. Il existe des connexions L3 entre les spines et les feuilles (L3 dans le modèle OSI).Lorsque le trafic est transmis de la source à la destination dans le réseau, le nombre de sauts est le même (par exemple, trois sauts sont nécessaires pour transférer des données entre n’importe quels serveurs au sein du réseau feuille-spine à deux niveaux du schéma suivant). La latence est prévisible et faible. La capacité du réseau est également augmentée, car il n’est plus nécessaire d’utiliser le protocole STP. Lorsque le protocole STP est utilisé pour les connexions redondantes entre les commutateurs, une seule liaison peut être active à la fois.Dans la topologie de réseau feuille-épine, le protocole de routage ECMP (Equal-Cost Multipath) peut être utilisé pour équilibrer la charge du trafic et empêcher les boucles réseau (pour les connexions réseau L3). Les protocoles BGP, OSPF, EIGRP et ISIS peuvent également être utilisés.

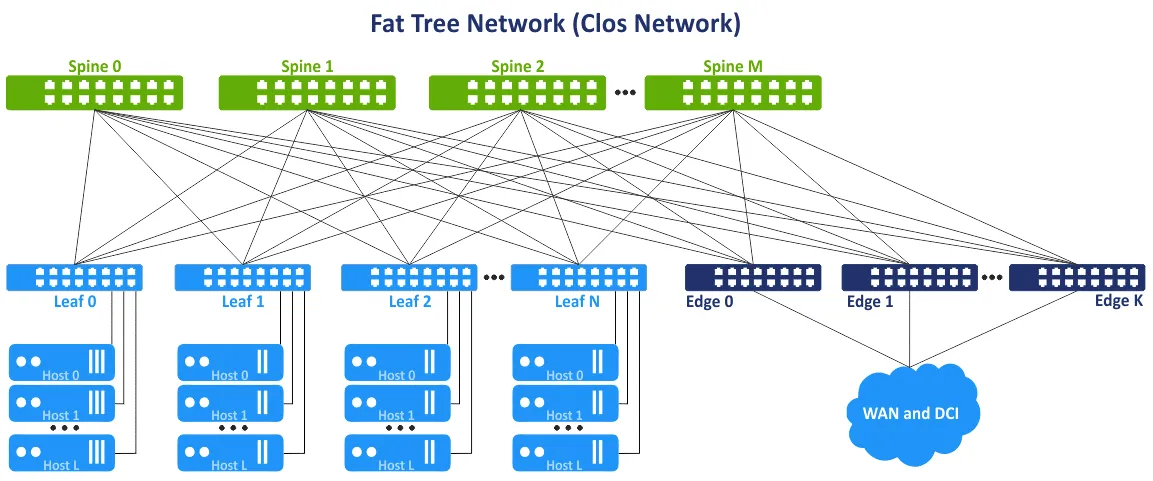

Modifions la vue du réseau Clos pour obtenir la vue Leaf-Spine largement utilisée, plus pratique, en repliant les côtés gauche et droit du schéma. Cette topologie de réseau est connue sous les noms de Leaf-Spine, Folded Clos et réseau Clos à 3 niveaux (voir l’image suivante).La couche vertébrale. Les commutateurs spine sont utilisés pour interconnecter tous les commutateurs leaf dans la topologie de réseau maillé complet. La couche spine remplace, dans une certaine mesure, la couche d’agrégation utilisée dans la topologie de réseau hiérarchique traditionnelle à trois niveaux. Mais la couche spine n’est pas l’équivalent direct de la couche d’agrégation. La tâche principale de la couche spine est le transfert rapide des données d’un leaf à un autre. Les appliances ne sont pas connectées aux commutateurs spine.La couche foliaire. Dans ce modèle, les serveurs ou autres appliances du centre de données sont connectés aux feuilles. Toutes les feuilles sont connectées à toutes les épines. Il en résulte un nombre élevé de connexions réseau avec une bande passante égale entre tous les serveurs. Il existe des connexions L3 entre les spines et les feuilles (L3 dans le modèle OSI).Lorsque le trafic est transmis de la source à la destination dans le réseau, le nombre de sauts est le même (par exemple, trois sauts sont nécessaires pour transférer des données entre n’importe quels serveurs au sein du réseau feuille-spine à deux niveaux du schéma suivant). La latence est prévisible et faible. La capacité du réseau est également augmentée, car il n’est plus nécessaire d’utiliser le protocole STP. Lorsque le protocole STP est utilisé pour les connexions redondantes entre les commutateurs, une seule liaison peut être active à la fois.Dans la topologie de réseau feuille-épine, le protocole de routage ECMP (Equal-Cost Multipath) peut être utilisé pour équilibrer la charge du trafic et empêcher les boucles réseau (pour les connexions réseau L3). Les protocoles BGP, OSPF, EIGRP et ISIS peuvent également être utilisés. Ce concept de réseau est également appelé topologie de réseau multicouche en arbre gras. L’idée est d’éviter les goulots d’étranglement dans les couches supérieures de l’arbre (proches de la racine) et d’ajouter des liaisons supplémentaires pour augmenter la bande passante à ces segments. Il en résulte une capacité de liaison croissante vers la racine. L’arbre gras est un cas particulier du réseau Clos. Le réseau Clos à trois niveaux est transformé en un réseau feuille-épine à deux niveaux après pliage. Des commutateurs feuille ou des commutateurs/routeurs feuille peuvent être utilisés pour accéder à des réseaux externes et à d’autres centres de données.

Ce concept de réseau est également appelé topologie de réseau multicouche en arbre gras. L’idée est d’éviter les goulots d’étranglement dans les couches supérieures de l’arbre (proches de la racine) et d’ajouter des liaisons supplémentaires pour augmenter la bande passante à ces segments. Il en résulte une capacité de liaison croissante vers la racine. L’arbre gras est un cas particulier du réseau Clos. Le réseau Clos à trois niveaux est transformé en un réseau feuille-épine à deux niveaux après pliage. Des commutateurs feuille ou des commutateurs/routeurs feuille peuvent être utilisés pour accéder à des réseaux externes et à d’autres centres de données.

Avantages de la topologie réseau en épine de feuille

La topologie réseau feuille-épine offre un ensemble d’avantages par rapport à la topologie réseau accès-agrégation-cœur. Cet ensemble d’avantages est la raison pour utiliser la topologie réseau feuille-épine dans un centre de données.Connexions optimisées. Les liaisons à large bande passante entre les appliances réseau sont optimales pour le trafic est-ouest. Il n’y a pas de liaisons inutilisées (car L3 est utilisé à la place de L2). ECMP est recommandé pour une efficacité élevée, et STP n’est pas nécessaire.Fiabilité. La défaillance d’une appliance ou la déconnexion d’une liaison n’entraîne pas de conséquences négatives ni d’inconvénients significatifs. Si le commutateur ToR qui fait office de commutateur leaf tombe en panne, le rack correspondant est affecté. Si un commutateur spine tombe en panne, la bande passante du réseau se dégrade, mais pas de manière significative par rapport à la topologie réseau hiérarchique traditionnelle à trois niveaux. La dégradation de la bande passante pour la topologie spine-leaf est 1/n, où n est le nombre d’épines. La dégradation de la bande passante pour la topologie hiérarchique est 50% dans ce cas.Haute évolutivité. Vous pouvez ajouter de nouvelles feuilles jusqu’à ce que vous disposiez de ports libres sur les épines. L’ajout de nouvelles épines vous permet d’augmenter les liaisons montantes des feuilles. Ajoutez des commutateurs/routeurs de bord pour augmenter la bande passante vers les réseaux externes. L’approche traditionnelle pour augmenter la bande passante et connecter davantage de serveurs pour la topologie de réseau hiérarchique à trois couches consiste à ajouter davantage de cartes réseau avec plus de ports, des équipements réseau avec des interfaces réseau plus rapides et, de manière générale, du matériel plus puissant. Cette approche traditionnelle est appelée augmenter ou évolutivité verticale.Lorsque vous utilisez la topologie réseau en étoile dans les centres de données et pour les réseaux MSP, vous pouvez ajouter une couche supplémentaire de spines. Cette approche est appelée évolutivité horizontale ou évolutifL’ajout d’une appliance réseau classique, telle qu’un commutateur/routeur, augmente la scalabilité de manière linéaire.Maintenance. Vous pouvez facilement déconnecter les spines du réseau pour les entretenir ou les remplacer. Les tâches de maintenance sur les spines ne présentent aucun risque par rapport aux boîtiers god, car les spines ne disposent d’aucune fonctionnalité intelligente et la réduction de la bande passante est minime après leur déconnexion.

Réseau Clos à plusieurs niveaux

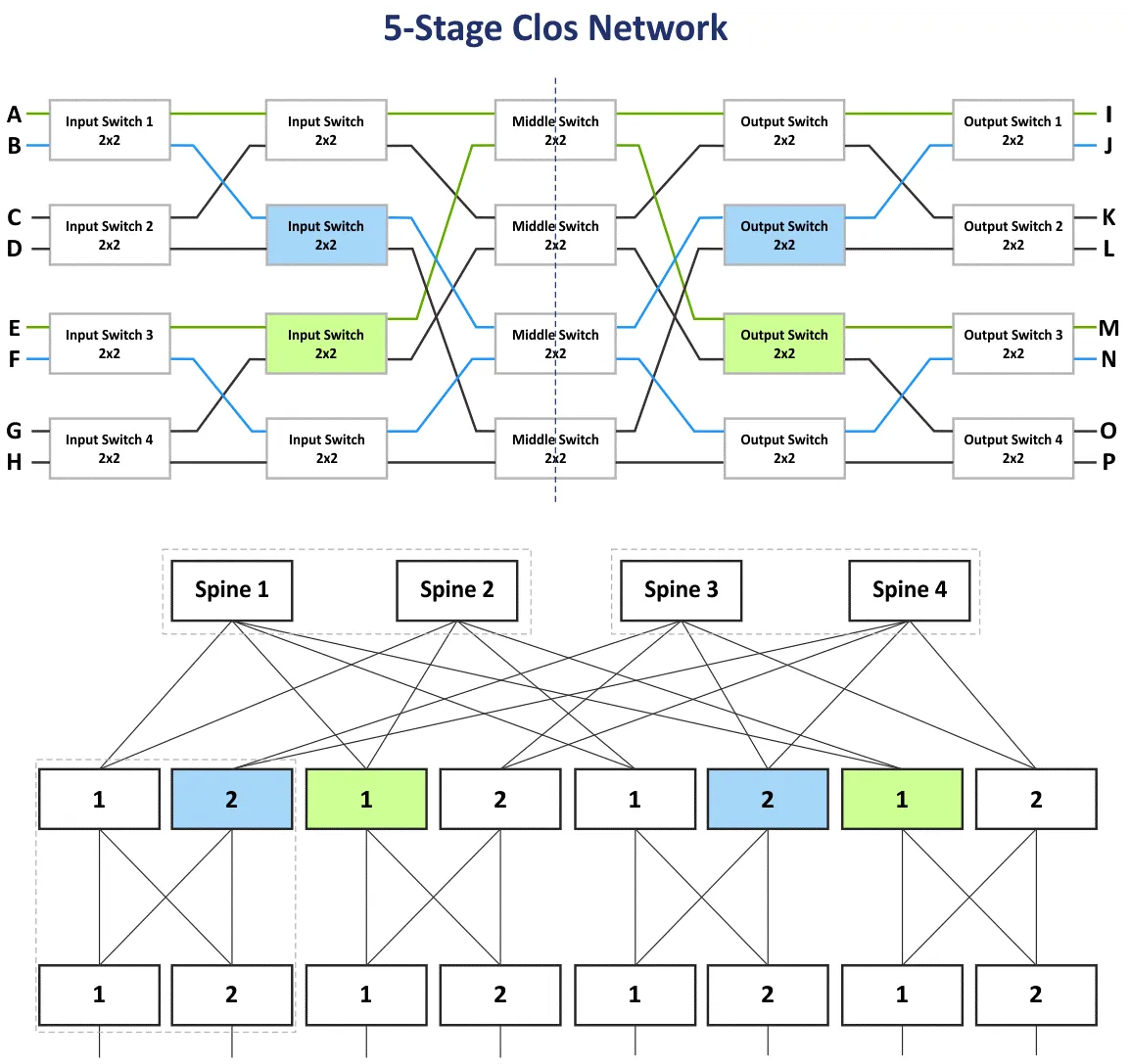

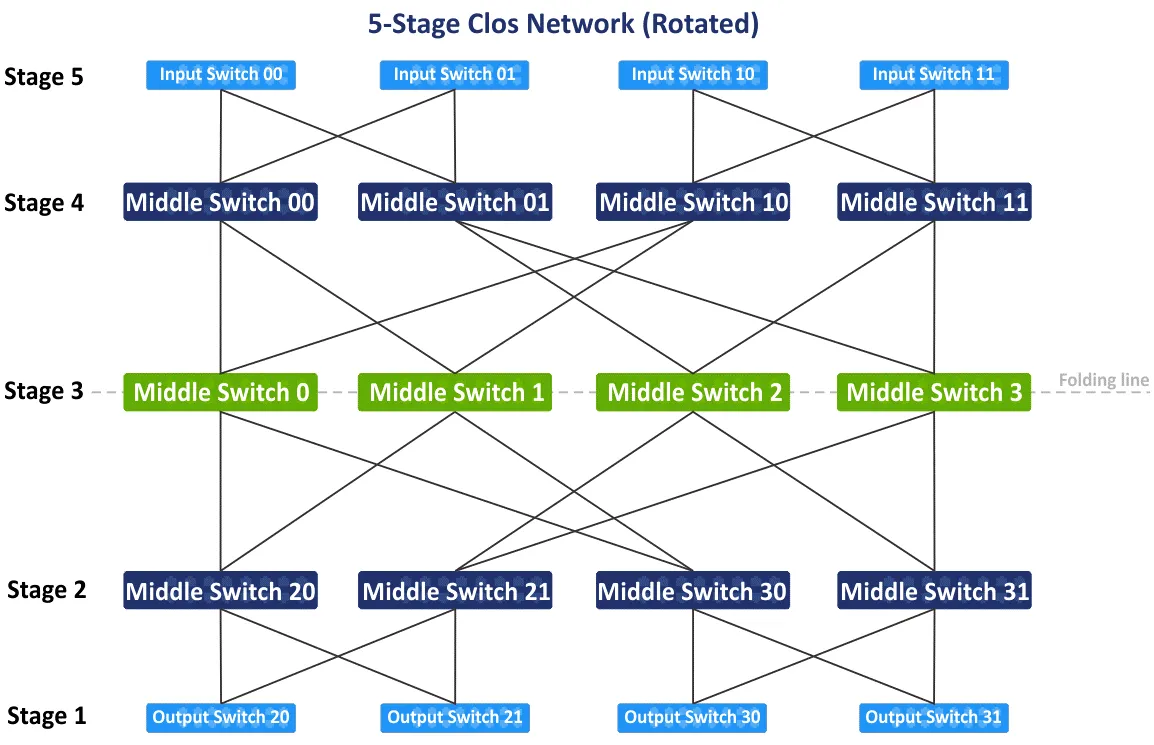

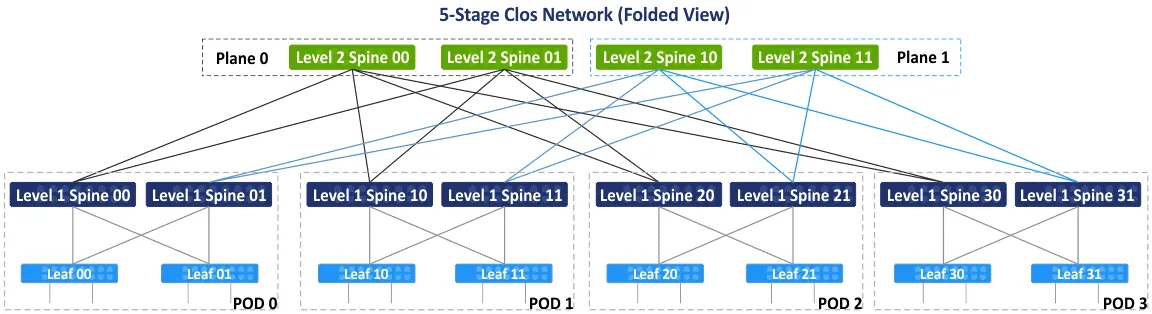

Dans la section précédente, j’ai expliqué le réseau Clos à trois niveaux avec les niveaux suivants : commutateur d’entrée, commutateur intermédiaire et commutateur de sortie. Comme les appliances des niveaux d’entrée et de sortie sont utilisées pour recevoir/envoyer des données, le schéma du réseau peut être replié par l’utilisation d’une ligne intermédiaire composée d’une topologie de réseau feuille-épine à deux niveaux. Vous pouvez ajouter d’autres étapes et construire un réseau Clos à plusieurs niveaux afin de connecter davantage d’appliances réseau à ce réseau. Dans ce cas, vous disposez de cinq étapes : commutateur d’entrée, commutateur intermédiaire 1, commutateur intermédiaire 2, commutateur intermédiaire 3, commutateur de sortie.Sur le schéma suivant, vous pouvez voir le schéma initial du réseau Clos non bloquant à cinq étapes après le réarrangement des blocs bleus et verts. Il existe également la vue feuille-épine repliée ou la vue fat-tree (4,3) (car il y a 4 commutateurs épine et 3 étapes dans le schéma feuille-épine), mais voyons comment connecter les appliances au réseau Clos à 5 étapes, étape par étape. Une topologie de réseau Clos à plus de 5 étapes n’est pas courante et n’est pas utilisée dans la pratique, car le nombre de connexions est trop important. Après avoir fait pivoter le schéma initial du réseau Clos à cinq étages de 90 degrés dans le sens des aiguilles d’une montre, vous obtiendrez la vue traditionnelle avec les commutateurs d’entrée, les commutateurs de sortie et les trois étages des commutateurs intermédiaires. Traçons la ligne de pliage via les commutateurs intermédiaires au centre du schéma pour obtenir la vue pliée du réseau Clos à cinq étages.

Après avoir fait pivoter le schéma initial du réseau Clos à cinq étages de 90 degrés dans le sens des aiguilles d’une montre, vous obtiendrez la vue traditionnelle avec les commutateurs d’entrée, les commutateurs de sortie et les trois étages des commutateurs intermédiaires. Traçons la ligne de pliage via les commutateurs intermédiaires au centre du schéma pour obtenir la vue pliée du réseau Clos à cinq étages. Après avoir plié le schéma, vous obtenez la vue pliée ou la vue feuille-épine de ce type de topologies réseau (voir le schéma suivant). Il existe 4 groupes individuels agissant comme points de livraison (POD). Le POD est l’unité universelle pour la construction de centres de données. Les POD sont connectés aux épines du premier niveau. Si vous devez étendre votre centre de données ou ajouter des serveurs/équipements réseau supplémentaires, ajoutez de nouveaux POD et connectez-les à la structure du réseau. Les épines d’un POD sont connectées aux épines d’autres POD via des épines de deuxième niveau. Dans le même temps, toutes les épines L1 ne sont pas connectées à toutes les épines L2, et elles sont divisées par plans.Il existe deux plans : le plan 0 et le plan 1 dans le schéma suivant. Ce concept est utilisé en raison du nombre limité de ports sur les spines, et la création d’une topologie de réseau entièrement connectée n’est pas possible dans ce cas. Dans le schéma suivant, chaque spine a une limite de 4 ports. Selon l’idée principale, le réseau Clos non bloquant est basé sur les mêmes éléments (commutateurs à 4 ports, comme vu ci-dessous).

Après avoir plié le schéma, vous obtenez la vue pliée ou la vue feuille-épine de ce type de topologies réseau (voir le schéma suivant). Il existe 4 groupes individuels agissant comme points de livraison (POD). Le POD est l’unité universelle pour la construction de centres de données. Les POD sont connectés aux épines du premier niveau. Si vous devez étendre votre centre de données ou ajouter des serveurs/équipements réseau supplémentaires, ajoutez de nouveaux POD et connectez-les à la structure du réseau. Les épines d’un POD sont connectées aux épines d’autres POD via des épines de deuxième niveau. Dans le même temps, toutes les épines L1 ne sont pas connectées à toutes les épines L2, et elles sont divisées par plans.Il existe deux plans : le plan 0 et le plan 1 dans le schéma suivant. Ce concept est utilisé en raison du nombre limité de ports sur les spines, et la création d’une topologie de réseau entièrement connectée n’est pas possible dans ce cas. Dans le schéma suivant, chaque spine a une limite de 4 ports. Selon l’idée principale, le réseau Clos non bloquant est basé sur les mêmes éléments (commutateurs à 4 ports, comme vu ci-dessous). À première vue, vous pouvez être dérouté par des termes tels que Clos, Clos replié, feuille-épine et arbre gras. Permettez-moi de clarifier ces termes.Clos ou Réseau Clos est le terme qui désigne la base théorique du type de topologie réseau Clos.Plié Clos est une représentation plus pratique du réseau Clos, où les entrées et les sorties ont le même rôle et sont situées à l’emplacement même.Épine foliaire est une topologie réseau basée sur le schéma réseau Clos qui est utilisée dans la pratique dans les centres de données pour construire des réseaux, y compris les réseaux MSP.Arbre gras est généralement considéré comme une variante du réseau Clos. Ce terme prête particulièrement à confusion, car certains articles mentionnent le fat tree comme étant le réseau classique d’accès-agrégation-cœur. Je me réfère au document RFC 7938 qui indique que le fat tree est basé sur la topologie de réseau Clos repliée.

À première vue, vous pouvez être dérouté par des termes tels que Clos, Clos replié, feuille-épine et arbre gras. Permettez-moi de clarifier ces termes.Clos ou Réseau Clos est le terme qui désigne la base théorique du type de topologie réseau Clos.Plié Clos est une représentation plus pratique du réseau Clos, où les entrées et les sorties ont le même rôle et sont situées à l’emplacement même.Épine foliaire est une topologie réseau basée sur le schéma réseau Clos qui est utilisée dans la pratique dans les centres de données pour construire des réseaux, y compris les réseaux MSP.Arbre gras est généralement considéré comme une variante du réseau Clos. Ce terme prête particulièrement à confusion, car certains articles mentionnent le fat tree comme étant le réseau classique d’accès-agrégation-cœur. Je me réfère au document RFC 7938 qui indique que le fat tree est basé sur la topologie de réseau Clos repliée.

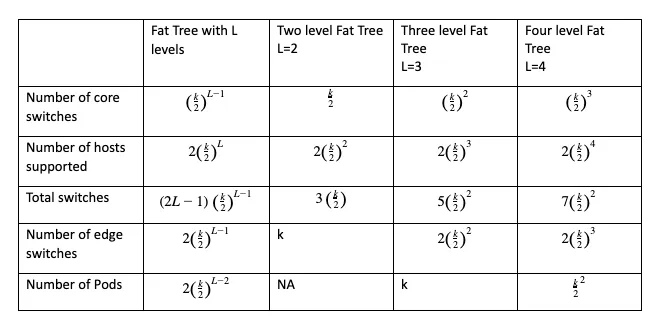

Calculs

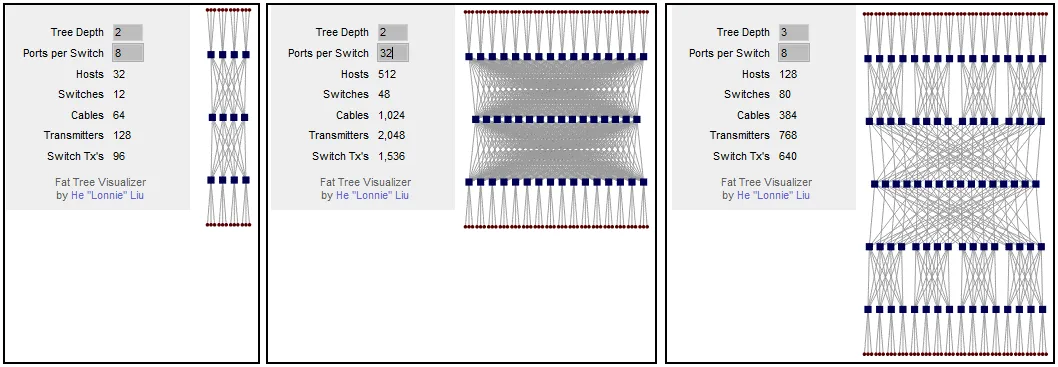

Vous pouvez calculer le nombre de commutateurs centraux, de commutateurs périphériques, de commutateurs totaux nécessaires et le nombre total d’hôtes pouvant être connectés au réseau de la configuration sélectionnée par les formules suivantes :k est le nombre de ports dans le commutateurL est le nombre de niveaux dans la topologie de réseau en arborescence (fat tree). Le paramètre principal à calculer avant de construire votre réseau est le nombre d’hôtes pris en charge. La configuration fat-tree peut être écrite sous la forme FT(k, L). Par exemple, FT(32,3) est un réseau fat-tree à trois niveaux avec des commutateurs à 32 ports. Vous pouvez utiliser ceci calculatrice gratuite pour les réseaux Clos qui génèrent également le schéma de visualisation pour la configuration sélectionnée.Vous pouvez calculer que si votre schéma de réseau en arbre épais comporte 2 niveaux et 8 ports par commutateur, vous pouvez alors connecter 32 hôtes au réseau. Si vous augmentez le nombre de ports par commutateur, le nombre d’hôtes pris en charge passe à 512. Comme vous pouvez le constater, le nombre d’hôtes connectés dépend du nombre de ports sur chaque commutateur. Si vous laissez le Fat Tree à 2 niveaux (réseau Clos à 3 niveaux) et augmentez le nombre de ports par commutateur, le nombre de spines augmente considérablement. Vous pouvez résoudre ce problème en ajoutant un niveau supplémentaire au Fat Tree. Pour un Fat Tree à trois niveaux, si le nombre de ports par commutateur est de 8, vous pouvez connecter 128 hôtes.

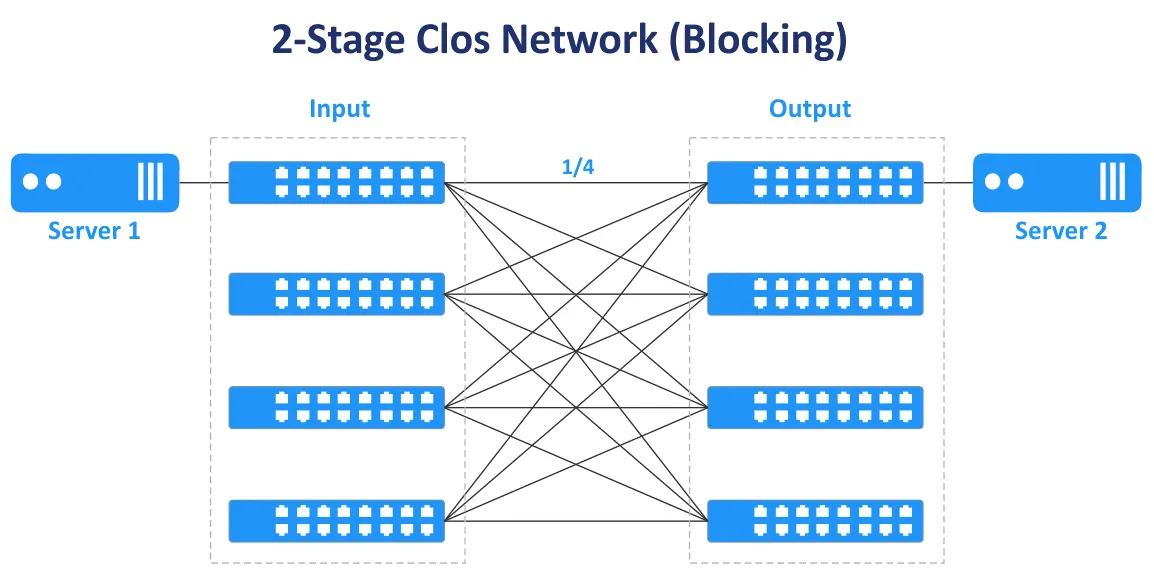

Le paramètre principal à calculer avant de construire votre réseau est le nombre d’hôtes pris en charge. La configuration fat-tree peut être écrite sous la forme FT(k, L). Par exemple, FT(32,3) est un réseau fat-tree à trois niveaux avec des commutateurs à 32 ports. Vous pouvez utiliser ceci calculatrice gratuite pour les réseaux Clos qui génèrent également le schéma de visualisation pour la configuration sélectionnée.Vous pouvez calculer que si votre schéma de réseau en arbre épais comporte 2 niveaux et 8 ports par commutateur, vous pouvez alors connecter 32 hôtes au réseau. Si vous augmentez le nombre de ports par commutateur, le nombre d’hôtes pris en charge passe à 512. Comme vous pouvez le constater, le nombre d’hôtes connectés dépend du nombre de ports sur chaque commutateur. Si vous laissez le Fat Tree à 2 niveaux (réseau Clos à 3 niveaux) et augmentez le nombre de ports par commutateur, le nombre de spines augmente considérablement. Vous pouvez résoudre ce problème en ajoutant un niveau supplémentaire au Fat Tree. Pour un Fat Tree à trois niveaux, si le nombre de ports par commutateur est de 8, vous pouvez connecter 128 hôtes. Si vous augmentez le nombre de ports par commutateur à 32, vous pouvez connecter 8192 hôtes à l’aide de cette topologie réseau. Ce nombre pour le réseau Clos à 5 niveaux est 16 fois supérieur à celui du réseau Clos à 3 niveaux. Gardez à l’esprit les limites du rack de serveurs lorsque vous planifiez le schéma d’installation des serveurs et des équipements réseau dans le centre de données.Des nombres impairs d’étages sont utilisés pour construire des réseaux Clos sans blocage (3, 5, 7, etc.). Le réseau Clos à deux niveaux n’offre pas de connectivité sans blocage ni de connexions multiples entre les commutateurs.Dans le schéma suivant, vous pouvez voir que dans le cas du réseau Clos à deux niveaux, il n’y a qu’un seul chemin de transmission pour connecter le serveur 1 et le serveur 2. Seuls ¼ des ports sont connectés, les autres ports ne sont pas connectés et vous bloquent.

Si vous augmentez le nombre de ports par commutateur à 32, vous pouvez connecter 8192 hôtes à l’aide de cette topologie réseau. Ce nombre pour le réseau Clos à 5 niveaux est 16 fois supérieur à celui du réseau Clos à 3 niveaux. Gardez à l’esprit les limites du rack de serveurs lorsque vous planifiez le schéma d’installation des serveurs et des équipements réseau dans le centre de données.Des nombres impairs d’étages sont utilisés pour construire des réseaux Clos sans blocage (3, 5, 7, etc.). Le réseau Clos à deux niveaux n’offre pas de connectivité sans blocage ni de connexions multiples entre les commutateurs.Dans le schéma suivant, vous pouvez voir que dans le cas du réseau Clos à deux niveaux, il n’y a qu’un seul chemin de transmission pour connecter le serveur 1 et le serveur 2. Seuls ¼ des ports sont connectés, les autres ports ne sont pas connectés et vous bloquent. Le ratio de sursouscription est le rapport entre la bande passante d’entrée et la bande passante de sortie dans le sens des couches inférieures vers les couches supérieures. Le taux de sursouscription varie généralement entre 2 et 4.Exemple : un commutateur dispose de 48 ports 10 Gbit et de 4 ports uplink 40 Gbit. La bande passante totale des liaisons descendantes vers les serveurs est de 48 x 10 = 480 Gbit/s. La vitesse totale des liaisons montantes est de 4 x 40 = 160 Gbit/s. Le ratio de sursouscription est de 480/160 = 4.Si la vitesse totale de la bande passante est égale pour tous les ports de liaison descendante et montante du commutateur, celui-ci n’est pas sursouscrit et il n’y a pas de goulots d’étranglement dans ce cas. Un ratio de sursouscription de 1:1 est le cas idéal. Estimez le trafic dans différentes directions avant d’acheter des commutateurs avec la vitesse et le nombre de ports appropriés.Les commutateurs dont le ratio de sursouscription est supérieur à 1 sont souvent utilisés au niveau des feuilles dans les réseaux de topologie feuille-épine. Les commutateurs non sursouscrits doivent être utilisés au niveau spine. Les commutateurs au niveau leaf dans la topologie réseau leaf-spine sont généralement utilisés comme commutateurs ToR. Cependant, il est possible d’installer des commutateurs leaf comme commutateurs End of Row.

Le ratio de sursouscription est le rapport entre la bande passante d’entrée et la bande passante de sortie dans le sens des couches inférieures vers les couches supérieures. Le taux de sursouscription varie généralement entre 2 et 4.Exemple : un commutateur dispose de 48 ports 10 Gbit et de 4 ports uplink 40 Gbit. La bande passante totale des liaisons descendantes vers les serveurs est de 48 x 10 = 480 Gbit/s. La vitesse totale des liaisons montantes est de 4 x 40 = 160 Gbit/s. Le ratio de sursouscription est de 480/160 = 4.Si la vitesse totale de la bande passante est égale pour tous les ports de liaison descendante et montante du commutateur, celui-ci n’est pas sursouscrit et il n’y a pas de goulots d’étranglement dans ce cas. Un ratio de sursouscription de 1:1 est le cas idéal. Estimez le trafic dans différentes directions avant d’acheter des commutateurs avec la vitesse et le nombre de ports appropriés.Les commutateurs dont le ratio de sursouscription est supérieur à 1 sont souvent utilisés au niveau des feuilles dans les réseaux de topologie feuille-épine. Les commutateurs non sursouscrits doivent être utilisés au niveau spine. Les commutateurs au niveau leaf dans la topologie réseau leaf-spine sont généralement utilisés comme commutateurs ToR. Cependant, il est possible d’installer des commutateurs leaf comme commutateurs End of Row.

Différences essentielles

Lors de la création d’un réseau, certaines décisions ont une incidence sur la configuration du réseau. Voici quelques décisions qui ont une incidence sur la fonctionnalité du réseau.

Haut du rack vs extrémité de rangée

Le Haut du rack Le schéma de connexion réseau ToR (Top-of-Rack) dans un centre de données consiste à installer un ou plusieurs commutateurs dans chaque rack. Des câbles de raccordement courts sont utilisés pour connecter le haut du commutateur du rack aux autres équipements réseau et serveurs du rack. Les commutateurs ToR disposent généralement de liaisons montantes à haut débit vers les commutateurs/routeurs de niveau supérieur et peuvent être connectés à des câbles à fibre optique. L’avantage est que lorsque vous utilisez ce schéma de connexion pour un réseau MSP, vous n’avez pas besoin d’installer un ensemble de câbles volumineux à partir de chaque rack du centre de données. L’utilisation des câbles dans le centre de données est plus rationnelle lorsque l’on utilise le schéma ToR. Dans ce cas, vous dépensez moins en câblage et bénéficiez d’une meilleure gestion des câbles. Vous pouvez gérer chaque rack comme un module unique sans affecter les autres racks du centre de données, car seuls les serveurs d’un seul rack sont concernés. Malgré le nom du schéma, vous pouvez monter un commutateur au milieu ou au bas de chaque rack. Le Fin de ligne Le schéma de connexion réseau EoR (End of Row) consiste à installer un rack de serveurs à l’extrémité de la rangée qui contient l’équipement réseau. Cet équipement comprend un commutateur réseau commun permettant de connecter tous les serveurs et autres appliances de tous les racks de serveurs de la rangée. Les câbles provenant de l’équipement réseau installé dans le rack de serveurs EoR sont connectés aux appliances de tous les racks de la rangée par l’intermédiaire de panneaux de brassage montés dans chaque rack. Par conséquent, de longs câbles sont utilisés pour connecter toutes les appliances réseau d’une rangée. Si des connexions réseau redondantes sont utilisées, le nombre de câbles augmente également. Les câbles épais peuvent bloquer l’accès de l’air à l’équipement.Les racks de serveurs sont généralement disposés en rangées côte à côte dans un centre de données. Une rangée peut contenir 10 ou 12 racks, par exemple. L’ensemble de la rangée est considéré comme une seule unité de gestion lorsque le schéma de connexion EoR est utilisé pour le réseau MSP dans un centre de données. Le modèle de gestion par rangée est utilisé dans ce cas. Le modèle de connexion réseau EoR nécessite moins de commutateurs individuels. La flexibilité est moindre lorsque vous devez effectuer la maintenance ou la mise à niveau des commutateurs, car un plus grand nombre d’appliances sont affectées lorsqu’un commutateur EoR est déconnecté. Malgré son nom, un rack avec un ou plusieurs commutateurs communs peut être placé au milieu de la rangée.

Le Fin de ligne Le schéma de connexion réseau EoR (End of Row) consiste à installer un rack de serveurs à l’extrémité de la rangée qui contient l’équipement réseau. Cet équipement comprend un commutateur réseau commun permettant de connecter tous les serveurs et autres appliances de tous les racks de serveurs de la rangée. Les câbles provenant de l’équipement réseau installé dans le rack de serveurs EoR sont connectés aux appliances de tous les racks de la rangée par l’intermédiaire de panneaux de brassage montés dans chaque rack. Par conséquent, de longs câbles sont utilisés pour connecter toutes les appliances réseau d’une rangée. Si des connexions réseau redondantes sont utilisées, le nombre de câbles augmente également. Les câbles épais peuvent bloquer l’accès de l’air à l’équipement.Les racks de serveurs sont généralement disposés en rangées côte à côte dans un centre de données. Une rangée peut contenir 10 ou 12 racks, par exemple. L’ensemble de la rangée est considéré comme une seule unité de gestion lorsque le schéma de connexion EoR est utilisé pour le réseau MSP dans un centre de données. Le modèle de gestion par rangée est utilisé dans ce cas. Le modèle de connexion réseau EoR nécessite moins de commutateurs individuels. La flexibilité est moindre lorsque vous devez effectuer la maintenance ou la mise à niveau des commutateurs, car un plus grand nombre d’appliances sont affectées lorsqu’un commutateur EoR est déconnecté. Malgré son nom, un rack avec un ou plusieurs commutateurs communs peut être placé au milieu de la rangée.

Connexion de couche 2 vs connexion de couche 3

Le choix des connexions au sein d’un réseau est un calcul qui tient compte de la fiabilité, de la vitesse et du coût, ainsi que de la topologie créée.Par exemple, il existe des segments de réseau pour la topologie réseau à trois niveaux (accès-agrégation-cœur) et la topologie Leaf-Spine. Dans ce cas, le trafic est transféré sur les couches L2 et L3 du modèle OSI. Dans le réseau hiérarchique à trois niveaux, la couche d’accès fonctionne sur la couche L2, la couche de distribution/agrégation agrège les liaisons L2 et fournit le routage L3, tandis que la couche réseau centrale effectue le routage sur la troisième couche du modèle OSI. Le réseau de la topologie Leaf-Spine à plusieurs niveaux peut être configuré en utilisant la couche L2 avec des VLAN et la couche L3 avec le routage IP et des sous-réseaux.Les équipements de mise en réseau L2 sont plus abordables que les équipements de mise en réseau L3, mais l’utilisation d’un réseau L2 pour connecter des appliances réseau dans le réseau MSP d’un centre de données présente certains inconvénients. Le VLAN est généralement utilisé pour isoler logiquement les réseaux utilisant le même environnement physique. Le nombre maximal de VLAN est de 4095 (moins certains VLAN réservés tels que 0, 4095, 1002-1005).Un autre inconvénient, comme mentionné précédemment, est l’impossibilité d’utiliser des liaisons redondantes lorsque le protocole STP est utilisé sur L2. En effet, une seule liaison peut être active à la fois, et toute la bande passante disponible de toutes les liaisons n’est pas utilisée. Ensuite, le domaine L2 avec STP devient vaste, la probabilité de problèmes causés par un câblage incorrect et des erreurs humaines augmente, et le dépannage devient difficile.Une configuration réseau L3 permet aux ingénieurs d’améliorer la stabilité et l’évolutivité du réseau MSP et des réseaux de centres de données en général.Les protocoles réseau suivants vous aident à gérer le réseau L3 et à acheminer le trafic.Le BGP (Border Gateway Protocol) est un protocole de routage dynamique largement utilisé et considéré comme la norme dans de nombreuses organisations disposant de centres de données à grande échelle. Le BGP est un protocole hautement évolutif, extensible et efficace.L’ECMP (Equal Cost Multipath Routing) est une technologie de routage réseau utilisée pour distribuer le trafic en utilisant plusieurs chemins optimaux définis par des métriques au niveau de la troisième couche du modèle OSI. L’ECMP avec des protocoles de routage est utilisé pour l’équilibrage de charge dans les grands réseaux. La plupart des protocoles de routage, y compris BGP, EIGRP, IS-IS, OSPF, prennent en charge la technologie ECMP.Essayez toujours d’utiliser les protocoles réseau les plus avancés. Mais n’oubliez pas que moins il y a de protocoles utilisés dans le réseau, plus l’administration du réseau est pratique.

Topologie réseau pour NV et SDN

En plus de la virtualisation matérielle et de l’utilisation de machines virtuelles, la virtualisation réseau avec une approche centrée sur les applications est également devenue populaire. Les solutions de virtualisation réseau (NV) telles que VMware NSX, OpenStack Networking et Cisco ASI utilisent intensivement le trafic est-ouest dans le réseau physique. C’est pour cette raison que la topologie réseau leaf-spine est adaptée aux solutions de virtualisation réseau. Lisez l’article de blog à ce sujet. VMware NSX pour en savoir plus sur la virtualisation des réseaux.Le réseau défini par logiciel (SDN) est utilisé pour virtualiser les réseaux afin d’optimiser l’utilisation des ressources, la flexibilité et l’administration centralisée. Il s’agit d’une solution optimale dans un centre de données virtualisé où des machines virtuelles connectées au réseau sont utilisées. Les machines virtuelles peuvent migrer entre les serveurs, créant ainsi un trafic est-ouest au sein du centre de données. Le SDN est largement utilisé pour les réseaux MSP par les MSP qui fournissent des services IaaS (infrastructure as a service).La configuration de réseaux définis par logiciel est efficace lorsqu’on utilise la topologie de réseau leaf-spine sous-jacente avec un routage dynamique, un nombre fixe de sauts, une latence faible et prévisible, et une optimisation du trafic est-ouest pour la communication entre serveurs dans un centre de données.

VXLAN

VXLAN (Virtual eXtensible Local Area Network) est un protocole réseau amélioré utilisé à la place du VLAN dans les réseaux superposés. Les tunnels L2 sont créés par l’utilisation des réseaux L3 sous-jacents (sous-couche réseau L3) afin de fournir une connectivité réseau L2 sans les limitations traditionnelles du VLAN. Avec VXLAN, vous pouvez configurer le réseau L2 sur le réseau L3. La topologie virtuelle peut être différente de la topologie physique du réseau sous-jacent.Les trames VXLAN sont encapsulées dans des paquets IP par le schéma d’encapsulation MAC-in-UDP. Le VNI est l’équivalent de l’ID VLAN. Le nombre maximal de VNI est 2^24, soit environ 16 millions. Le VXLAN est utilisé pour créer des réseaux L2 dans des environnements géographiquement étendus, par exemple lorsque vous devez créer un réseau entre deux centres de données géographiquement distribués.L’utilisation de VXLAN et de la virtualisation du réseau permet d’optimiser la taille de la table d’adresses MAC pour les commutateurs ToR. En effet, les adresses MAC utilisées par les VMs et le trafic L2 associé sont transférés via le réseau de superposition L2 par l’intermédiaire de VXLAN. Ils ne surchargent pas les tables MAC des commutateurs physiques. Les tables d’adresses MAC des commutateurs physiques ne dépassent pas la capacité maximale disponible des commutateurs.

Conclusion

Traditionnellement, les réseaux dans les centres de données étaient construits par la topologie classique à trois niveaux (accès-agrégation-cœur). Compte tenu de l’évolution des applications client-serveur et distribuées modernes, des microservices et d’autres logiciels qui sont à l’origine du trafic est-ouest au sein des réseaux MSP, la topologie de réseau leaf-spine, basée sur le concept de réseau Clos, est privilégiée dans les centres de données modernes et constitue l’une des topologies de réseau les plus courantes. La topologie réseau feuille-épine est la meilleure topologie réseau pour les grands centres de données, car elle est très fiable et évolutive. Avant d’installer un réseau dans un centre de données, effectuez les calculs nécessaires et estimez le trafic et les Workloads générés. Tenez compte du trafic de service, tel que le trafic de sauvegarde et de réplication, dans le réseau.NAKIVO Backup & Replication est un puissant logiciel de sauvegarde de machines virtuelles capable de protéger les Workloads VMware Cloud Director, les VMs VMware, les VMs Hyper-V, ainsi que les machines physiques Linux et Windows et les bases de données Oracle. Les fournisseurs de services gérés qui proposent des infrastructures en tant que service (IaaS), des sauvegardes en tant que service (BaaS) et des services de reprise après sinistre (DRaaS) peuvent utiliser NAKIVO Backup & Replication installé en mode multitenant. Téléchargez l’essai gratuit de NAKIVO Backup & Replication pour les MSP qui prend en charge le mode d’installation multi-locataires.