MSP-Netzwerktopologie für Einsteiger

Für Managed Services Provider (MSPs) ist der Aufbau eines leistungsstarken und skalierbaren Netzwerks ein wichtiger Grundstein für den Erfolg. In einem früheren BlogbeitragWir haben die grundlegenden Netzwerktopologietypen behandelt und untersuchen in diesem Beitrag komplexere Netzwerktopologietypen für Dienstanbieter, darunter auch solche, die für MSP-Netzwerke bevorzugt werden. Lesen Sie diesen Blogbeitrag, um zu erfahren, welche Topologie die beste Netzwerktopologie für ein MSP-Rechenzentrum ist und warum.

Traditionelle dreistufige hierarchische Netzwerke

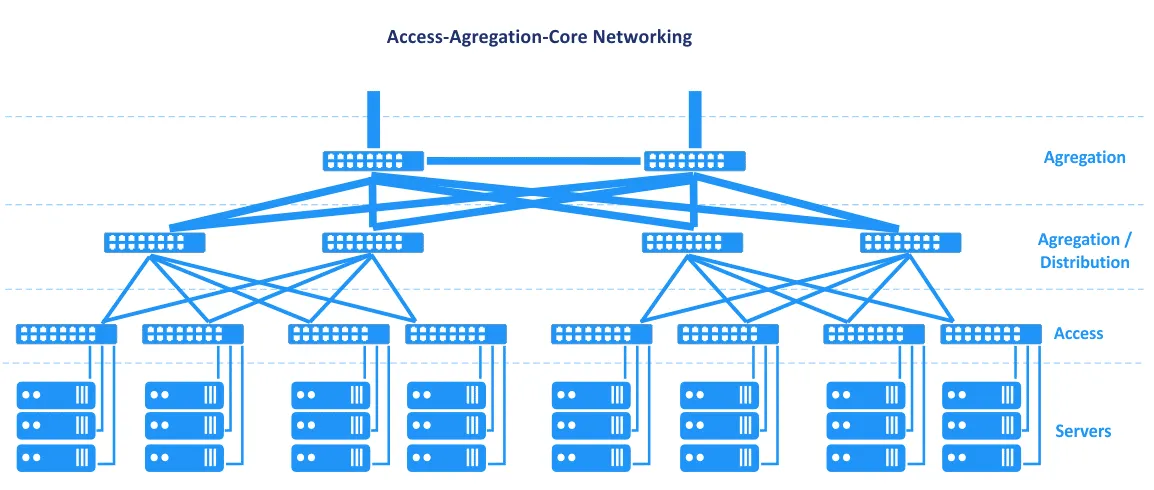

Bevor Software Defined Networks üblich wurden, basierten Netzwerke in Rechenzentren auf der hierarchischen Baumnetzwerktopologie. Diese Topologie gliedert sich in drei Hauptschichten: die Kernschicht, die Aggregations- oder Verteilungsschicht und die Zugriffsschicht. In dieser Topologie sind die Server mit Switches in der Zugriffsebene verbunden. Edge-Router sind mit dem Kern verbunden, um den Zugriff vom/zum WAN (Wide Area Network) und zum Internet zu ermöglichen. Diese Router befinden sich in der folgenden Abbildung zwischen dem Kern und dem Internet. Im Hinblick auf das OSI-Modell (Open Systems Interconnection), das das Netzwerk unter anderem in eine Datenverbindungsschicht (L2) und eine Netzwerkschicht (L3) unterteilt, erstreckt sich die Access-Aggregation-Core-Netzwerktopologie über mehrere Schichten, wie in der Grafik dargestellt.Betrachten wir diese drei Schichten nacheinander.

Im Hinblick auf das OSI-Modell (Open Systems Interconnection), das das Netzwerk unter anderem in eine Datenverbindungsschicht (L2) und eine Netzwerkschicht (L3) unterteilt, erstreckt sich die Access-Aggregation-Core-Netzwerktopologie über mehrere Schichten, wie in der Grafik dargestellt.Betrachten wir diese drei Schichten nacheinander.

Kernschicht

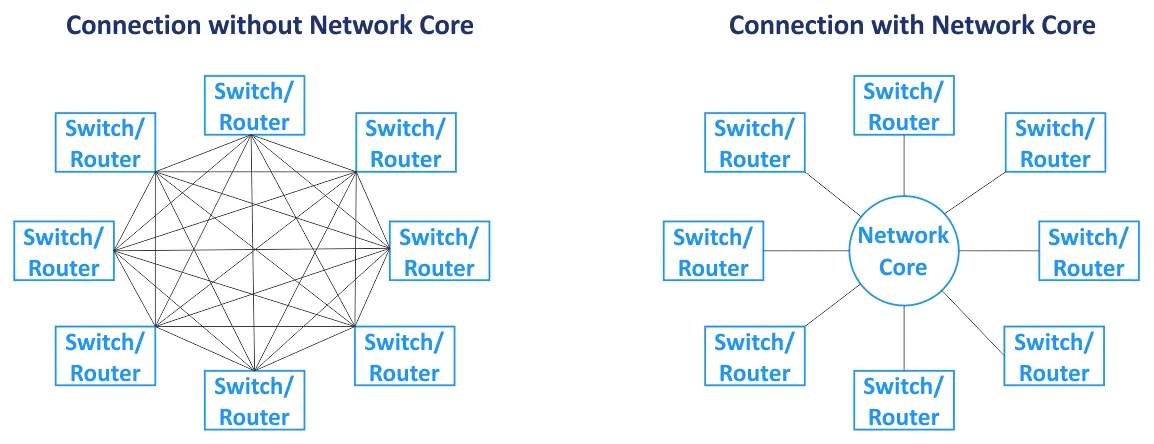

Der Netzwerkkern (auch Kernnetzwerk genannt) ist die zentrale Komponente des gesamten Netzwerks. Primäre Knoten sind mit dem Kern verbunden. Das Kernnetzwerk basiert in der Regel auf einer Mesh-Netzwerktopologie, bei der alle Knoten mit allen anderen Knoten innerhalb des Kerns verbunden sind (bei einer vollständigen Mesh-Netzwerktopologie). Switches und Router im Netzwerkkern sind über Hochgeschwindigkeitsverbindungen (auch Backbone-Verbindungen genannt) miteinander verbunden. Da im Netzwerkkern Router verwendet werden, arbeitet die Kernschicht mit L3-Datenverkehr.

Verteilungs-/Aggregationsschicht

Dies ist eine mittlere Schicht, die dazu dient, Uplinks aus der darunterliegenden Schicht der dreistufigen Netzwerktopologie (der Zugriffsschicht, die auf L2 arbeitet) zur Netzwerkkernschicht (die normalerweise auf L3 arbeitet) unter Verwendung von Verbindungen mit höherer Bandbreite zu aggregieren. Die Verteilungsschicht kombiniert eine hohe Anzahl von Ports mit niedriger Geschwindigkeit mit einer kleinen Anzahl von Trunk-Ports mit hoher Geschwindigkeit. Das Routing beginnt am Verteilungs-/Aggregationslayer dieser Netzwerktopologie, wenn Daten von der Zugriffsschicht übertragen werden. Die Firewall, der Lastausgleich und andere Einstellungen zur Sicherheit werden am Aggregationslayer festgelegt. Der Aggregations-/Verteilungslayer wird verwendet, um das Verkabelungsschema im Rechenzentrum zu reduzieren und zu vereinfachen und so ein bequemeres Management zu ermöglichen. Die auf der Aggregationsschicht installierten Switches müssen die Speicherung von mehr MAC-Adressen in der MAC-Adressentabelle in ihrem Speicher unterstützen. Während die Zugriffsschicht mit L2-Datenverkehr arbeitet, arbeitet die Verteilungsschicht mit L2- und L3-Datenverkehr.

Zugriffsebene

Diese Schicht besteht aus Switches, die auf L2 arbeiten. Server und Arbeitsstationen sind mit den Switches der Zugriffsschicht verbunden. VLANs (Virtual Local Area Network) werden in der Regel verwendet, um L2-Broadcast-Domänen zu trennen, um den Broadcast-Verkehr zu reduzieren und die Sicherheit zu erhöhen.Um Engpässe zu vermeiden, werden näher am Netzwerkkern dickere Verbindungen verwendet. Beispielsweise werden Server von 10-Gbit/s-Netzwerkschnittstellen mit Access-Switches verbunden, Access-Switches werden von 10-Gbit/s-Schnittstellen mit Aggregation-Switches verbunden und Switches/Router der Aggregation-Schicht werden von 100-Gbit/s-Verbindungen mit Netzwerk-Core-Switches/Routern verbunden. In diesem Fall kann Link-Aggregation verwendet werden, um die Bandbreite und Redundanz zu erhöhen. Der gesamte Datenverkehr von Servern wird an Uplinks übertragen. An der Spitze der Hierarchie dieser Netzwerktopologie befindet sich eine Reihe intelligenter Netzwerkgeräte, die den Spitznamen „God Boxes” tragen. God Boxes sind für das Routing und alle anderen Dienste zuständig. Die hierarchische Netzwerktopologie ermöglicht die Erstellung eines modularen Netzwerks.In der Netzwerktopologie aus dem vorherigen Diagramm führt der Ausfall einer Verbindung zum Ausfall dieses Netzwerksegments. Aus diesem Grund werden für diesen Netzwerktopologietyp (siehe folgendes Schema) auf jeder Netzwerkschicht reservierte Kanäle und Redundanz verwendet. Der Ausfall eines Geräts oder einer Verbindung führt zu einer Minderung der Leistung, aber das Netzwerk arbeitet weiterhin. Diese redundante Netzwerktopologie erfordert in der Regel STP (Spanning Tree Protocol). Wartung. Wenn Sie einige der Netzwerkgeräte auf dieser dreistufigen Netzwerktopologie trennen, um ein Software-Update durchzuführen oder andere Aufgaben der Wartung durchzuführen, verschlechtert sich die Leistung des Netzwerks. Einige Dienste sind dann möglicherweise vorübergehend nicht verfügbar.Skalierbarkeit. Die Anzahl der auf Servern ausgeführten Dienste wächst von Jahr zu Jahr, und entsprechend steigt auch das Datenverkehrsaufkommen. Diese Situation erfordert eine Aufrüstung und Erhöhung der Netzwerkbandbreite im MSP-Netzwerk. Die Erhöhung der Netzwerkbandbreite in einem klassischen Rechenzentrum erforderte in der Regel Folgendes:

Wartung. Wenn Sie einige der Netzwerkgeräte auf dieser dreistufigen Netzwerktopologie trennen, um ein Software-Update durchzuführen oder andere Aufgaben der Wartung durchzuführen, verschlechtert sich die Leistung des Netzwerks. Einige Dienste sind dann möglicherweise vorübergehend nicht verfügbar.Skalierbarkeit. Die Anzahl der auf Servern ausgeführten Dienste wächst von Jahr zu Jahr, und entsprechend steigt auch das Datenverkehrsaufkommen. Diese Situation erfordert eine Aufrüstung und Erhöhung der Netzwerkbandbreite im MSP-Netzwerk. Die Erhöhung der Netzwerkbandbreite in einem klassischen Rechenzentrum erforderte in der Regel Folgendes:

- Erhöhung der Link-Aggregation-Verbindungen (LAG)

- Netzwerkkarten kaufen

- Wenn keine Steckplätze für die Installation von Netzwerkkarten verfügbar sind, müssen neue Server oder zugehörige Geräte gekauft werden.

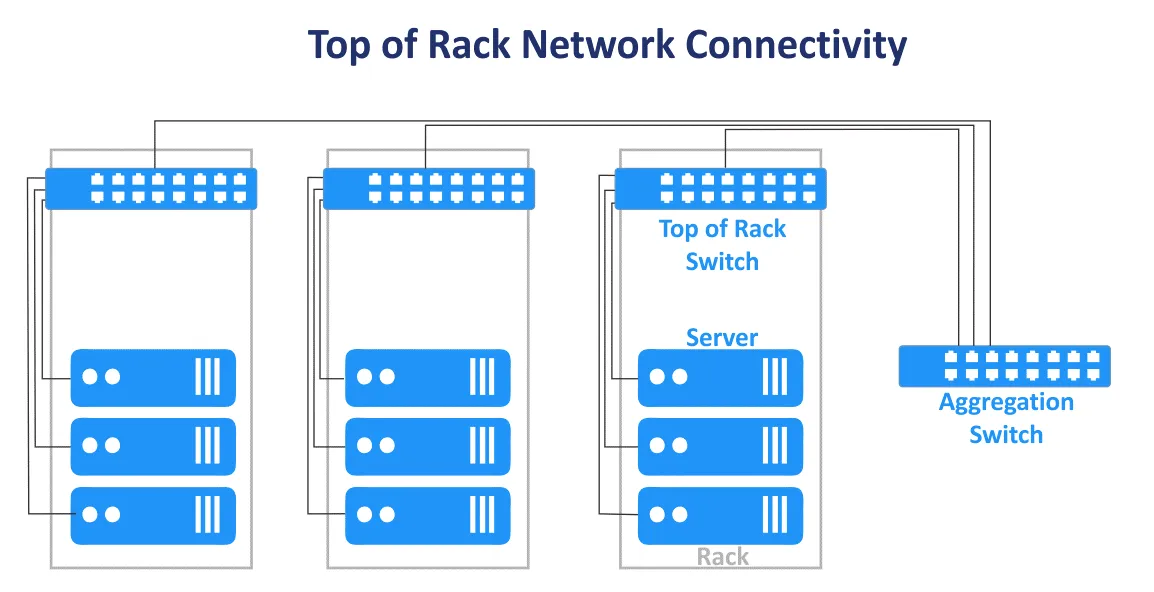

Wenn Sie ein neues Serverrack (Rack-Kabine) als neues Modul in Ihrem Rechenzentrum hinzufügen müssen, können Sie die Netzwerkbandbreite zu diesem Rack und den darin installierten Servern erhöhen. Diese Art von Netzwerktopologien kann aufgrund von L2-Protokollfunktionen wie STP und MSTP (Multiple Spanning Tree Protocol) kein hohes Maß an Verbindungsreservierung und Redundanz gewährleisten.Die klassische dreistufige Netzwerktopologie in einem Rechenzentrum kann mit den Designs „End of Row“ und „Top of Rack“ kombiniert werden. Das Verbindungsschema „Top of Rack“ ist mittlerweile beliebter. Dieser Name wird verwendet, weil Server und Switches mit dem Hauptswitch auf jedem Rack verbunden sind. Die Top-of-Rack-Switches (ToR-Switches) sind mit Switches/Routern der höheren Ebenen im MSP-Netzwerk verbunden. ToR-Switches unterscheiden sich von User-Edge-Switches und verfügen über mehrere zusätzliche Hochgeschwindigkeits-Uplink-Ports (z. B. 10-Gbit/s-Ports) und eine hohe Anzahl von Ports zum Verbinden von Servern. ToR-Switches werden paarweise installiert, um Redundanz zu gewährleisten und die Wartung der Switches zu ermöglichen. Die Vorteile dieses ToR-Verbindungsschemas sind die geringere Kabellänge bei der Verkabelung von Geräten in einem Rack und zwischen Racks. Als ToR-Switches werden in der Regel Access-Switches der mehrschichtigen hierarchischen Netzwerktopologie verwendet.

Verkehrsrichtung

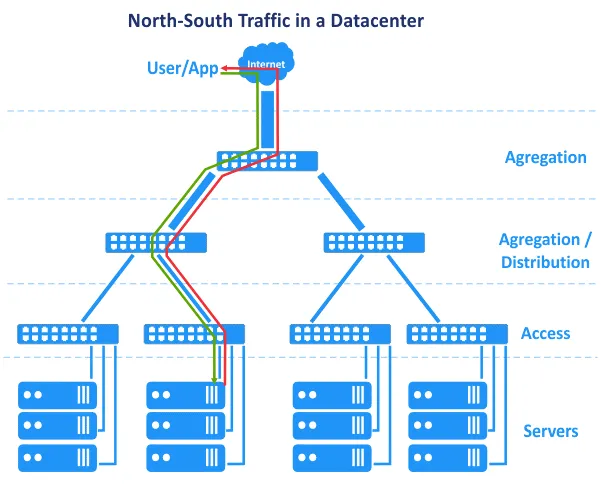

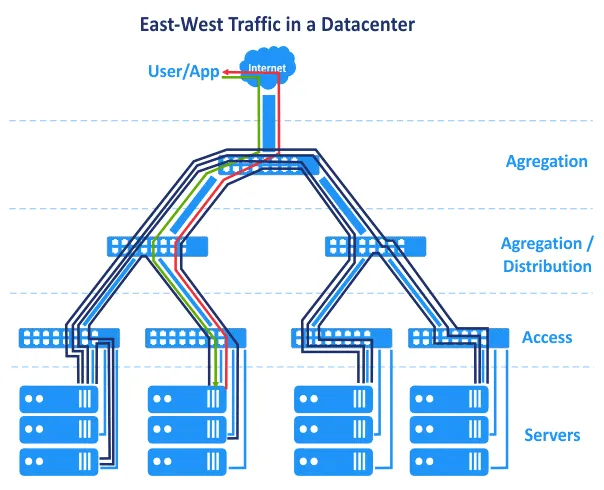

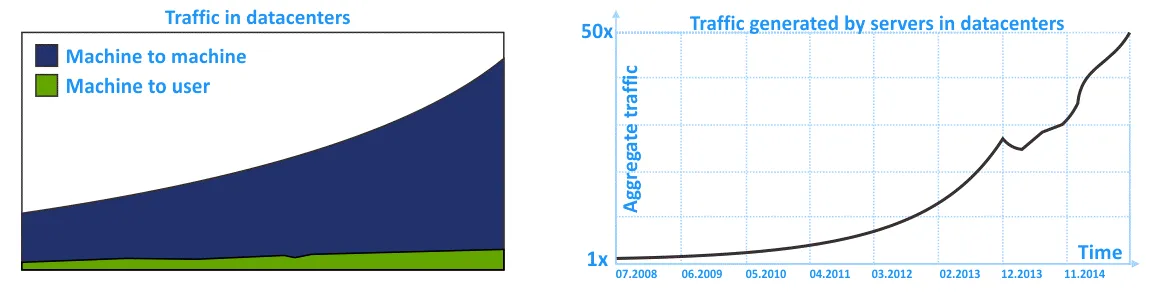

Die zuvor erläuterten Nachteile sind nicht allzu gravierend, und ein Rechenzentrumsnetzwerk kann bei ordnungsgemäßer Verwaltung erfolgreich funktionieren. Die Umstellung von L2 auf L3 in einem Teil des Netzwerks trägt zur Lösung einer Reihe von Problemen bei. Es gibt noch eine weitere Funktion, die damit zusammenhängt, wie sich Rechenzentren entwickelt haben und wie Anwendungen heute anders laufen als früher. In den 2000er Jahren wurden Anwendungen unter Verwendung einer zentralisierten Architektur erstellt, und Anwendungen der Client-Server-Architektur waren in erster Linie monolithischDas bedeutet, dass sich die Komponenten einer Anwendung auf einem einzigen Server befinden können. In unserem Diagramm wurde die Benutzeranfrage daher vom oberen Ende des Netzwerks gesendet, und die von der Anwendung generierte Anfrage wurde von der unteren Server-Ebene zurück zum oberen Ende des Netzwerks gesendet. Die Benutzeranfrage wurde auf einem einzigen Host bearbeitet. Der horizontale (Ost-West-)Verkehr zwischen den Hosts war minimal, und der Nord-Süd-Verkehr wurde bevorzugt. Die hierarchische, mehrschichtige traditionelle Netzwerktopologie, die für MSP-Netzwerke in Rechenzentren verwendet wird, erfüllt diese Anforderungen. Im Laufe der Zeit wurden jedoch bei der Entwicklung von Anwendungen neue Architekturen bevorzugt. N-Tier-Schichtenarchitektur. Anwendungskomponenten sind auf mehrere Ebenen verteilt, beispielsweise die Logikebene, die Präsentations- und die Datenebene. Webanwendungen mit mehreren Komponenten erfordern, dass diese Komponenten auf verschiedenen Servern ausgeführt werden, beispielsweise einem Webserver, einem Anwendungsserver und DatenbankserverAnwendungskomponenten, die auf mehreren Servern laufen, interagieren über ein Netzwerk miteinander.Mikroservice-Architektur geht davon aus, dass die Komponenten einer Anwendung (Dienste) in separaten, logisch isolierten Containern ausgeführt werden, die über ein Netzwerk miteinander verbunden sind. Container kann auf verschiedenen Hosts in ClusterDiese Architektur ist hoch skalierbar und wird heutzutage häufig in Clouds eingesetzt.Darüber hinaus arbeiten Rechenzentren mittlerweile mit Big Data, großen Datenbanken, Analysen, kontextbezogener Werbung, Anwendungen auf Basis künstlicher Intelligenz und anderer Software, die eine Verbindung mit mehreren Servern, Speicher-Arrays, Virtuellen Maschinen oder Containern erfordert. Anwendungskomponenten sind auf mehrere Server oder VMs im Rechenzentrum verteilt.Infolgedessen ist der Ost-West-Verkehr im MSP-Netzwerk höher als der Nord-Süd-Verkehr. Der interne Verkehr in einem Rechenzentrumsnetzwerk (Intra-DC-Verkehr) ist höher als der Verkehr von/zu einem externen Benutzer, der eine Anfrage an das Rechenzentrum sendet. Vergessen Sie nicht den internen Verkehr zwischen Speichersystemen, Datenbankreplikation, Backup und andere Service-Aktivitäten unter Verwendung des Netzwerks in einem Rechenzentrum.

N-Tier-Schichtenarchitektur. Anwendungskomponenten sind auf mehrere Ebenen verteilt, beispielsweise die Logikebene, die Präsentations- und die Datenebene. Webanwendungen mit mehreren Komponenten erfordern, dass diese Komponenten auf verschiedenen Servern ausgeführt werden, beispielsweise einem Webserver, einem Anwendungsserver und DatenbankserverAnwendungskomponenten, die auf mehreren Servern laufen, interagieren über ein Netzwerk miteinander.Mikroservice-Architektur geht davon aus, dass die Komponenten einer Anwendung (Dienste) in separaten, logisch isolierten Containern ausgeführt werden, die über ein Netzwerk miteinander verbunden sind. Container kann auf verschiedenen Hosts in ClusterDiese Architektur ist hoch skalierbar und wird heutzutage häufig in Clouds eingesetzt.Darüber hinaus arbeiten Rechenzentren mittlerweile mit Big Data, großen Datenbanken, Analysen, kontextbezogener Werbung, Anwendungen auf Basis künstlicher Intelligenz und anderer Software, die eine Verbindung mit mehreren Servern, Speicher-Arrays, Virtuellen Maschinen oder Containern erfordert. Anwendungskomponenten sind auf mehrere Server oder VMs im Rechenzentrum verteilt.Infolgedessen ist der Ost-West-Verkehr im MSP-Netzwerk höher als der Nord-Süd-Verkehr. Der interne Verkehr in einem Rechenzentrumsnetzwerk (Intra-DC-Verkehr) ist höher als der Verkehr von/zu einem externen Benutzer, der eine Anfrage an das Rechenzentrum sendet. Vergessen Sie nicht den internen Verkehr zwischen Speichersystemen, Datenbankreplikation, Backup und andere Service-Aktivitäten unter Verwendung des Netzwerks in einem Rechenzentrum. In den folgenden Diagrammen sehen Sie eine grafische Darstellung des wachsenden internen Datenverkehrs in MSP-Netzwerken innerhalb von Rechenzentren in den letzten Jahren. Der Trend zeigt, dass der Datenverkehr innerhalb von Rechenzentren stärker wächst als der ein- und ausgehende Datenverkehr.

In den folgenden Diagrammen sehen Sie eine grafische Darstellung des wachsenden internen Datenverkehrs in MSP-Netzwerken innerhalb von Rechenzentren in den letzten Jahren. Der Trend zeigt, dass der Datenverkehr innerhalb von Rechenzentren stärker wächst als der ein- und ausgehende Datenverkehr. Herkömmliche Netzwerke, die auf der traditionellen hierarchischen dreistufigen Netzwerktopologie basieren, sind zwar zuverlässig, aber nicht optimal für laterale Datenströme ausgelegt. Dies liegt daran, dass der Schwerpunkt auf L2-Netzwerken und Nord-Süd-Datenverkehr liegt.

Herkömmliche Netzwerke, die auf der traditionellen hierarchischen dreistufigen Netzwerktopologie basieren, sind zwar zuverlässig, aber nicht optimal für laterale Datenströme ausgelegt. Dies liegt daran, dass der Schwerpunkt auf L2-Netzwerken und Nord-Süd-Datenverkehr liegt.

Clos-Netzwerktopologie

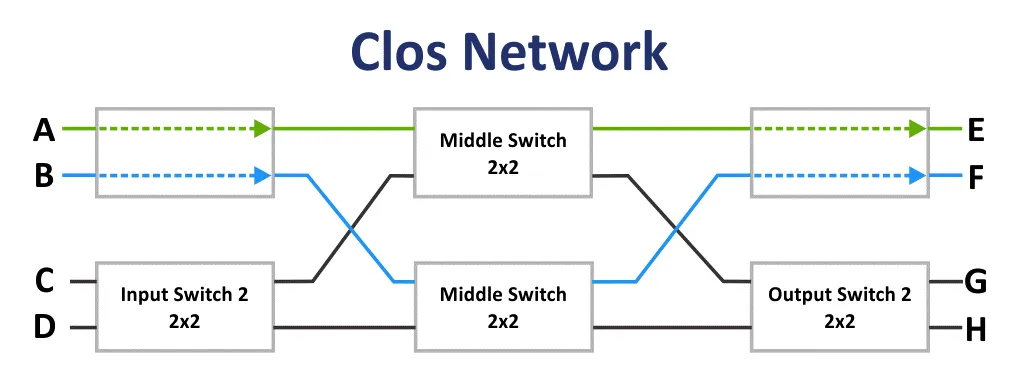

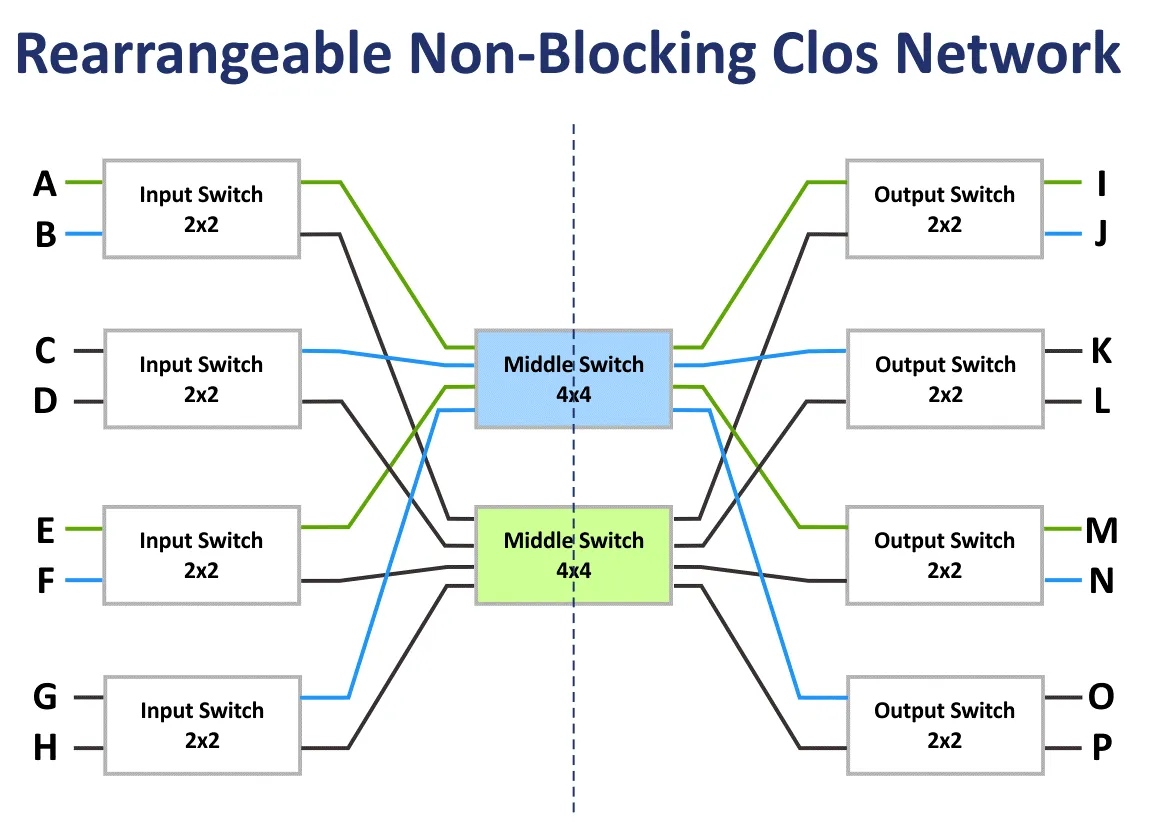

Das Clos-Netzwerk wurde ursprünglich 1938 von Edson Erwin erfunden. Im Jahr 1953 beschloss Charles Clos, nicht blockierende Vermittlungsnetzwerke in Telefoniesystemen zu verwenden, um die Kommunikation im Vergleich zum Crossbar-Kommunikationsschema rationeller zu gestalten. Bei Arrays mit einer geringen Anzahl von Verbindungen, Eingängen und Ausgängen erscheint das Verbindungsschema auf den ersten Blick schwierig. Das Clos-Netzwerk ist jedoch aufgrund einer geringeren Anzahl von Verbindungspunkten gemäß der folgenden Formel weniger komplex: 6n^(3/2) – 3nDiese Tatsache wird ab 36 Verbindungsendpunkten deutlich. Wenn m ist die Anzahl der Eingangsschalter und n die Anzahl der Ausgangsschalter ist, dann werden die Blockierungseigenschaften des Clos-Netzwerks von der folgenden Formel berechnet. Gemäß dem Clos-Theorem ist ein Clos-Netzwerk streng nicht blockierend, wenn die Anzahl der Schalter der zweiten Stufe m ≥ 2n−1.Das Blockierungsnetzwerk ist ein Netzwerk, in dem es unmöglich ist, einen Kommunikationspfad von einem freien Eingangsport zu einem freien Ausgangsport zu finden.Das nicht blockierende Netzwerk ist ein Netzwerk, in dem immer ein Pfad zum Verbinden eines beliebigen Eingangs- und Ausgangsports vorhanden ist. Nicht blockierende Netzwerke werden von Hinzufügen einer zusätzlichen Kommutierungsstufe erstellt.Das neu anordnungsfähige nicht blockierende Netzwerk ist das Netzwerk, in dem alle möglichen Pfade zum Verbinden aller Eingangs- und Ausgangsports neu angeordnet werden können.

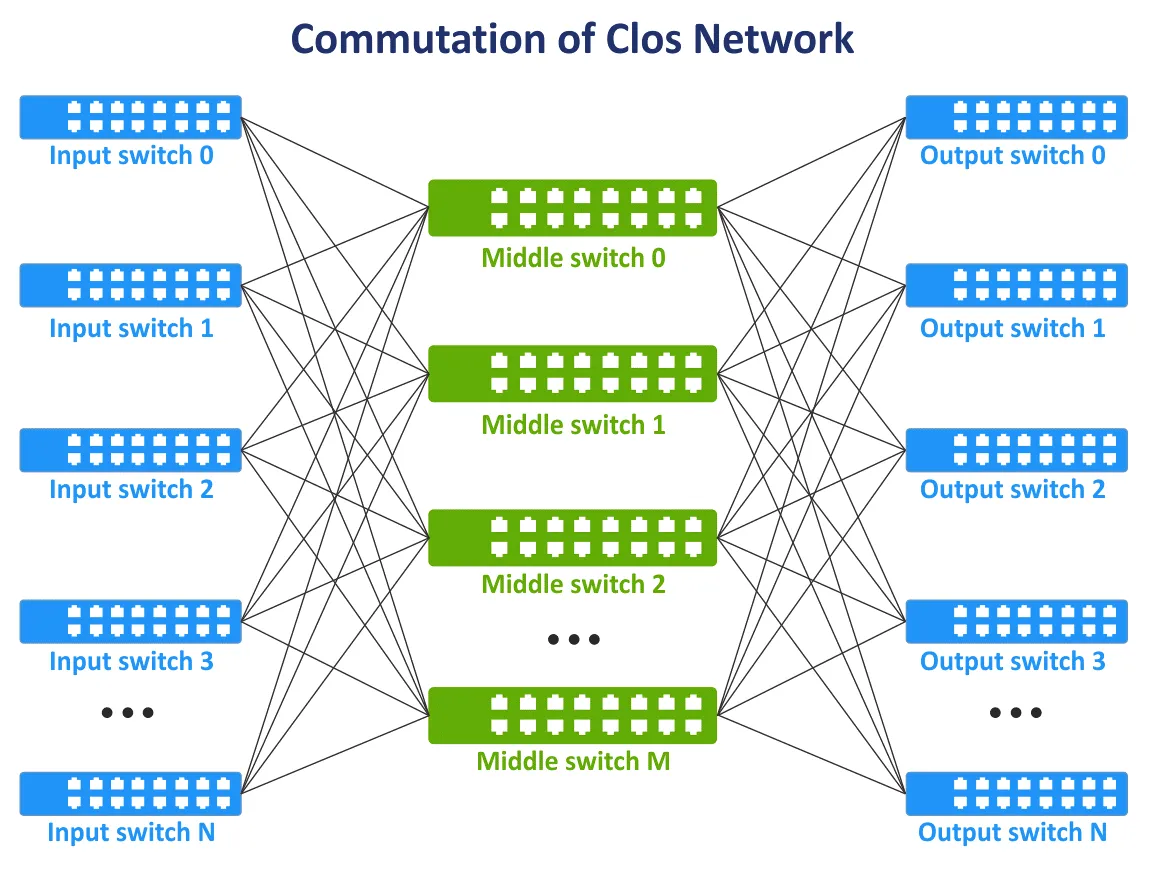

Wenn m ist die Anzahl der Eingangsschalter und n die Anzahl der Ausgangsschalter ist, dann werden die Blockierungseigenschaften des Clos-Netzwerks von der folgenden Formel berechnet. Gemäß dem Clos-Theorem ist ein Clos-Netzwerk streng nicht blockierend, wenn die Anzahl der Schalter der zweiten Stufe m ≥ 2n−1.Das Blockierungsnetzwerk ist ein Netzwerk, in dem es unmöglich ist, einen Kommunikationspfad von einem freien Eingangsport zu einem freien Ausgangsport zu finden.Das nicht blockierende Netzwerk ist ein Netzwerk, in dem immer ein Pfad zum Verbinden eines beliebigen Eingangs- und Ausgangsports vorhanden ist. Nicht blockierende Netzwerke werden von Hinzufügen einer zusätzlichen Kommutierungsstufe erstellt.Das neu anordnungsfähige nicht blockierende Netzwerk ist das Netzwerk, in dem alle möglichen Pfade zum Verbinden aller Eingangs- und Ausgangsports neu angeordnet werden können. Ende der 1990er Jahre gewann das Konzept der Clos-Netzwerke mit der Weiterentwicklung der Telekommunikationstechnologien und Computernetzwerke wieder an Bedeutung. Es besteht die Notwendigkeit, dass alle Knoten innerhalb der Netzwerkstruktur miteinander kommunizieren und, wenn möglich, keine vollständige Maschen-Topologie verwenden, wenn alle Geräte miteinander verbunden sind. Für die Verbindung von Netzwerkgeräten wurde eine neue Kommunikationsschicht hinzugefügt. Infolgedessen wurde das Clos-Netzwerkkonzept in einer neuen Form wiederbelebt. Auf dem folgenden Bild sehen Sie ein typisches Schema des dreischichtigen Clos-Netzwerks.

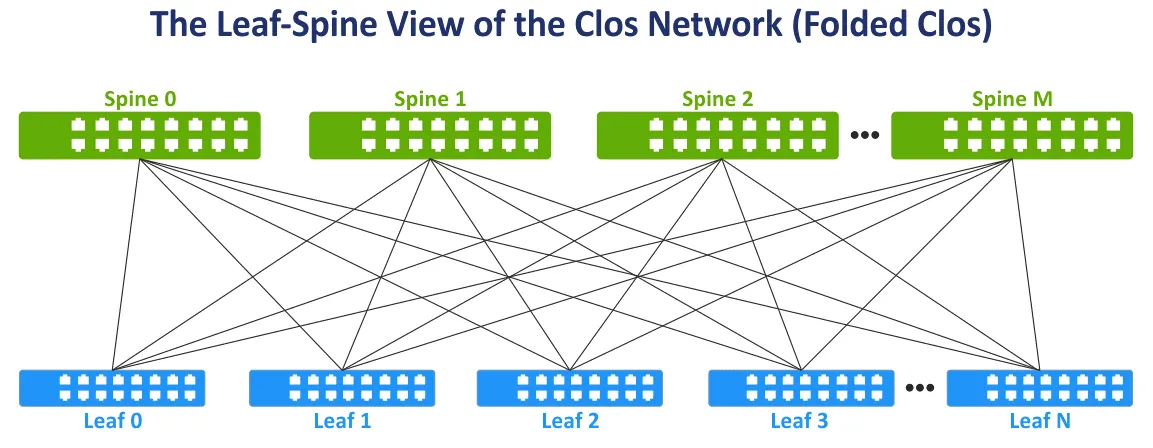

Ende der 1990er Jahre gewann das Konzept der Clos-Netzwerke mit der Weiterentwicklung der Telekommunikationstechnologien und Computernetzwerke wieder an Bedeutung. Es besteht die Notwendigkeit, dass alle Knoten innerhalb der Netzwerkstruktur miteinander kommunizieren und, wenn möglich, keine vollständige Maschen-Topologie verwenden, wenn alle Geräte miteinander verbunden sind. Für die Verbindung von Netzwerkgeräten wurde eine neue Kommunikationsschicht hinzugefügt. Infolgedessen wurde das Clos-Netzwerkkonzept in einer neuen Form wiederbelebt. Auf dem folgenden Bild sehen Sie ein typisches Schema des dreischichtigen Clos-Netzwerks. Lassen Sie uns das Ansehen des Clos-Netzwerks zur besseren Übersichtlichkeit in die weit verbreitete Leaf-Spine-Ansicht ändern, indem wir die linke und rechte Seite des Schemas falten. Diese Netzwerktopologie ist als Leaf-Spine-, Folded Clos- und 3-stufiges Clos-Netzwerk bekannt (siehe folgende Abbildung).Die Wirbelsäulenschicht. Spine-Switches werden verwendet, um alle Leaf-Switches in der Full-Mesh-Netzwerktopologie miteinander zu verbinden. Die Spine-Schicht ersetzt in gewisser Weise die Aggregationsschicht, die in der traditionellen dreistufigen hierarchischen Netzwerktopologie verwendet wird. Die Spine-Schicht ist jedoch nicht direkt mit der Aggregationsschicht gleichzusetzen. Die Hauptaufgabe der Spine-Schicht ist die schnelle Übertragung von Daten von einem Leaf zu einem anderen. Geräte sind nicht mit Spine-Switches verbunden.Die Blattschicht. In diesem Modell sind Server oder andere Geräte im Rechenzentrum mit Leaves verbunden. Alle Leaves sind mit allen Spines verbunden. Dadurch entsteht eine hohe Anzahl von Netzwerkverbindungen mit gleicher Bandbreite zwischen allen Servern. Zwischen Spines und Leaves bestehen L3-Verbindungen (L3 im OSI-Modell).Wenn Datenverkehr im Netzwerk von der Quelle zum Ziel übertragen wird, ist die Anzahl der Hops gleich (beispielsweise sind drei Hops erforderlich, um Daten zwischen beliebigen Servern innerhalb des zweistufigen Leaf-Spine-Netzwerks im folgenden Schema zu übertragen). Die Latenz ist vorhersehbar und gering. Die Netzwerkkapazität wird ebenfalls erhöht, da nun kein STP mehr verwendet werden muss. Wenn STP für redundante Verbindungen zwischen Switches verwendet wird, kann jeweils nur eine Verbindung aktiv sein.In der Leaf-Spine-Netzwerktopologie kann das Equal-Cost Multipath (ECMP)-Routingprotokoll verwendet werden, um den Datenverkehr auszugleichen und Netzwerkschleifen zu verhindern (für L3-Netzwerkverbindungen). Die Protokolle BGP, OSPF, EIGRP und ISIS können ebenfalls verwendet werden.

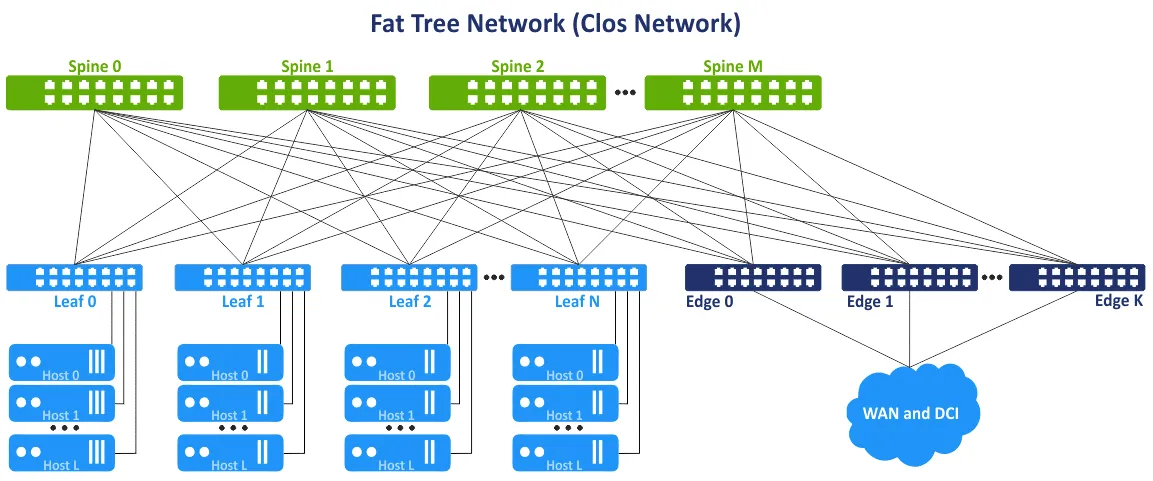

Lassen Sie uns das Ansehen des Clos-Netzwerks zur besseren Übersichtlichkeit in die weit verbreitete Leaf-Spine-Ansicht ändern, indem wir die linke und rechte Seite des Schemas falten. Diese Netzwerktopologie ist als Leaf-Spine-, Folded Clos- und 3-stufiges Clos-Netzwerk bekannt (siehe folgende Abbildung).Die Wirbelsäulenschicht. Spine-Switches werden verwendet, um alle Leaf-Switches in der Full-Mesh-Netzwerktopologie miteinander zu verbinden. Die Spine-Schicht ersetzt in gewisser Weise die Aggregationsschicht, die in der traditionellen dreistufigen hierarchischen Netzwerktopologie verwendet wird. Die Spine-Schicht ist jedoch nicht direkt mit der Aggregationsschicht gleichzusetzen. Die Hauptaufgabe der Spine-Schicht ist die schnelle Übertragung von Daten von einem Leaf zu einem anderen. Geräte sind nicht mit Spine-Switches verbunden.Die Blattschicht. In diesem Modell sind Server oder andere Geräte im Rechenzentrum mit Leaves verbunden. Alle Leaves sind mit allen Spines verbunden. Dadurch entsteht eine hohe Anzahl von Netzwerkverbindungen mit gleicher Bandbreite zwischen allen Servern. Zwischen Spines und Leaves bestehen L3-Verbindungen (L3 im OSI-Modell).Wenn Datenverkehr im Netzwerk von der Quelle zum Ziel übertragen wird, ist die Anzahl der Hops gleich (beispielsweise sind drei Hops erforderlich, um Daten zwischen beliebigen Servern innerhalb des zweistufigen Leaf-Spine-Netzwerks im folgenden Schema zu übertragen). Die Latenz ist vorhersehbar und gering. Die Netzwerkkapazität wird ebenfalls erhöht, da nun kein STP mehr verwendet werden muss. Wenn STP für redundante Verbindungen zwischen Switches verwendet wird, kann jeweils nur eine Verbindung aktiv sein.In der Leaf-Spine-Netzwerktopologie kann das Equal-Cost Multipath (ECMP)-Routingprotokoll verwendet werden, um den Datenverkehr auszugleichen und Netzwerkschleifen zu verhindern (für L3-Netzwerkverbindungen). Die Protokolle BGP, OSPF, EIGRP und ISIS können ebenfalls verwendet werden. Dieses Netzwerkkonzept wird auch als mehrschichtige Fat-Tree-Netzwerktopologie bezeichnet. Die Idee besteht darin, Engpässe in den oberen Schichten des Baums (nahe der Baumwurzel) zu vermeiden und zusätzliche Verbindungen hinzuzufügen, um die Bandbreite in diesen Segmenten zu erhöhen. Dadurch entsteht eine zunehmende Kapazität in Richtung der Wurzel. Der Fat Tree ist ein Sonderfall des Clos-Netzwerks. Das dreistufige Clos-Netzwerk wird nach dem Folding in ein zweistufiges Leaf-Spine-Netzwerk umgewandelt. Leaf-Switches oder Leaf-Edge-Switches/Router können für den Zugriff auf externe Netzwerke und andere Rechenzentren verwendet werden.

Dieses Netzwerkkonzept wird auch als mehrschichtige Fat-Tree-Netzwerktopologie bezeichnet. Die Idee besteht darin, Engpässe in den oberen Schichten des Baums (nahe der Baumwurzel) zu vermeiden und zusätzliche Verbindungen hinzuzufügen, um die Bandbreite in diesen Segmenten zu erhöhen. Dadurch entsteht eine zunehmende Kapazität in Richtung der Wurzel. Der Fat Tree ist ein Sonderfall des Clos-Netzwerks. Das dreistufige Clos-Netzwerk wird nach dem Folding in ein zweistufiges Leaf-Spine-Netzwerk umgewandelt. Leaf-Switches oder Leaf-Edge-Switches/Router können für den Zugriff auf externe Netzwerke und andere Rechenzentren verwendet werden.

Vorteile der Blatt-Rückgrat-Netzwerktopologie

Die Leaf-Spine-Netzwerktopologie bietet gegenüber der Access-Aggregation-Core-Netzwerktopologie eine Reihe von Vorteilen. Diese Vorteile sind der Grund dafür, dass in Rechenzentren die Leaf-Spine-Netzwerktopologie zum Einsatz kommt.Optimierte Verbindungen. Verbindungen mit hoher Bandbreite zwischen Netzwerkgeräten sind optimal für den Ost-West-Verkehr. Es gibt keine ungenutzten Verbindungen (da L3 anstelle von L2 verwendet wird). ECMP wird für hohe Effizienz empfohlen, und STP ist nicht erforderlich.Zuverlässigkeit. Der Ausfall eines Geräts oder die Unterbrechung einer Verbindung hat keine wesentlichen negativen Auswirkungen und Nachteile. Wenn der ToR-Switch, der als Leaf-Switch fungiert, ausfällt, ist das entsprechende Rack betroffen. Wenn ein Spine-Switch ausfällt, verschlechtert sich die Netzwerkbandbreite, jedoch nicht wesentlich im Vergleich zur herkömmlichen dreistufigen hierarchischen Netzwerktopologie. Die Verschlechterung der Bandbreite für die Spine-Leaf-Topologie beträgt 1/n, wo n ist die Anzahl der Spines. Die Bandbreitenverschlechterung für die hierarchische Topologie beträgt 50% in diesem Fall.Hohe Skalierbarkeit. Sie können neue Blätter hinzufügen, bis Sie freie Ports auf den Spines haben. Durch Hinzufügen neuer Spines können Sie die Uplinks der Blätter erhöhen. Fügen Sie Edge-Switches/Router hinzu, um die Bandbreite zu externen Netzwerken zu erhöhen. Der traditionelle Ansatz zur Erhöhung der Bandbreite und zum Verbinden weiterer Server für die hierarchische Netzwerktopologie mit drei Schichten besteht darin, mehr Netzwerkkarten mit mehr Ports, Netzwerkgeräte mit schnelleren Netzwerkschnittstellen und generell leistungsfähigere Hardware hinzuzufügen. Dieser traditionelle Ansatz wird als hochskalieren oder vertikale Skalierbarkeit.Bei Verwendung der Leaf-Spine-Netzwerktopologie in Rechenzentren und für MSP-Netzwerke können Sie eine zusätzliche Spine-Ebene hinzufügen. Dieser Ansatz wird als horizontale Skalierbarkeit oder ausgebreitetDurch Hinzufügen eines typischen Netzwerkgeräts wie einem Switch/Router wird die Skalierbarkeit linear erhöht.Wartung. Sie können Spines zur Wartung oder zum Austausch ganz einfach von den Netzwerken trennen. Wartungsarbeiten an Spines sind im Vergleich zu God Boxes nicht risikobehaftet, da Spines keine intelligenten Funktionalitäten haben und die Bandbreitenreduzierung nach dem Trennen minimal ist.

Mehrschichtiges Clos-Netzwerk

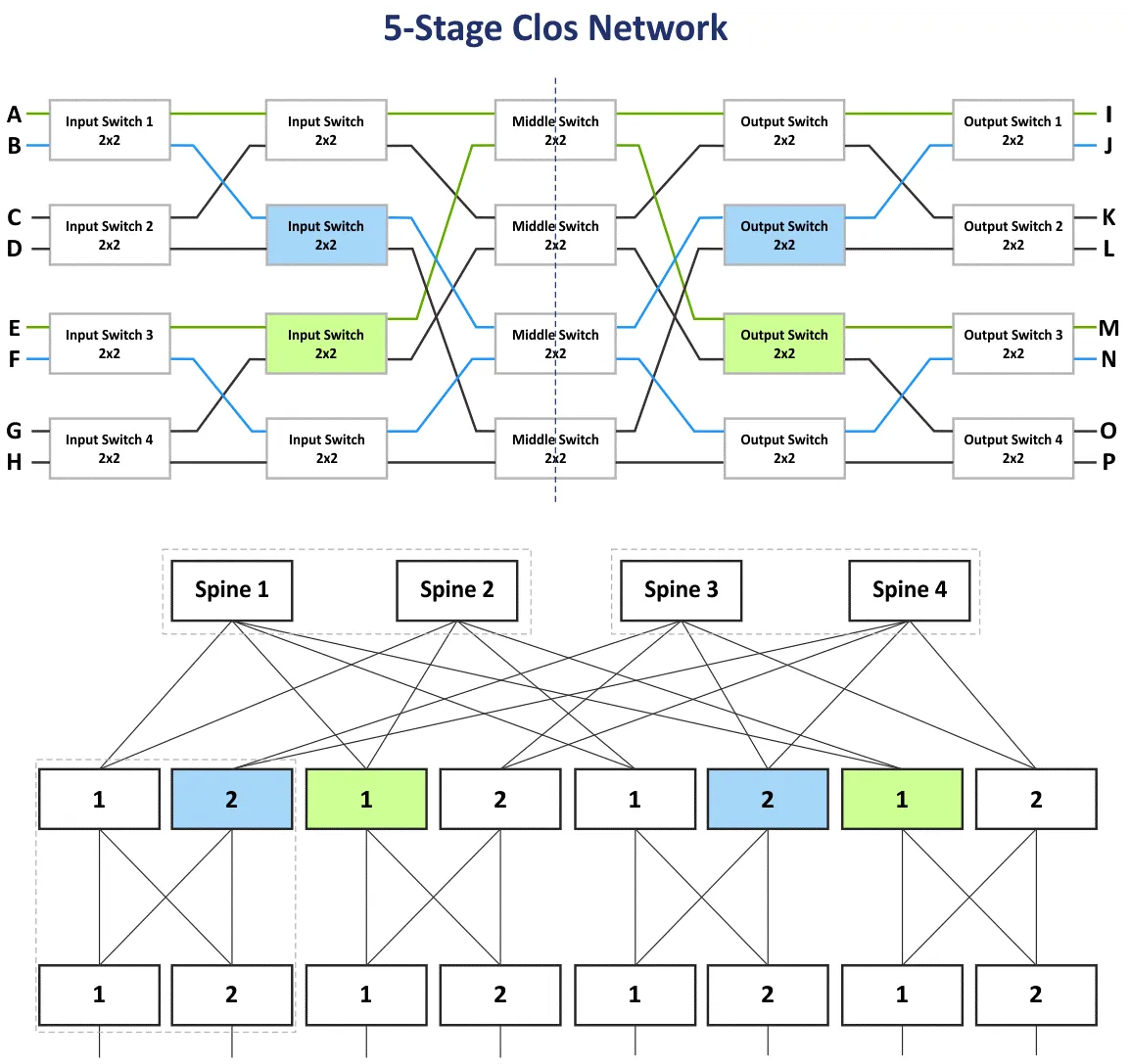

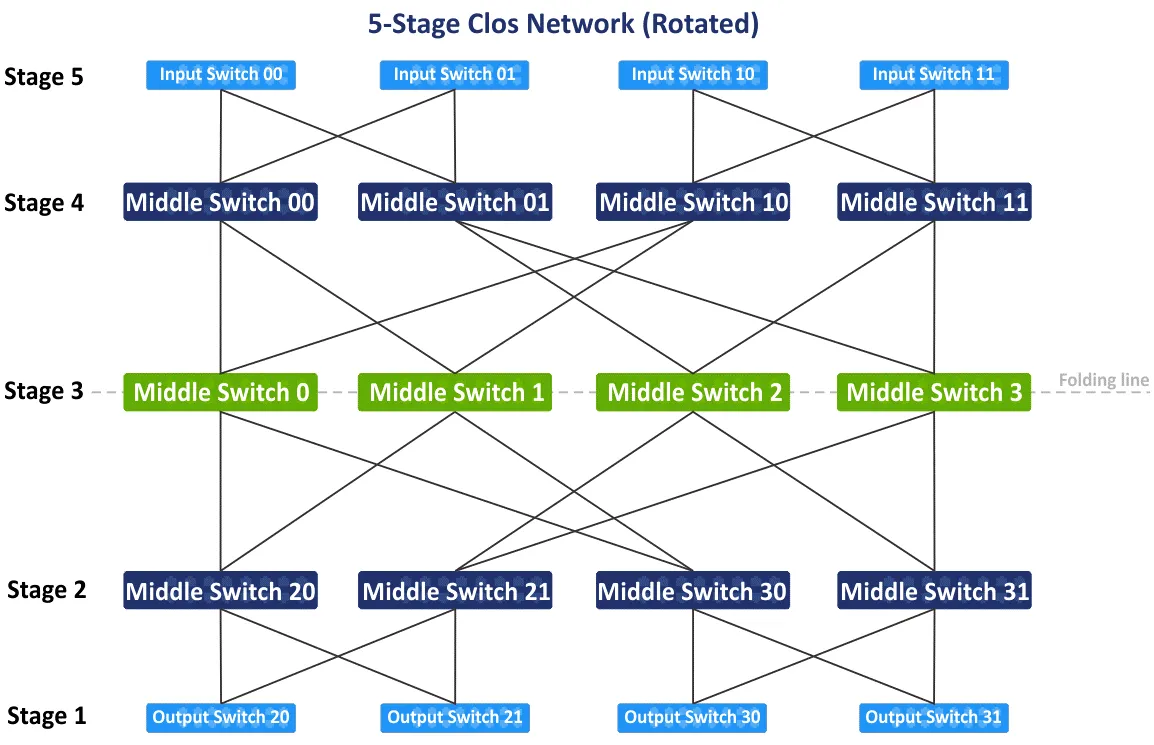

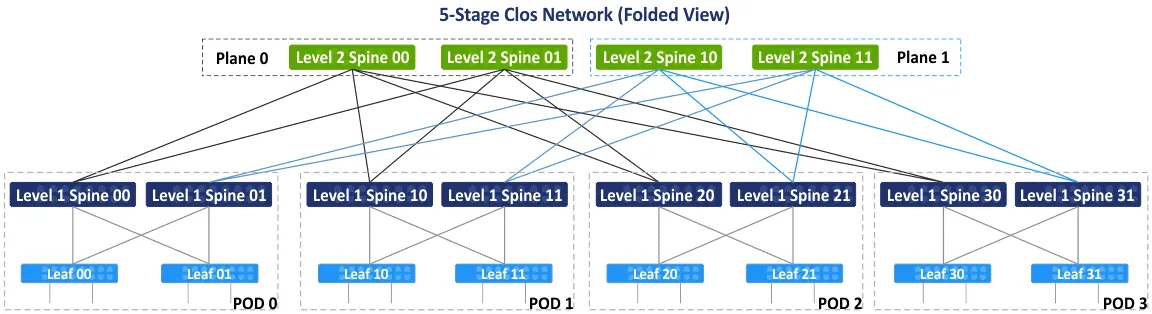

Im vorherigen Abschnitt habe ich das dreistufige Clos-Netzwerk mit den Stufen Eingangsschalter, Mittelschalter und Ausgangsschalter erläutert. Da Geräte auf der Eingangs- und Ausgangsstufe zum Empfangen/Senden von Daten verwendet werden, kann das Netzwerkschema von einer Mittellinie, die aus einer zweistufigen Leaf-Spine-Netzwerktopologie besteht, gefaltet werden. Sie können weitere Stufen hinzufügen und ein mehrstufiges Clos-Netzwerk aufbauen, um mehr Netzwerkgeräte an dieses Netzwerk zu verbinden. In diesem Fall haben Sie fünf Stufen: Eingangsschalter, mittlerer Schalter 1, mittlerer Schalter 2, mittlerer Schalter 3, Ausgangsschalter.In der folgenden Abbildung sehen Sie das ursprüngliche Schema des fünfstufigen nicht blockierenden Clos-Netzwerks nach der Neuanordnung der blauen und grünen Blöcke. Es gibt auch die gefaltete Leaf-Spine-Ansicht oder die Fat-Tree-(4,3)-Ansicht (da es 4 Spine-Switches und 3 Stufen im Leaf-Spine-Schema gibt), aber schauen wir uns Schritt für Schritt an, wie Geräte in das 5-stufige Clos-Netzwerk verbunden werden. Eine Clos-Netzwerktopologie mit mehr als 5 Stufen ist nicht üblich und wird in der Praxis nicht verwendet, da die Anzahl der Verbindungen zu groß ist. Nach der Drehung des ursprünglichen Schemas des fünfstufigen Clos-Netzwerks um 90 Grad im Uhrzeigersinn erhalten Sie das traditionelle Ansehen mit Eingangsschaltern, Ausgangsschaltern und drei Stufen der mittleren Schalter. Zeichnen wir die Faltlinie über die mittleren Schalter in der Mitte des Schemas, um das gefaltete Ansehen des fünfstufigen Clos-Netzwerks zu erhalten.

Nach der Drehung des ursprünglichen Schemas des fünfstufigen Clos-Netzwerks um 90 Grad im Uhrzeigersinn erhalten Sie das traditionelle Ansehen mit Eingangsschaltern, Ausgangsschaltern und drei Stufen der mittleren Schalter. Zeichnen wir die Faltlinie über die mittleren Schalter in der Mitte des Schemas, um das gefaltete Ansehen des fünfstufigen Clos-Netzwerks zu erhalten. Nach dem Zusammenfalten des Schemas erhalten Sie die gefaltete Ansicht oder die Blatt-Rückgrat-Ansicht dieser Art von Netzwerktopologien (siehe folgendes Schema). Es gibt 4 einzelne Gruppen, die als Lieferpunkte (PODs) fungieren. Der POD ist die universelle Einheit für den Aufbau von Rechenzentren. PODs sind mit den Rückgräten der ersten Ebene verbunden. Wenn Sie Ihr Rechenzentrum erweitern oder weitere Server/Netzwerkgeräte hinzufügen müssen, fügen Sie neue PODs hinzu und verbinden Sie diese mit der Netzwerkstruktur. Die Spines eines PODs sind über Spines der zweiten Ebene mit den Spines anderer PODs verbunden. Gleichzeitig sind nicht alle L1-Spines mit allen L2-Spines verbunden, sondern durch Ebenen unterteilt.Es gibt zwei Ebenen – Ebene 0 und Ebene 1 im folgenden Schema. Dieses Konzept wird aufgrund der begrenzten Anzahl von Ports auf den Spines verwendet, da in diesem Fall keine vollständig verbundene Netzwerktopologie erstellt werden kann. Im folgenden Schema hat jede Spine eine Begrenzung von 4 Ports. Gemäß der Grundidee basiert das nicht blockierende Clos-Netzwerk auf denselben Elementen (4-Port-Switches, wie unten zu sehen).

Nach dem Zusammenfalten des Schemas erhalten Sie die gefaltete Ansicht oder die Blatt-Rückgrat-Ansicht dieser Art von Netzwerktopologien (siehe folgendes Schema). Es gibt 4 einzelne Gruppen, die als Lieferpunkte (PODs) fungieren. Der POD ist die universelle Einheit für den Aufbau von Rechenzentren. PODs sind mit den Rückgräten der ersten Ebene verbunden. Wenn Sie Ihr Rechenzentrum erweitern oder weitere Server/Netzwerkgeräte hinzufügen müssen, fügen Sie neue PODs hinzu und verbinden Sie diese mit der Netzwerkstruktur. Die Spines eines PODs sind über Spines der zweiten Ebene mit den Spines anderer PODs verbunden. Gleichzeitig sind nicht alle L1-Spines mit allen L2-Spines verbunden, sondern durch Ebenen unterteilt.Es gibt zwei Ebenen – Ebene 0 und Ebene 1 im folgenden Schema. Dieses Konzept wird aufgrund der begrenzten Anzahl von Ports auf den Spines verwendet, da in diesem Fall keine vollständig verbundene Netzwerktopologie erstellt werden kann. Im folgenden Schema hat jede Spine eine Begrenzung von 4 Ports. Gemäß der Grundidee basiert das nicht blockierende Clos-Netzwerk auf denselben Elementen (4-Port-Switches, wie unten zu sehen). Auf den ersten Blick können Begriffe wie Clos, gefaltetes Clos, Leaf-Spine und Fat Tree verwirrend sein. Lassen Sie mich diese Begriffe erläutern.Clos oder Clos-Netzwerk ist der Begriff, der die theoretische Grundlage des Clos-Netzwerktopologietyps umfasst.Gefaltetes Clos ist eine übersichtlichere Darstellung des Clos-Netzwerks, bei der Eingänge und Ausgänge die gleiche Rolle haben und an demselben Standort befinden.Blattstiel ist eine Netzwerktopologie, die auf dem Clos-Netzwerkschema basiert und in der Praxis in Rechenzentren zum Aufbau von Netzwerken, einschließlich MSP-Netzwerken, verwendet wird.Fetter Baum wird in der Regel als eine Variante des Clos-Netzwerks bezeichnet. Dieser Begriff ist besonders verwirrend, da einige Artikel den Fat Tree als klassisches Access-Aggregation-Core-Netzwerk bezeichnen. Ich beziehe mich auf das Dokument RFC 7938, in dem es heißt, dass der Fat Tree auf der gefalteten Clos-Netzwerktopologie basiert.

Auf den ersten Blick können Begriffe wie Clos, gefaltetes Clos, Leaf-Spine und Fat Tree verwirrend sein. Lassen Sie mich diese Begriffe erläutern.Clos oder Clos-Netzwerk ist der Begriff, der die theoretische Grundlage des Clos-Netzwerktopologietyps umfasst.Gefaltetes Clos ist eine übersichtlichere Darstellung des Clos-Netzwerks, bei der Eingänge und Ausgänge die gleiche Rolle haben und an demselben Standort befinden.Blattstiel ist eine Netzwerktopologie, die auf dem Clos-Netzwerkschema basiert und in der Praxis in Rechenzentren zum Aufbau von Netzwerken, einschließlich MSP-Netzwerken, verwendet wird.Fetter Baum wird in der Regel als eine Variante des Clos-Netzwerks bezeichnet. Dieser Begriff ist besonders verwirrend, da einige Artikel den Fat Tree als klassisches Access-Aggregation-Core-Netzwerk bezeichnen. Ich beziehe mich auf das Dokument RFC 7938, in dem es heißt, dass der Fat Tree auf der gefalteten Clos-Netzwerktopologie basiert.

Berechnungen

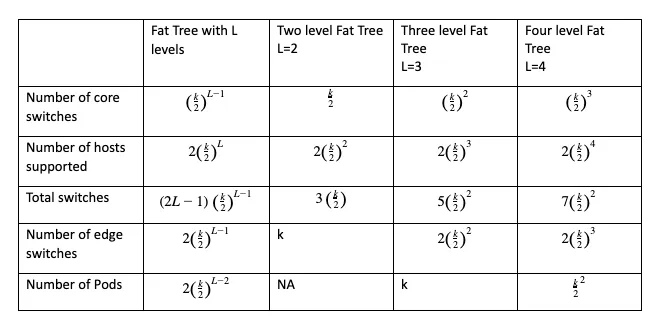

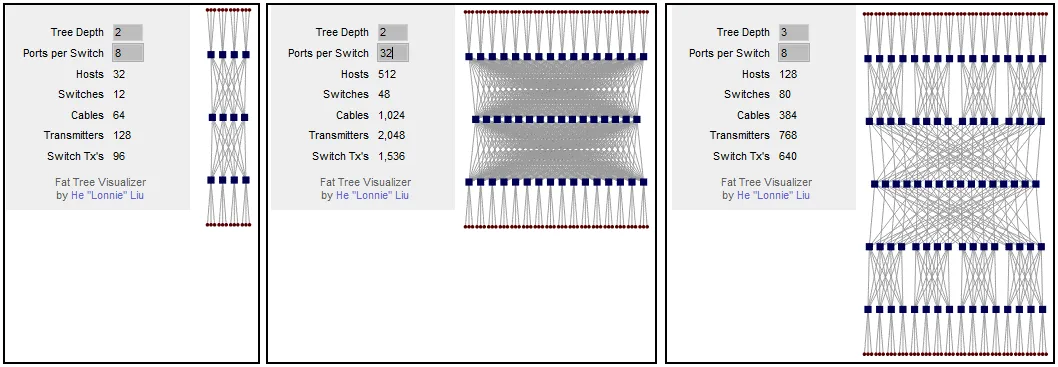

Sie können die Anzahl der erforderlichen Core-Switches, Edge-Switches und Switches insgesamt sowie die Gesamtzahl der Hosts, die mit dem Netzwerk der ausgewählten Konfiguration verbunden werden können, von den folgenden Formeln berechnen:k ist die Anzahl der Ports im SwitchL ist die Anzahl der Ebenen in der Leaf-Spine-Netzwerktopologie (Fat Tree). Der wichtigste Parameter, den Sie vor dem Aufbau Ihres Netzwerks berechnen müssen, ist die Anzahl der unterstützten Hosts. Die Fat-Tree-Konfiguration kann als FT(k, L) geschrieben werden. FT(32,3) ist beispielsweise ein dreistufiges Fat-Tree-Netzwerk mit 32-Port-Switches. Sie können dies verwenden kostenloser Taschenrechner für Clos-Netzwerke, das auch das Visualisierungsschema für die ausgewählte Konfiguration generiert.Sie können berechnen, dass Sie 32 Hosts an das Netzwerk verbinden können, wenn Ihr Fat-Tree-Netzwerkschema 2 Ebenen und 8 Ports pro Switch hat. Wenn Sie die Anzahl der Ports pro Switch erhöhen, steigt die Anzahl der unterstützten Hosts auf 512. Wie Sie sehen können, hängt die Anzahl der verbundenen Hosts von der Anzahl der Ports an jedem Switch ab. Wenn Sie den Fat-Tree auf 2 Ebenen belassen (das 3-stufige Clos-Netzwerk) und die Anzahl der Ports pro Switch erhöhen, steigt die Anzahl der Spines erheblich. Sie können dieses Problem lösen, indem Sie dem Fat-Tree eine weitere Ebene hinzufügen. Bei einem dreistufigen Fat-Tree können Sie 128 Hosts verbinden, wenn die Anzahl der Ports pro Switch 8 beträgt.

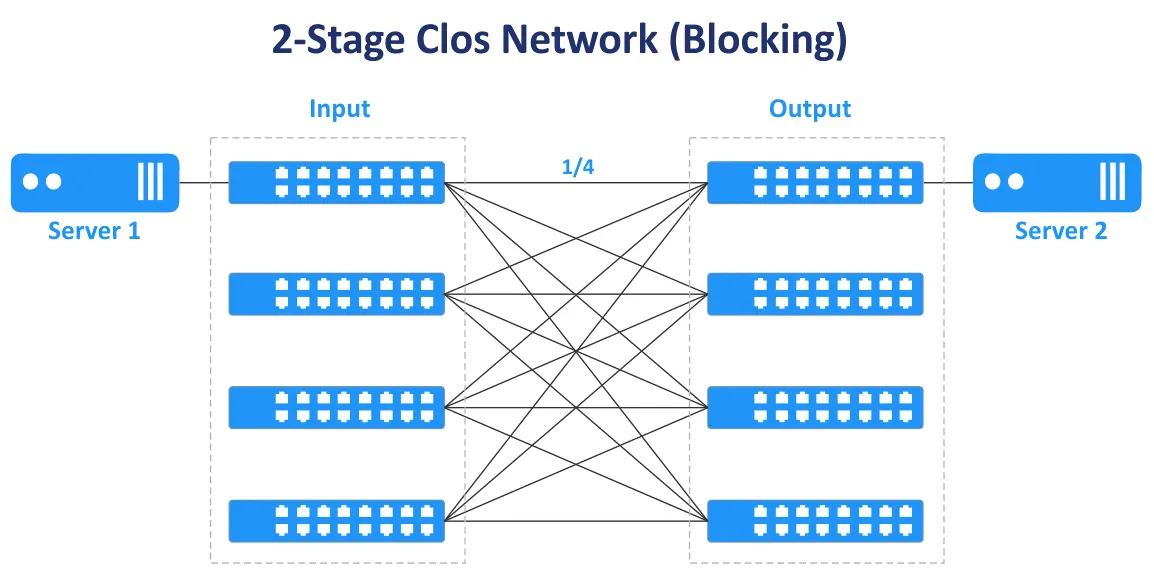

Der wichtigste Parameter, den Sie vor dem Aufbau Ihres Netzwerks berechnen müssen, ist die Anzahl der unterstützten Hosts. Die Fat-Tree-Konfiguration kann als FT(k, L) geschrieben werden. FT(32,3) ist beispielsweise ein dreistufiges Fat-Tree-Netzwerk mit 32-Port-Switches. Sie können dies verwenden kostenloser Taschenrechner für Clos-Netzwerke, das auch das Visualisierungsschema für die ausgewählte Konfiguration generiert.Sie können berechnen, dass Sie 32 Hosts an das Netzwerk verbinden können, wenn Ihr Fat-Tree-Netzwerkschema 2 Ebenen und 8 Ports pro Switch hat. Wenn Sie die Anzahl der Ports pro Switch erhöhen, steigt die Anzahl der unterstützten Hosts auf 512. Wie Sie sehen können, hängt die Anzahl der verbundenen Hosts von der Anzahl der Ports an jedem Switch ab. Wenn Sie den Fat-Tree auf 2 Ebenen belassen (das 3-stufige Clos-Netzwerk) und die Anzahl der Ports pro Switch erhöhen, steigt die Anzahl der Spines erheblich. Sie können dieses Problem lösen, indem Sie dem Fat-Tree eine weitere Ebene hinzufügen. Bei einem dreistufigen Fat-Tree können Sie 128 Hosts verbinden, wenn die Anzahl der Ports pro Switch 8 beträgt. Wenn Sie die Anzahl der Ports pro Switch auf 32 erhöhen, können Sie mit dieser Netzwerktopologie 8192 Hosts verbinden. Diese Zahl für das 5-stufige Clos-Netzwerk ist 16-mal höher als die für das 3-stufige Clos-Netzwerk. Behalten Sie die Einschränkungen des Server-Racks, wenn Sie das Installationsschema für Server und Netzwerkgeräte im Rechenzentrum planen.Ungerade Stufenanzahlen werden verwendet, um nicht blockierende Clos-Netzwerke aufzubauen (3, 5, 7 usw.). Das 2-stufige Clos-Netzwerk bietet keine nicht blockierenden Verbindungen und keine Mehrfachverbindungen zwischen Switches.In der folgenden Abbildung sehen Sie, dass es im Fall des zweistufigen Clos-Netzwerks nur einen Übertragungsweg gibt, um Server 1 und Server 2 zu verbinden. Nur ¼ der Ports sind verbunden, die anderen Ports sind nicht verbunden und blockieren Sie.

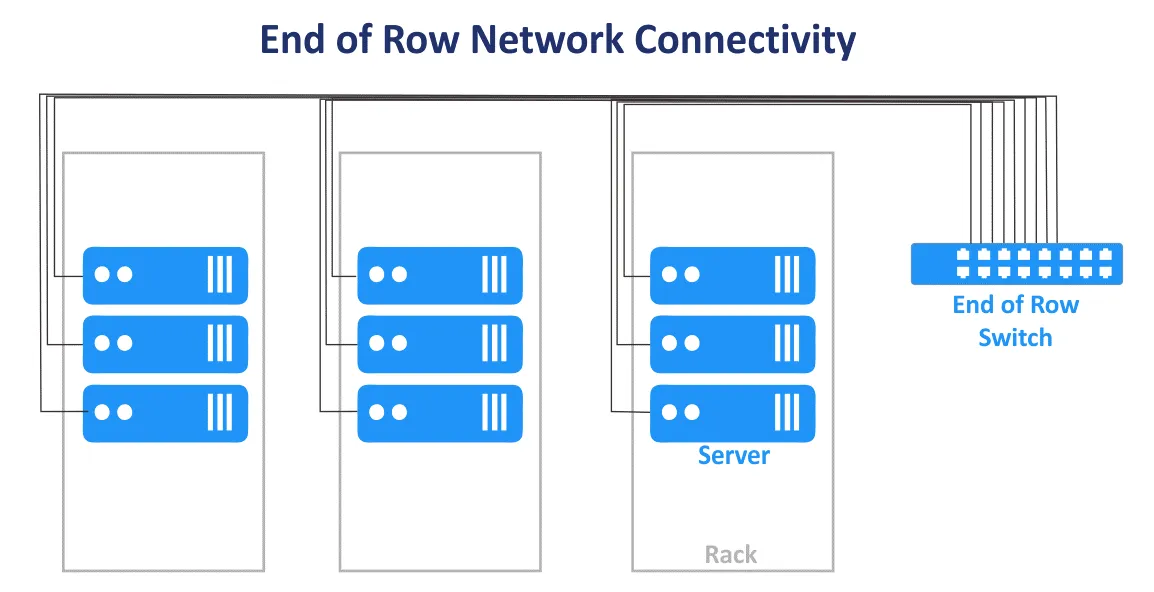

Wenn Sie die Anzahl der Ports pro Switch auf 32 erhöhen, können Sie mit dieser Netzwerktopologie 8192 Hosts verbinden. Diese Zahl für das 5-stufige Clos-Netzwerk ist 16-mal höher als die für das 3-stufige Clos-Netzwerk. Behalten Sie die Einschränkungen des Server-Racks, wenn Sie das Installationsschema für Server und Netzwerkgeräte im Rechenzentrum planen.Ungerade Stufenanzahlen werden verwendet, um nicht blockierende Clos-Netzwerke aufzubauen (3, 5, 7 usw.). Das 2-stufige Clos-Netzwerk bietet keine nicht blockierenden Verbindungen und keine Mehrfachverbindungen zwischen Switches.In der folgenden Abbildung sehen Sie, dass es im Fall des zweistufigen Clos-Netzwerks nur einen Übertragungsweg gibt, um Server 1 und Server 2 zu verbinden. Nur ¼ der Ports sind verbunden, die anderen Ports sind nicht verbunden und blockieren Sie. Die Überzeichnungsquote beim Abonnement ist das Verhältnis der Eingangsbandbreite zur Ausgangsbandbreite in Richtung von den unteren zu den höheren Schichten. Das Überbuchungsverhältnis variiert in der Regel zwischen 2 und 4.Beispiel: Ein Switch verfügt über 48 10-Gbit-Ports und 4 40-Gbit-Uplink-Ports. Die Gesamtbandbreite der Downlinks zu den Servern beträgt 48×10=480 Gbit/s. Die Gesamtgeschwindigkeit der Uplinks beträgt 4 x 40 = 160 Gbit/s. Das Überbuchungsverhältnis beträgt 480/160 = 4.Wenn die Gesamtbandbreitengeschwindigkeit für alle Downlink- und Uplink-Ports des Switches gleich ist, ist der Switch nicht überbucht, und es gibt in diesem Fall keine Engpässe. Ein Überbuchungsverhältnis von 1:1 ist der Idealfall. Schätzen Sie den Datenverkehr in verschiedene Richtungen, bevor Sie Switches mit der entsprechenden Geschwindigkeit und Anzahl von Ports kaufen.Switches mit einem Überbuchungsverhältnis von mehr als 1 werden häufig auf der Leaf-Ebene in Netzwerken mit Leaf-Spine-Netzwerktopologie verwendet. Nicht überbelegte Switches sollten auf der Spine-Ebene verwendet werden. Switches auf der Leaf-Ebene in der Leaf-Spine-Netzwerktopologie werden in der Regel als ToR-Switches verwendet. Es ist jedoch möglich, Leaf-Switches als End-of-Row-Switches zu installieren.

Die Überzeichnungsquote beim Abonnement ist das Verhältnis der Eingangsbandbreite zur Ausgangsbandbreite in Richtung von den unteren zu den höheren Schichten. Das Überbuchungsverhältnis variiert in der Regel zwischen 2 und 4.Beispiel: Ein Switch verfügt über 48 10-Gbit-Ports und 4 40-Gbit-Uplink-Ports. Die Gesamtbandbreite der Downlinks zu den Servern beträgt 48×10=480 Gbit/s. Die Gesamtgeschwindigkeit der Uplinks beträgt 4 x 40 = 160 Gbit/s. Das Überbuchungsverhältnis beträgt 480/160 = 4.Wenn die Gesamtbandbreitengeschwindigkeit für alle Downlink- und Uplink-Ports des Switches gleich ist, ist der Switch nicht überbucht, und es gibt in diesem Fall keine Engpässe. Ein Überbuchungsverhältnis von 1:1 ist der Idealfall. Schätzen Sie den Datenverkehr in verschiedene Richtungen, bevor Sie Switches mit der entsprechenden Geschwindigkeit und Anzahl von Ports kaufen.Switches mit einem Überbuchungsverhältnis von mehr als 1 werden häufig auf der Leaf-Ebene in Netzwerken mit Leaf-Spine-Netzwerktopologie verwendet. Nicht überbelegte Switches sollten auf der Spine-Ebene verwendet werden. Switches auf der Leaf-Ebene in der Leaf-Spine-Netzwerktopologie werden in der Regel als ToR-Switches verwendet. Es ist jedoch möglich, Leaf-Switches als End-of-Row-Switches zu installieren.

Wesentliche Unterschiede

Beim Aufbau eines Netzwerks beeinflussen einige Entscheidungen die Struktur des Netzwerks. Hier sind einige Entweder-oder-Entscheidungen, die sich auf die Funktionalität des Netzwerks auswirken.

Oberteil des Racks vs. Ende der Reihe

Das Oberteil des Gestells (ToR) Netzwerkverbindungsschema in einem Rechenzentrum, bei dem ein oder mehrere Switches in jedem Rack installiert sind. Kurze Patchkabel werden verwendet, um die Oberseite des Rack-Switches mit anderen Netzwerkgeräten und Servern innerhalb des Racks zu verbinden. ToR-Switches verfügen in der Regel über Hochgeschwindigkeits-Uplinks zu den Switches/Routern der höheren Ebene und können mit Glasfaserkabeln verbunden werden. Der Vorteil besteht darin, dass bei Verwendung dieses Verbindungsschemas für ein MSP-Netzwerk keine dicken Kabelstränge von jedem Rack im Rechenzentrum verlegt werden müssen. Die Kabelnutzung im Rechenzentrum ist bei Verwendung des ToR-Schemas rationeller. In diesem Fall geben Sie weniger für die Verkabelung aus und profitieren von einem besseren Kabelmanagement. Sie können jedes Rack als einzelnes Modul verwalten, ohne andere Racks innerhalb eines Rechenzentrums zu beeinträchtigen, da nur die Server in einem Rack betroffen sind. Trotz des Namens des Schemas können Sie einen Switch in der Mitte oder am Boden jedes Racks montieren. Das Ende der Zeile (EoR) Netzwerkverbindungsschema liegt vor, wenn ein Serverrack am Ende der Reihe Netzwerkgeräte enthält. Zu diesen Geräten gehört ein gemeinsamer Netzwerk-Switch, der alle Server und anderen Geräte aller Serverracks in der Reihe miteinander verbindet. Die Kabel der im EoR-Serverrack installierten Netzwerkgeräte werden über Patchfelder, die in jedem Rack montiert sind, mit den Geräten in allen Racks der Reihe verbunden. Dadurch werden lange Kabel verwendet, um alle Netzwerkgeräte in einer Reihe miteinander zu verbinden. Wenn redundante Netzwerkverbindungen verwendet werden, erhöht sich auch die Anzahl der Kabel. Dicke Kabelbündel können den Luftzugang zu den Geräten blockieren.Server-Racks befinden sich in einem Rechenzentrum in der Regel in nebeneinander angeordneten Reihen. Eine Reihe kann beispielsweise 10 oder 12 Racks enthalten. Bei Verwendung des EoR-Verbindungsschemas für das MSP-Netzwerk in einem Rechenzentrum wird die gesamte Reihe als eine einzige Verwaltungseinheit betrachtet. In diesem Fall wird das Verwaltungsmodell pro Reihe verwendet. Im EoR-Netzwerkverbindungsmodell sind weniger einzelne Switches erforderlich. Die Flexibilität ist geringer, wenn Sie Wartungsarbeiten durchführen oder Switches aufrüsten müssen, da mehr Geräte betroffen sind, wenn ein EoR-Switch getrennt wird. Trotz seines Namens kann ein Rack mit einem gemeinsamen Switch (Switches) in der Mitte der Reihe platziert werden.

Das Ende der Zeile (EoR) Netzwerkverbindungsschema liegt vor, wenn ein Serverrack am Ende der Reihe Netzwerkgeräte enthält. Zu diesen Geräten gehört ein gemeinsamer Netzwerk-Switch, der alle Server und anderen Geräte aller Serverracks in der Reihe miteinander verbindet. Die Kabel der im EoR-Serverrack installierten Netzwerkgeräte werden über Patchfelder, die in jedem Rack montiert sind, mit den Geräten in allen Racks der Reihe verbunden. Dadurch werden lange Kabel verwendet, um alle Netzwerkgeräte in einer Reihe miteinander zu verbinden. Wenn redundante Netzwerkverbindungen verwendet werden, erhöht sich auch die Anzahl der Kabel. Dicke Kabelbündel können den Luftzugang zu den Geräten blockieren.Server-Racks befinden sich in einem Rechenzentrum in der Regel in nebeneinander angeordneten Reihen. Eine Reihe kann beispielsweise 10 oder 12 Racks enthalten. Bei Verwendung des EoR-Verbindungsschemas für das MSP-Netzwerk in einem Rechenzentrum wird die gesamte Reihe als eine einzige Verwaltungseinheit betrachtet. In diesem Fall wird das Verwaltungsmodell pro Reihe verwendet. Im EoR-Netzwerkverbindungsmodell sind weniger einzelne Switches erforderlich. Die Flexibilität ist geringer, wenn Sie Wartungsarbeiten durchführen oder Switches aufrüsten müssen, da mehr Geräte betroffen sind, wenn ein EoR-Switch getrennt wird. Trotz seines Namens kann ein Rack mit einem gemeinsamen Switch (Switches) in der Mitte der Reihe platziert werden.

Verbindung zwischen Schicht 2 und Schicht 3 verbinden

Die Entscheidung über die Verbindungen innerhalb eines Netzwerks ist eine Abwägung zwischen Zuverlässigkeit, Geschwindigkeit und Kosten sowie der zu schaffenden Topologie.Beispielsweise gibt es Netzwerksegmente für die dreistufige Access-Aggregation-Core-Netzwerktopologie und die Leaf-Spine-Topologie. Dort wird der Datenverkehr auf den Ebenen L2 und L3 des OSI-Modells übertragen. In dem hierarchischen dreistufigen Netzwerk arbeitet die Zugriffsebene auf L2, die Verteilungs-/Aggregationsebene aggregiert L2-Verbindungen und bietet L3-Routing, während die Kernnetzwerkebene das Routing auf der dritten Ebene des OSI-Modells durchführt. Das Netzwerk der mehrstufigen Leaf-Spine-Topologie kann von L2 mit VLANs und L3 mit IP-Routing und Subnetzen konfiguriert werden.L2-Netzwerkgeräte sind kostengünstiger als L3-Netzwerkgeräte, aber es gibt einige Nachteile, wenn L2-Netzwerke verwendet werden, um Geräte im MSP-Netzwerk eines Rechenzentrums zu verbinden. VLAN wird in der Regel verwendet, um Netzwerke, die dieselbe physische Umgebung nutzen, logisch voneinander zu isolieren. Die maximale Anzahl von VLANs beträgt 4095 (abzüglich einiger reservierter VLANs wie 0, 4095, 1002-1005).Ein weiterer Nachteil ist, wie bereits erwähnt, die Unmöglichkeit, redundante Verbindungen zu verwenden, wenn STP auf L2 eingesetzt wird. Dies liegt daran, dass nur eine Verbindung gleichzeitig aktiv sein kann und nicht die gesamte verfügbare Bandbreite aller Verbindungen genutzt wird. Wenn dann die L2-Domain mit STP groß wird, steigt die Wahrscheinlichkeit von Problemen aufgrund unsachgemäßer Verkabelung und menschlicher Fehler, und die Fehlerbehebung wird schwierig.Eine L3-Netzwerkkonfiguration ermöglicht es Ingenieuren, die Stabilität und Skalierbarkeit des MSP-Netzwerks und von Rechenzentrumsnetzwerken im Allgemeinen zu verbessern.Die folgenden Netzwerkprotokolle helfen Ihnen beim Management des L3-Netzwerks und bei der Weiterleitung des Datenverkehrs.BGP (Border Gateway Protocol) ist ein Protokoll für dynamisches Routing, das weit verbreitet ist und in vielen Unternehmen mit großen Rechenzentren als Standard gilt. BGP ist ein hoch skalierbares, erweiterbares und effizientes Protokoll.ECMP (Equal Cost Multipath Routing) ist eine Netzwerk-Routing-Technologie, die zur Verteilung des Datenverkehrs mithilfe mehrerer optimaler Pfade verwendet wird, die durch Metriken auf der dritten Schicht des OSI-Modells definiert sind. ECMP mit Routing-Protokollen wird für den Lastausgleich in großen Netzwerken verwendet. Die meisten Routing-Protokolle, darunter BGP, EIGRP, IS-IS und OSPF, unterstützen die ECMP-Technologie.Versuchen Sie Immer, die fortschrittlicheren Netzwerkprotokolle zu verwenden. Denken Sie jedoch daran, dass die Verwaltung der Netzwerke umso einfacher ist, je weniger Protokolle im Netzwerk verwendet werden.

Netzwerktopologie für NV und SDN

Zusätzlich zur Virtuellen Hardware-Virtualisierung und der Verwendung von Virtuelle Maschinen, Netzwerkvirtualisierung mit einem anwendungsorientierten Ansatz hat ebenfalls an Beliebtheit gewonnen. Netzwerkvirtualisierungslösungen (NV) wie VMware NSX, OpenStack Networking und Cisco ASI nutzen intensiv den Ost-West-Verkehr im physischen Netzwerk, weshalb sich eine Leaf-Spine-Netzwerktopologie für Netzwerkvirtualisierungslösungen eignet. Lesen Sie den Blogbeitrag über VMware NSX Um mehr über Netzwerkvirtualisierung zu erfahren.Software-Defined Networking (SDN) wird verwendet, um Netzwerke zu virtualisieren und so eine effektive Ressourcennutzung, Flexibilität und zentralisierte Verwaltung zu erreichen. Dies ist eine optimale Lösung in einem virtualisierten Rechenzentrum, in dem mit dem Netzwerk verbundene Virtuelle Maschinen verwendet werden. Virtuelle Maschinen können migrieren zwischen Servern, wodurch Ost-West-Verkehr innerhalb des Rechenzentrums entsteht. SDN wird häufig für MSP-Netzwerke von MSPs verwendet, die IaaS (Infrastructure as a Service) anbieten.Die Konfiguration softwaredefinierter Netzwerke ist effektiv, wenn die zugrunde liegende Leaf-Spine-Netzwerktopologie mit dynamischem Routing, einer festen Anzahl von Hops, geringer vorhersehbarer Latenz und Ost-West-Verkehrsoptimierung für die Server-zu-Server-Kommunikation in einem Rechenzentrum verwendet wird.

VXLAN

VXLAN (Virtual eXtensible Local Area Network) ist ein verbessertes Netzwerkprotokoll, das anstelle von VLAN in Overlay-Netzwerken verwendet wird. L2-Tunnel werden von den zugrunde liegenden L3-Netzwerken (L3-Netzwerk-Underlay) erstellt, um L2-Netzwerkkonnektivität ohne die herkömmlichen VLAN-Einschränkungen bereitzustellen. Mit VXLAN können Sie das L2-Netzwerk über das L3-Netzwerk konfigurieren. Die virtuelle Topologie kann sich von der physischen Netzwerktopologie des zugrunde liegenden Netzwerks unterscheiden.VXLAN-Frames werden von dem MAC-in-UDP-Kapselungsschema in IP-Pakete gekapselt. VNI entspricht der VLAN-ID. Die maximale Anzahl von VNI beträgt 2^24, also etwa 16 Millionen. VXLAN wird verwendet, um L2-Netzwerke in geografisch weitläufigen Umgebungen zu erstellen, beispielsweise wenn Sie ein Netzwerk über zwei geografisch verteilte Rechenzentren hinweg erstellen müssen.Die Verwendung von VXLAN und Netzwerkvirtualisierung hilft bei der Optimierung der Größe der MAC-Adressentabelle für ToR-Switches. Dies liegt daran, dass die von VMs verwendeten MAC-Adressen und der zugehörige L2-Datenverkehr mithilfe von VXLAN über ein L2-Overlay-Netzwerk übertragen werden. Sie überlasten die MAC-Tabellen der physischen Switches nicht. Die MAC-Adressentabellen der physischen Switches überschreiten nicht die maximal verfügbare Tabellenkapazität der Switches.

Schlussfolgerung

Traditionell wurden Netzwerke in Rechenzentren unter Verwendung der klassischen dreistufigen Topologie „Zugang-Aggregation-Kern“ aufgebaut. Angesichts der sich weiterentwickelnden modernen Client-Server- und verteilten Anwendungen, Microservices und anderer Software, die Quellen für Ost-West-Datenverkehr innerhalb von MSP-Netzwerken sind, wird die Leaf-Spine-Netzwerktopologie, die auf dem Clos-Netzwerkkonzept basiert, in modernen Rechenzentren bevorzugt und ist eine der gängigsten Netzwerktopologien. Die Leaf-Spine-Netzwerktopologie ist die beste Netzwerktopologie für große Rechenzentren, da diese Topologie äußerst zuverlässig und skalierbar ist. Bevor Sie ein Netzwerk in einem Rechenzentrum installieren, sollten Sie Berechnungen anstellen und den generierten Datenverkehr und die Workloads schätzen. Berücksichtigen Sie dabei den Dienstdatenverkehr wie Datenverkehr zum Backup und zur Replikation im Netzwerk.NAKIVO Backup & Replication ist eine leistungsstarke Backup-Software für virtuelle Maschinen, die VMware Cloud Director-Workloads, VMware-VMs, Hyper-V-VMs sowie physische Linux- und Windows-Maschinen und Oracle-Datenbanken schützen kann. Managed Service Provider, die Infrastructure as a Service (IaaS), Backup as a Service (BaaS) und Disaster Recovery as a Service (DRaaS) anbieten, können NAKIVO Backup & Replication im Multi-Mandanten-Modus installiert. Laden Sie die kostenlose Testversion herunter. NAKIVO Backup & Replication für MSPs die den Multi-Tenancy-Installationsmodus unterstützt.