Topologia di rete MSP per principianti

Per gli MSP (Managed Service Provider), la creazione di una rete altamente performante e scalabile è fondamentale per il successo. In un precedente post sul blogAbbiamo trattato i tipi di topologia di rete di base e in questo post esamineremo tipi di topologia di rete più complessi per i fornitori di servizi, compresi quelli preferiti per le reti MSP. Leggi questo post sul blog per scoprire quale topologia è la migliore per un data center MSP e perché.

Reti gerarchiche tradizionali a 3 livelli

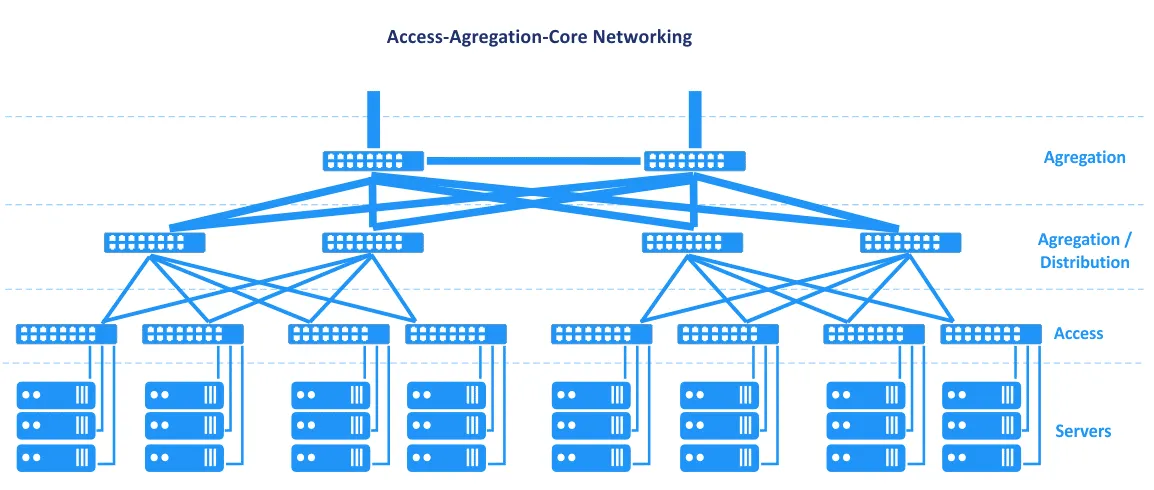

Prima che le reti definite dal software diventassero comuni, le reti nei data center erano basate sulla topologia di rete ad albero gerarchica. Questa topologia si suddivide in tre livelli principali: il livello centrale, il livello di aggregazione o distribuzione e il livello di accesso. In questa topologia, i server sono collegati agli switch nel livello di accesso. I router periferici sono collegati al nucleo per fornire l’accesso da/verso la WAN (wide area network) e Internet. Questi router hanno un’ubicazione tra il nucleo e Internet nello schema riportato di seguito. In termini di modello OSI (Open Systems Interconnection), che divide la rete in un livello di collegamento dati (L2) e un livello di rete (L3), tra gli altri, la topologia di rete Access-Aggregation-Core si estende su più livelli, come mostrato nel grafico.Esaminiamo questi tre livelli uno alla volta.

In termini di modello OSI (Open Systems Interconnection), che divide la rete in un livello di collegamento dati (L2) e un livello di rete (L3), tra gli altri, la topologia di rete Access-Aggregation-Core si estende su più livelli, come mostrato nel grafico.Esaminiamo questi tre livelli uno alla volta.

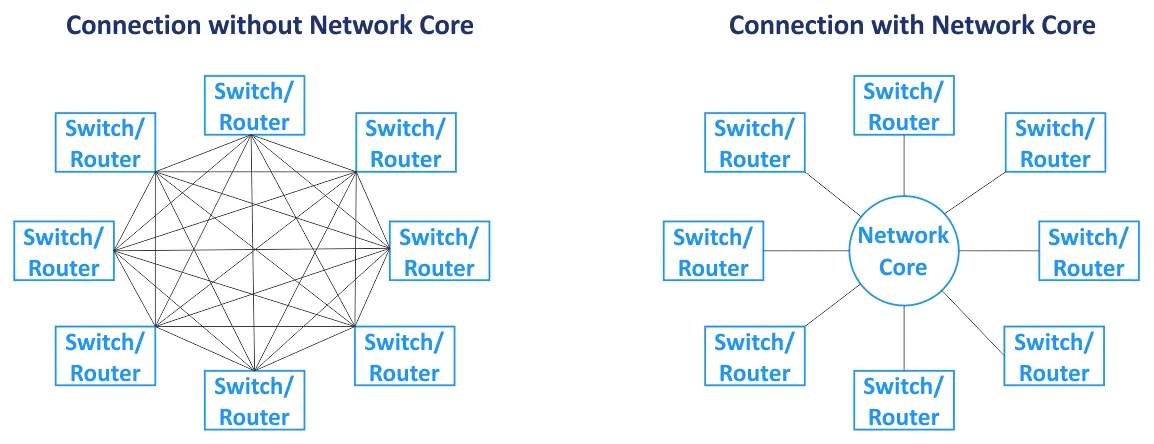

Strato centrale

Il nucleo della rete (chiamato anche rete centrale) è il componente centrale dell’intera rete. I nodi primari sono collegati al nucleo. La rete centrale si basa solitamente sulla topologia di rete mesh, in cui tutti i nodi sono collegati a tutti gli altri nodi all’interno del nucleo (per un tipo di topologia di rete full-mesh). Gli switch e i router nel nucleo della rete sono interconnessi con collegamenti ad alta velocità (chiamati anche connessioni backbone). Poiché nel nucleo della rete vengono utilizzati router, il livello centrale opera con traffico L3.

Livello di distribuzione/aggregazione

Si tratta di un livello intermedio utilizzato per aggregare gli uplink dal livello sottostante della topologia di rete a tre livelli (il livello di accesso, che opera su L2) al livello centrale della rete (che di solito opera su L3) utilizzando collegamenti a larghezza di banda superiore. Il livello di distribuzione combina un numero elevato di porte a bassa velocità con un numero ridotto di porte trunk ad alta velocità. Il routing inizia sul livello di distribuzione/aggregazione di questa topologia di rete quando i dati vengono trasferiti dal livello di accesso. Il firewall, il bilanciamento del carico e altre configurazioni di sicurezza sono impostati sul livello di aggregazione. Il livello di aggregazione/distribuzione viene utilizzato per ridurre e semplificare lo schema di cablaggio nel data center per una gestione più comoda. Gli switch installati sul livello di aggregazione devono supportare la memorizzazione di un numero maggiore di indirizzi MAC nella tabella degli indirizzi MAC nella loro memoria. Mentre il livello di accesso opera con il traffico L2, il livello di distribuzione opera con il traffico L2 e L3.

Livello di accesso

Questo livello è costituito da switch che operano su L2. I server e le stazioni di lavoro sono collegati agli switch del livello di accesso. Le VLAN (Virtual Local Area Network) vengono solitamente utilizzate per separare i domini di broadcast L2 al fine di ridurre il traffico di broadcast e aumentare la sicurezza.Per evitare colli di bottiglia, vengono utilizzati collegamenti più spessi più vicini al core della rete. Ad esempio, i server sono collegati agli switch di accesso tramite interfacce di rete da 10 Gbit/s, gli switch di accesso sono collegati agli switch di aggregazione tramite interfacce da 10 Gbit/s e gli switch/router del livello di aggregazione sono collegati agli switch/router del nucleo della rete tramite collegamenti da 100 Gbit/s. In questo caso, è possibile utilizzare l’aggregazione dei collegamenti per aumentare la larghezza di banda e la ridondanza. Tutto il traffico proveniente dai server viene trasferito agli uplink. Esiste una serie di apparecchiature di rete intelligenti, soprannominate “god box”, con un’ubicazione al vertice della gerarchia di questa topologia di rete. Le god box sono responsabili del routing e di tutti gli altri servizi. La topologia di rete gerarchica consente di creare una rete modulare.Nella topologia di rete illustrata nel diagramma precedente, il guasto di un collegamento comporta il guasto di quel segmento della rete. Per questo motivo, per questo tipo di topologia di rete (vedere lo schema seguente) vengono utilizzati canali riservati e ridondanza su ogni livello di rete. Il guasto di un dispositivo o di un collegamento causa un calo delle prestazioni, ma la rete continua a funzionare. Questa topologia di rete ridondante richiede solitamente l’STP (Spanning Tree Protocol). Manutenzione. Se si scollega parte dell’apparecchiatura di rete su questo tipo di topologia di rete a tre livelli per aggiornare il software o eseguire altre attività di manutenzione, le prestazioni della rete risultano compromesse. Alcuni servizi potrebbero essere temporaneamente non disponibili.Scalabilità. Il numero di servizi in esecuzione sui server cresce ogni anno e il volume di traffico aumenta di conseguenza. Questa situazione richiede l’upgrade e l’aumento della larghezza di banda nella rete MSP. L’aumento della larghezza di banda in un data center classico richiedeva solitamente quanto segue:

Manutenzione. Se si scollega parte dell’apparecchiatura di rete su questo tipo di topologia di rete a tre livelli per aggiornare il software o eseguire altre attività di manutenzione, le prestazioni della rete risultano compromesse. Alcuni servizi potrebbero essere temporaneamente non disponibili.Scalabilità. Il numero di servizi in esecuzione sui server cresce ogni anno e il volume di traffico aumenta di conseguenza. Questa situazione richiede l’upgrade e l’aumento della larghezza di banda nella rete MSP. L’aumento della larghezza di banda in un data center classico richiedeva solitamente quanto segue:

- Aumento delle connessioni LAG (Link Aggregation Group)

- Acquisto di schede di rete

- Se non ci sono slot disponibili per l’installazione di schede di rete, l’acquisto di nuovi server o apparecchiature correlate

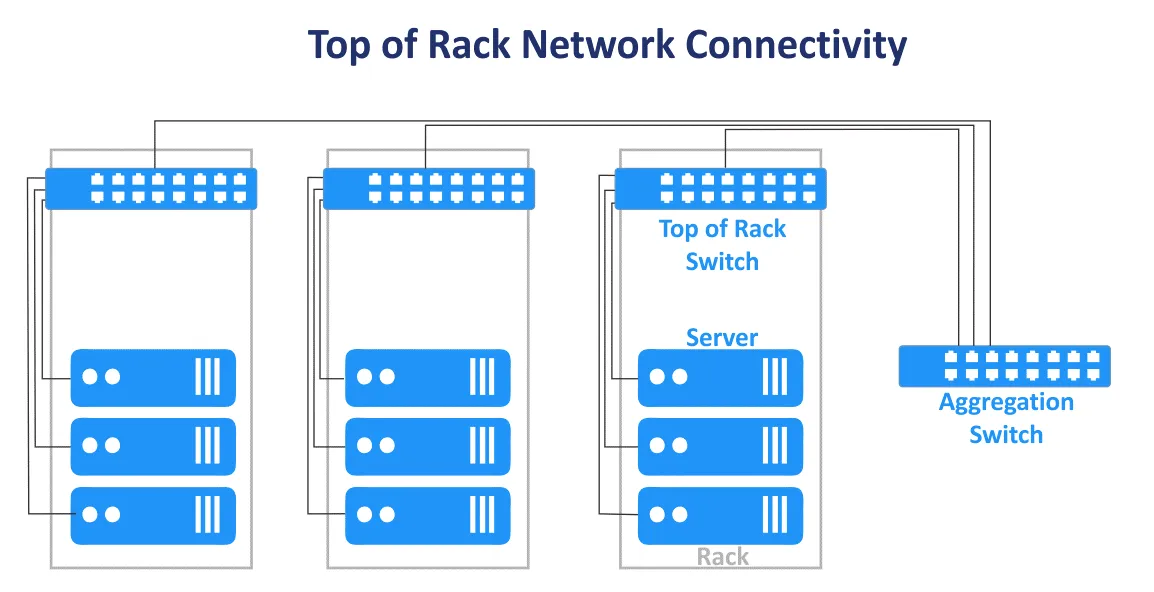

Se è necessario aggiungere un nuovo rack server (cabina rack) come nuovo modulo nel data center, è possibile aumentare la larghezza di banda della rete per questo rack e per i server installati al suo interno. Questo tipo di topologie di rete non è in grado di garantire un elevato livello di prenotazione e ridondanza dei collegamenti a causa delle funzioni del protocollo L2, quali STP e MSTP (Multiple Spanning Tree Protocol).La classica topologia di rete a tre livelli in un data center può essere combinata con i design End of Row e Top of Rack. Lo schema di connessione Top of Rack è ora più popolare. Questo nome viene utilizzato perché i server e gli switch sono collegati allo switch principale su ogni rack. Gli switch Top of Rack (switch ToR) sono collegati agli switch/router dei livelli superiori nella rete MSP. Gli switch ToR sono diversi dagli switch edge utente e dispongono di più porte uplink ad alta velocità (come le porte da 10 Gbit/s) e di un numero elevato di porte per collegare i server. Gli switch ToR sono installati in coppia per garantire la ridondanza e consentire la manutenzione degli switch. I vantaggi di questo schema di connessione ToR sono la minore lunghezza dei cavi quando si cablano i dispositivi in un rack e tra i rack. Gli switch di accesso della topologia di rete gerarchica multilivello sono solitamente utilizzati come switch ToR.

Direzione del traffico

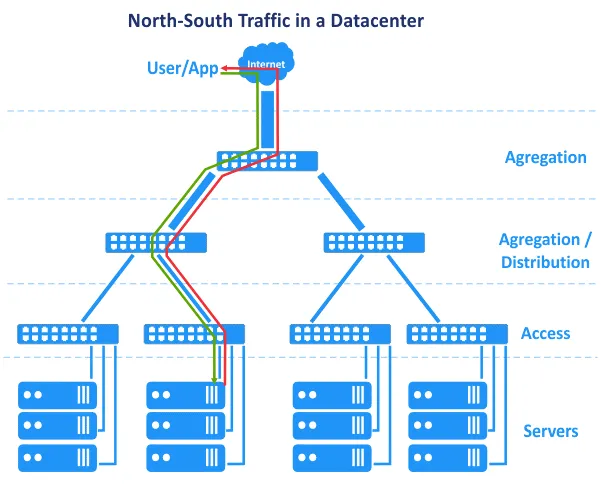

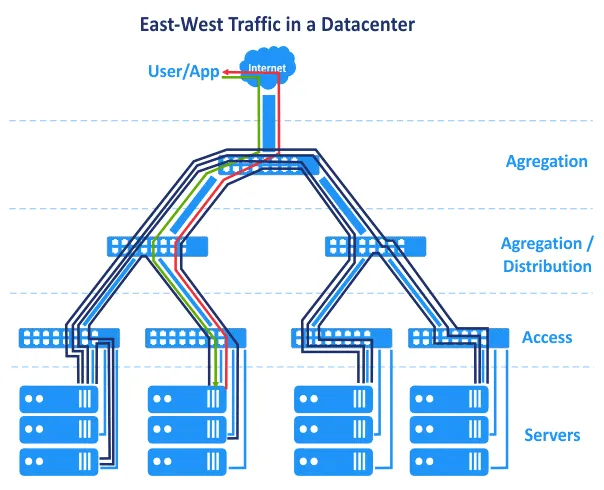

Gli svantaggi precedentemente illustrati non sono troppo critici e una rete di data center può funzionare correttamente con un’adeguata amministrazione. Il passaggio da L2 a L3 in una parte della rete contribuisce a risolvere una serie di problemi. Esiste un’altra funzione legata all’evoluzione dei data center e al modo in cui le applicazioni funzionano oggi in modo diverso rispetto al passato. Negli anni 2000, le applicazioni venivano create utilizzando un’architettura centralizzata e le applicazioni dell’architettura client-server erano principalmente monoliticoCiò significa che i componenti di un’applicazione potrebbero avere la loro ubicazione su un unico server. Di conseguenza, nel nostro diagramma, la richiesta dell’utente è stata inviata dalla parte superiore della rete e la richiesta generata dall’applicazione è stata inviata dal livello inferiore del server alla parte superiore della rete. La richiesta dell’utente è stata gestita su un unico host. Il traffico orizzontale (est-ovest) tra gli host era minimo, mentre il traffico nord-sud era preferibile. La topologia di rete tradizionale gerarchica a più livelli utilizzata per le reti MSP nei data center soddisfa questi requisiti. Tuttavia, nel corso del tempo, sono state preferite nuove architetture per lo sviluppo delle applicazioni. Architettura a livelli N-tier. I componenti dell’applicazione sono distribuiti su più livelli, ad esempio il livello logico, il livello di presentazione e il livello dati. Le applicazioni web che hanno più componenti richiedono che questi componenti vengano eseguiti su server diversi, ad esempio un server web, un server applicazioni e server di database. I componenti dell’applicazione in esecuzione su più server interagiscono tra loro tramite una rete.Architettura microservizi presuppone che i componenti di un’applicazione (servizi) siano eseguiti in contenitori separati e logicamente isolati, collegati tra loro tramite una rete. Contenitori può essere eseguito su diversi host in cluster. Questa architettura è altamente scalabile ed è oggi ampiamente utilizzata nei cloud.Inoltre, i data center ora operano con Big Data, grandi database, analisi, pubblicità contestuale, applicazioni basate sull’intelligenza artificiale e altri software che richiedono l’interconnessione con più server, array di storage, VM o contenitori. I componenti delle applicazioni sono distribuiti su più server o VM nel data center.Di conseguenza, il traffico est-ovest è superiore al traffico nord-sud nella rete MSP. Il traffico interno in una rete di data center (traffico intra-DC) è superiore al traffico da/verso un utente esterno che invia una richiesta al data center. Non dimenticare il traffico interno tra i sistemi di storage, replica del database, backup dei dati e altre attività di servizio che utilizzano la rete in un data center.

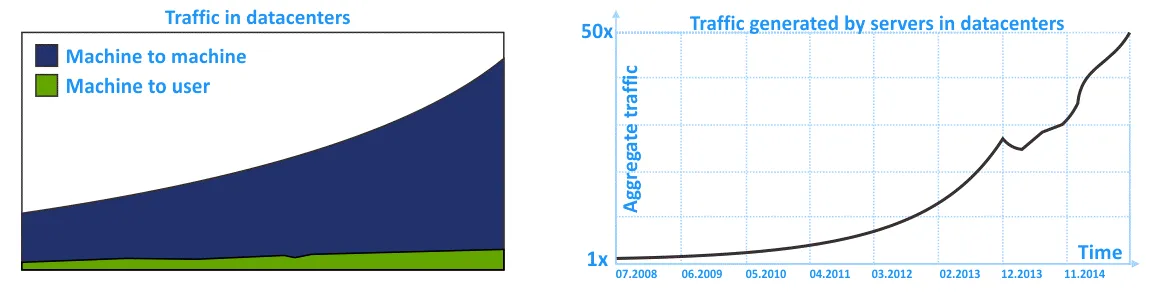

Architettura a livelli N-tier. I componenti dell’applicazione sono distribuiti su più livelli, ad esempio il livello logico, il livello di presentazione e il livello dati. Le applicazioni web che hanno più componenti richiedono che questi componenti vengano eseguiti su server diversi, ad esempio un server web, un server applicazioni e server di database. I componenti dell’applicazione in esecuzione su più server interagiscono tra loro tramite una rete.Architettura microservizi presuppone che i componenti di un’applicazione (servizi) siano eseguiti in contenitori separati e logicamente isolati, collegati tra loro tramite una rete. Contenitori può essere eseguito su diversi host in cluster. Questa architettura è altamente scalabile ed è oggi ampiamente utilizzata nei cloud.Inoltre, i data center ora operano con Big Data, grandi database, analisi, pubblicità contestuale, applicazioni basate sull’intelligenza artificiale e altri software che richiedono l’interconnessione con più server, array di storage, VM o contenitori. I componenti delle applicazioni sono distribuiti su più server o VM nel data center.Di conseguenza, il traffico est-ovest è superiore al traffico nord-sud nella rete MSP. Il traffico interno in una rete di data center (traffico intra-DC) è superiore al traffico da/verso un utente esterno che invia una richiesta al data center. Non dimenticare il traffico interno tra i sistemi di storage, replica del database, backup dei dati e altre attività di servizio che utilizzano la rete in un data center. Nei diagrammi seguenti è possibile vedere la rappresentazione grafica dell’aumento del traffico interno nelle reti MSP all’interno dei data center negli ultimi anni. La tendenza mostra che il traffico intra-DC sta crescendo più del traffico in entrata/uscita.

Nei diagrammi seguenti è possibile vedere la rappresentazione grafica dell’aumento del traffico interno nelle reti MSP all’interno dei data center negli ultimi anni. La tendenza mostra che il traffico intra-DC sta crescendo più del traffico in entrata/uscita. Le reti tradizionali, costruite utilizzando la tradizionale topologia di rete gerarchica a tre livelli, sono affidabili ma non adatte a gestire i flussi di traffico laterali nel modo più razionale. Ciò è dovuto all’enfasi posta sul networking L2 e sul traffico nord-sud.

Le reti tradizionali, costruite utilizzando la tradizionale topologia di rete gerarchica a tre livelli, sono affidabili ma non adatte a gestire i flussi di traffico laterali nel modo più razionale. Ciò è dovuto all’enfasi posta sul networking L2 e sul traffico nord-sud.

Topologia di rete Clos

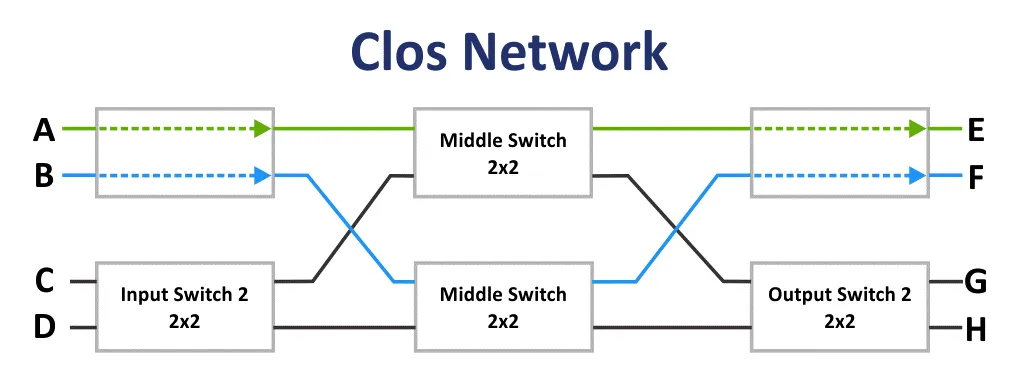

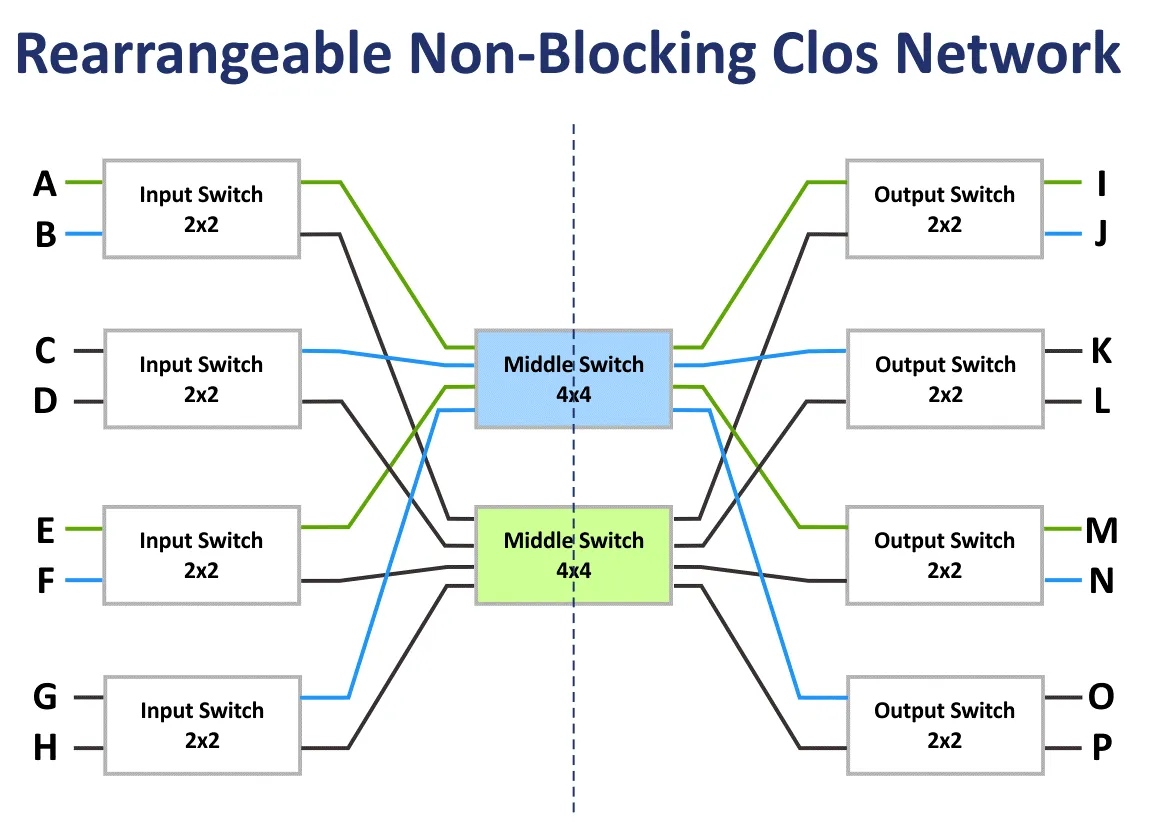

Inizialmente, la rete Clos fu inventata da Edson Erwin nel 1938. Nel 1953, Charles Clos decise di utilizzare reti di commutazione non bloccanti nei sistemi telefonici per un uso più razionale delle comunicazioni rispetto allo schema di comunicazione crossbar. Con array con un numero ridotto di interconnessioni, ingressi e uscite, lo schema di connessione sembra a prima vista difficile. Tuttavia, la rete Clos è meno complessa grazie al numero inferiore di punti di connessione secondo la formula: 6n^(3/2)-3nQuesto fatto diventa evidente a partire da 36 endpoint di connessione. Se m è il numero di interruttori di ingresso e n è il numero di switch di uscita, quindi le caratteristiche di blocco della rete Clos vengono calcolate utilizzando la formula. Secondo il teorema di Clos, una rete Clos è rigorosamente non bloccante se il numero di switch di secondo livello m ≥ 2n−1.La rete di blocco è una rete in cui è impossibile trovare un percorso di comunicazione da una porta di ingresso libera a una porta di uscita libera.La rete non bloccante è la rete in cui esiste sempre un percorso per collegare qualsiasi porta di ingresso e di uscita. Le reti non bloccanti vengono create aggiungendo un ulteriore stadio di commutazione.La rete non bloccante riorganizzabile è la rete in cui tutti i percorsi possibili per collegare tutte le porte di ingresso e di uscita possono essere riorganizzati.

Se m è il numero di interruttori di ingresso e n è il numero di switch di uscita, quindi le caratteristiche di blocco della rete Clos vengono calcolate utilizzando la formula. Secondo il teorema di Clos, una rete Clos è rigorosamente non bloccante se il numero di switch di secondo livello m ≥ 2n−1.La rete di blocco è una rete in cui è impossibile trovare un percorso di comunicazione da una porta di ingresso libera a una porta di uscita libera.La rete non bloccante è la rete in cui esiste sempre un percorso per collegare qualsiasi porta di ingresso e di uscita. Le reti non bloccanti vengono create aggiungendo un ulteriore stadio di commutazione.La rete non bloccante riorganizzabile è la rete in cui tutti i percorsi possibili per collegare tutte le porte di ingresso e di uscita possono essere riorganizzati. Alla fine degli anni ’90, con l’evoluzione delle tecnologie di telecomunicazione e delle reti informatiche, il concetto di reti Clos è tornato ad essere rilevante. È necessario che tutti i nodi comunichino tra loro nella struttura di rete e, se possibile, che non venga utilizzata la topologia a maglia completa quando tutti i dispositivi sono interconnessi. È stato aggiunto un nuovo livello di comunicazione per l’interconnessione dei dispositivi di rete. Di conseguenza, il concetto di rete Clos è stato ripreso in una nuova incarnazione. Nell’immagine seguente è possibile vedere uno schema tipico della rete Clos a tre livelli.

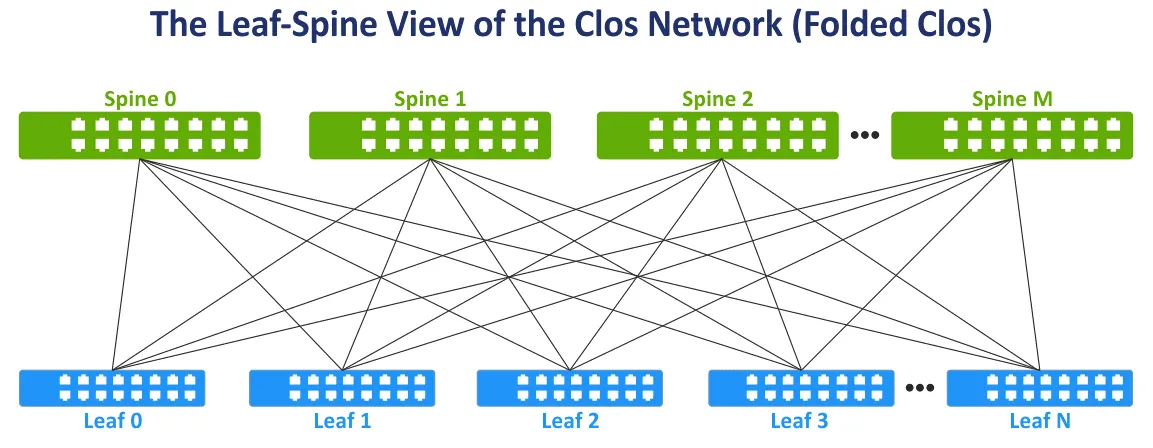

Alla fine degli anni ’90, con l’evoluzione delle tecnologie di telecomunicazione e delle reti informatiche, il concetto di reti Clos è tornato ad essere rilevante. È necessario che tutti i nodi comunichino tra loro nella struttura di rete e, se possibile, che non venga utilizzata la topologia a maglia completa quando tutti i dispositivi sono interconnessi. È stato aggiunto un nuovo livello di comunicazione per l’interconnessione dei dispositivi di rete. Di conseguenza, il concetto di rete Clos è stato ripreso in una nuova incarnazione. Nell’immagine seguente è possibile vedere uno schema tipico della rete Clos a tre livelli. Modifichiamo la vista della rete Clos nella vista Leaf-Spine, ampiamente utilizzata per maggiore praticità, ripiegando i lati sinistro e destro dello schema. Questa topologia di rete è nota come Leaf-Spine, Folded Clos e rete Clos a 3 stadi (vedere l’immagine seguente).Lo strato della colonna vertebrale. Gli switch spine vengono utilizzati per interconnettere tutti gli switch leaf nella topologia di rete full mesh. Il livello spine sostituisce, in una certa misura, il livello di aggregazione utilizzato nella tradizionale topologia di rete gerarchica a tre livelli. Tuttavia, il livello spine non è direttamente equivalente al livello di aggregazione. Il compito principale del livello spine è il trasferimento veloce dei dati da un leaf all’altro. I dispositivi endpoint non sono collegati agli switch spine.Lo strato fogliare. In questo modello, i server o altri dispositivi endpoint nel data center sono collegati ai leaf. Tutti i leaf sono collegati a tutti gli spine. Di conseguenza, vi è un numero elevato di connessioni di rete con larghezza di banda uguale tra tutti i server. Esistono connessioni L3 tra spine e foglie (L3 nel modello OSI).Quando il traffico viene trasmesso dall’origine alla destinazione nella rete, il numero di hop è lo stesso (ad esempio, sono necessari tre hop per trasferire i dati tra qualsiasi server all’interno della rete foglia-spina a due livelli nello schema seguente). La latenza è prevedibile e bassa. Anche la capacità della rete è aumentata perché ora non è necessario utilizzare STP. Quando STP viene utilizzato per connessioni ridondanti tra switch, solo un collegamento può essere attivo alla volta.Nella topologia di rete leaf-spine, il protocollo di routing Equal-Cost Multipath (ECMP) può essere utilizzato per bilanciare il carico del traffico e prevenire loop di rete (per connessioni di rete L3). È possibile utilizzare anche i protocolli BGP, OSPF, EIGRP, ISIS.

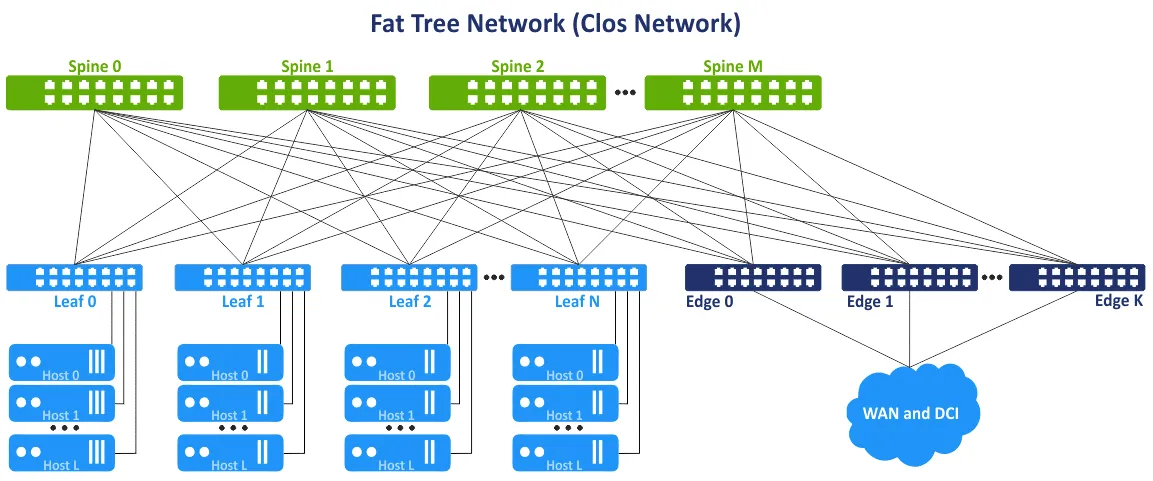

Modifichiamo la vista della rete Clos nella vista Leaf-Spine, ampiamente utilizzata per maggiore praticità, ripiegando i lati sinistro e destro dello schema. Questa topologia di rete è nota come Leaf-Spine, Folded Clos e rete Clos a 3 stadi (vedere l’immagine seguente).Lo strato della colonna vertebrale. Gli switch spine vengono utilizzati per interconnettere tutti gli switch leaf nella topologia di rete full mesh. Il livello spine sostituisce, in una certa misura, il livello di aggregazione utilizzato nella tradizionale topologia di rete gerarchica a tre livelli. Tuttavia, il livello spine non è direttamente equivalente al livello di aggregazione. Il compito principale del livello spine è il trasferimento veloce dei dati da un leaf all’altro. I dispositivi endpoint non sono collegati agli switch spine.Lo strato fogliare. In questo modello, i server o altri dispositivi endpoint nel data center sono collegati ai leaf. Tutti i leaf sono collegati a tutti gli spine. Di conseguenza, vi è un numero elevato di connessioni di rete con larghezza di banda uguale tra tutti i server. Esistono connessioni L3 tra spine e foglie (L3 nel modello OSI).Quando il traffico viene trasmesso dall’origine alla destinazione nella rete, il numero di hop è lo stesso (ad esempio, sono necessari tre hop per trasferire i dati tra qualsiasi server all’interno della rete foglia-spina a due livelli nello schema seguente). La latenza è prevedibile e bassa. Anche la capacità della rete è aumentata perché ora non è necessario utilizzare STP. Quando STP viene utilizzato per connessioni ridondanti tra switch, solo un collegamento può essere attivo alla volta.Nella topologia di rete leaf-spine, il protocollo di routing Equal-Cost Multipath (ECMP) può essere utilizzato per bilanciare il carico del traffico e prevenire loop di rete (per connessioni di rete L3). È possibile utilizzare anche i protocolli BGP, OSPF, EIGRP, ISIS. Questo concetto di rete è noto anche come topologia di rete multi-layer fat-tree. L’idea è quella di evitare colli di bottiglia nei livelli superiori dell’albero (vicini alla radice) e aggiungere collegamenti aggiuntivi per aumentare la larghezza di banda in questi segmenti. Di conseguenza, la capacità di collegamento verso la radice è crescente. Il fat tree è un caso speciale della rete Clos. La rete Clos a tre livelli viene trasformata in una rete leaf-spine a due livelli dopo la piegatura. Gli switch leaf o gli switch/router leaf edge possono essere utilizzati per accedere a reti esterne e altri data center.

Questo concetto di rete è noto anche come topologia di rete multi-layer fat-tree. L’idea è quella di evitare colli di bottiglia nei livelli superiori dell’albero (vicini alla radice) e aggiungere collegamenti aggiuntivi per aumentare la larghezza di banda in questi segmenti. Di conseguenza, la capacità di collegamento verso la radice è crescente. Il fat tree è un caso speciale della rete Clos. La rete Clos a tre livelli viene trasformata in una rete leaf-spine a due livelli dopo la piegatura. Gli switch leaf o gli switch/router leaf edge possono essere utilizzati per accedere a reti esterne e altri data center.

Vantaggi della topologia di rete leaf-spine

La topologia di rete leaf-spine offre una serie di vantaggi rispetto alla topologia di rete access-aggregation-core. Questa serie di vantaggi è il motivo per cui si utilizza il tipo di topologia di rete leaf-spine in un data center.Connessioni ottimizzate. I collegamenti con elevata larghezza di banda tra dispositivi di rete sono ottimali per il traffico est-ovest. Non ci sono collegamenti inutilizzati (poiché viene utilizzato L3 invece di L2). ECMP è consigliato per un’elevata efficienza e STP non è necessario.Affidabilità. Il guasto di un dispositivo o la disconnessione di un collegamento non causano risultati negativi e svantaggi significativi. Se lo switch ToR che funge da switch leaf subisce un guasto, il rack corrispondente ne risente. Se uno switch spine subisce un guasto, la larghezza di banda della rete si riduce, ma non in modo significativo rispetto alla tradizionale topologia di rete gerarchica a 3 livelli. La riduzione della larghezza di banda per la topologia spine-leaf è 1/n, dove n è il numero di spine. Il degrado della larghezza di banda per la topologia gerarchica è 50% in questo caso.Elevata scalabilità. È possibile aggiungere nuove foglie fino a quando non si hanno porte libere sulle spine. L’aggiunta di nuove spine consente di aumentare gli uplink delle foglie. Aggiungere switch/router di bordo per aumentare la larghezza di banda verso le reti esterne. L’approccio tradizionale per aumentare la larghezza di banda e collegare più server per la topologia di rete gerarchica a tre livelli consiste nell’aggiungere più schede di rete con più porte, apparecchiature di rete con interfacce di rete più veloci e hardware più potente in generale. Questo approccio tradizionale è chiamato aumentare oppure scalabilità verticale.Quando si utilizza la topologia di rete leaf-spine nei data center e per le reti MSP, è possibile aggiungere un ulteriore livello di spine. Questo approccio è denominato scalabilità orizzontale oppure scalatoL’aggiunta di un dispositivo di rete tipico, come uno switch/router, aumenta la scalabilità in modo lineare.Manutenzione. È possibile scollegare facilmente gli spine dalla rete per la manutenzione o la sostituzione. Le attività di manutenzione sugli spine non sono rischiose rispetto ai god box perché sugli spine non sono presenti funzionalità di intelligenza artificiale e la riduzione della larghezza di banda dopo la disconnessione è minima.

Rete Clos multilivello

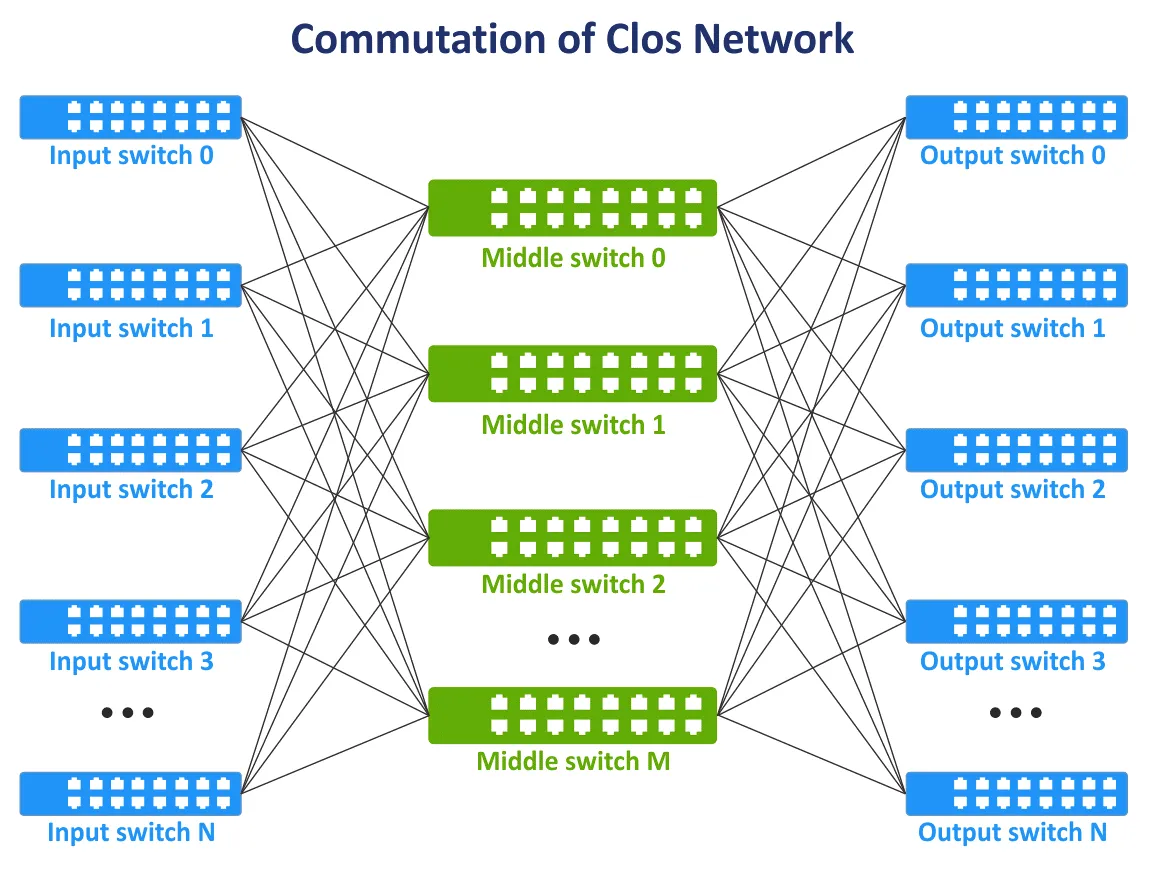

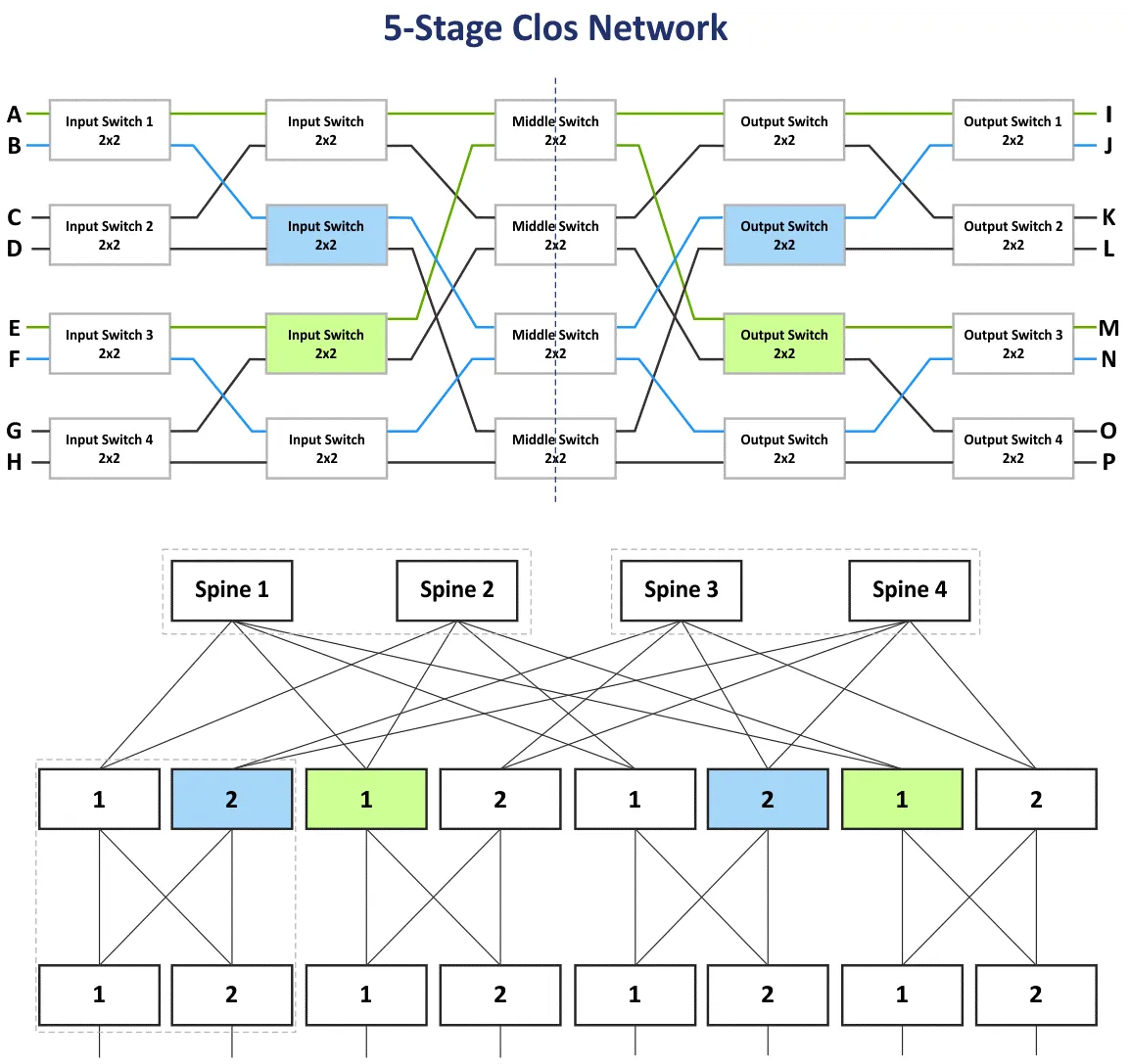

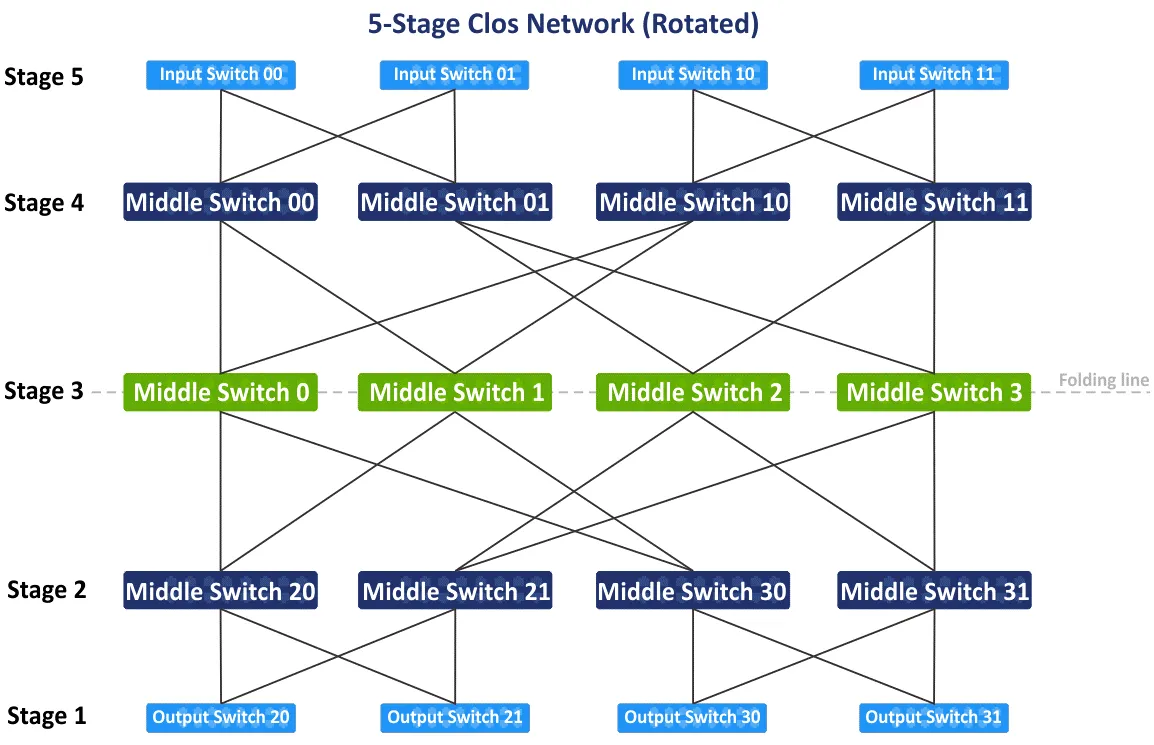

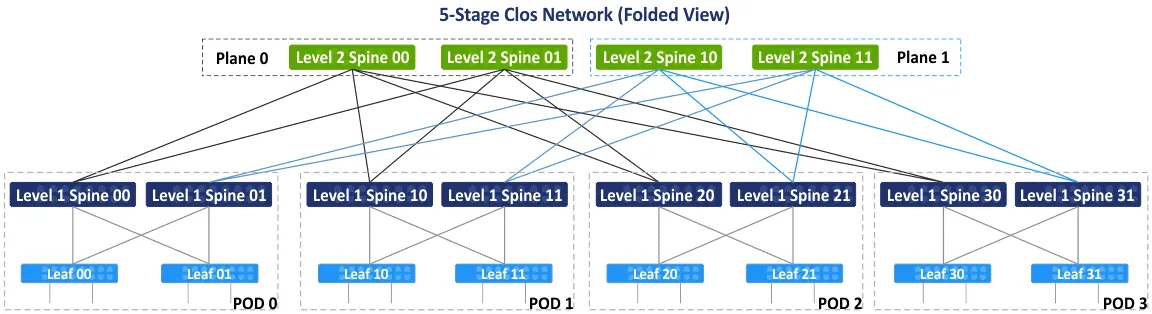

Nella sezione precedente ho spiegato la rete Clos a tre stadi con gli stadi: Switch di ingresso, Switch intermedio e Switch di uscita. Poiché i dispositivi negli stadi di ingresso e di uscita vengono utilizzati per ricevere/inviare dati, lo schema di rete può essere ripiegato utilizzando una linea intermedia costituita da una topologia di rete leaf-spine a due livelli. È possibile aggiungere più fasi e costruire la rete Clos multilivello per collegare più dispositivi di rete a questa rete. In questo caso, si hanno cinque fasi: Input Switch, Middle Switch 1, Middle Switch 2, Middle Switch 3, Output Switch.Nel diagramma seguente è possibile vedere lo schema iniziale della rete Clos non bloccante a cinque fasi dopo la riorganizzazione dei blocchi blu e verdi. Esiste anche la vista foglia-spina piegata o la vista fat-tree (4,3) (poiché nello schema foglia-spina sono presenti 4 switch spina e 3 livelli), ma vediamo come collegare i dispositivi alla rete Clos a 5 livelli passo dopo passo. Una topologia di rete Clos con più di 5 livelli non è comune e non viene utilizzata nella pratica perché il numero di connessioni è troppo elevato. Dopo aver ruotato di 90 gradi in senso orario lo schema iniziale della rete Clos a cinque stadi, si otterrà la vista tradizionale con interruttori di ingresso, interruttori di uscita e tre stadi di interruttori centrali. Tracciamo la linea di piegatura attraverso gli interruttori centrali al centro dello schema per ottenere la vista piegata della rete Clos a cinque stadi.

Dopo aver ruotato di 90 gradi in senso orario lo schema iniziale della rete Clos a cinque stadi, si otterrà la vista tradizionale con interruttori di ingresso, interruttori di uscita e tre stadi di interruttori centrali. Tracciamo la linea di piegatura attraverso gli interruttori centrali al centro dello schema per ottenere la vista piegata della rete Clos a cinque stadi. Dopo aver ripiegato lo schema, si ottiene la vista ripiegata o la vista foglia-spina di questo tipo di topologie di rete (vedere lo schema seguente). Ci sono 4 gruppi individuali che fungono da punti di consegna (POD). Il POD è l’unità universale per la costruzione di data center. I POD sono collegati alle spine del primo livello. Se è necessario estendere il data center o aggiungere altri server/apparecchiature di rete, è sufficiente aggiungere nuovi POD e collegarli al fabric di rete. Le spine di un POD sono collegate alle spine di altri POD tramite spine di secondo livello. Allo stesso tempo, non tutte le spine L1 sono collegate a tutte le spine L2 e sono divise per piani.Ci sono due piani: Piano 0 e Piano 1 nello schema seguente. Questo concetto viene utilizzato a causa del numero limitato di porte sugli spine e in questo caso non è possibile creare una topologia di rete completamente connessa. Nello schema seguente, ogni spine ha un limite di 4 porte. Secondo l’idea principale, la rete Clos non bloccante si basa sugli stessi elementi (switch a 4 porte, come mostrato di seguito).

Dopo aver ripiegato lo schema, si ottiene la vista ripiegata o la vista foglia-spina di questo tipo di topologie di rete (vedere lo schema seguente). Ci sono 4 gruppi individuali che fungono da punti di consegna (POD). Il POD è l’unità universale per la costruzione di data center. I POD sono collegati alle spine del primo livello. Se è necessario estendere il data center o aggiungere altri server/apparecchiature di rete, è sufficiente aggiungere nuovi POD e collegarli al fabric di rete. Le spine di un POD sono collegate alle spine di altri POD tramite spine di secondo livello. Allo stesso tempo, non tutte le spine L1 sono collegate a tutte le spine L2 e sono divise per piani.Ci sono due piani: Piano 0 e Piano 1 nello schema seguente. Questo concetto viene utilizzato a causa del numero limitato di porte sugli spine e in questo caso non è possibile creare una topologia di rete completamente connessa. Nello schema seguente, ogni spine ha un limite di 4 porte. Secondo l’idea principale, la rete Clos non bloccante si basa sugli stessi elementi (switch a 4 porte, come mostrato di seguito). A prima vista, termini come Clos, Clos piegato, leaf-spine e fat tree possono creare confusione. Permettetemi di chiarire questi termini.Chiusura oppure Rete Clos è il termine che copre le basi teoriche del tipo di topologia di rete Clos.Chiusura piegata è una rappresentazione più conveniente della rete Clos, in cui ingressi e uscite hanno lo stesso ruolo e hanno la stessa ubicazione.Spina dorsale fogliare è una topologia di rete basata sullo schema di rete Clos che viene utilizzata nella pratica nei data center per costruire reti, comprese le reti MSP.Albero grasso è solitamente indicato come una variante della rete Clos. Questo termine è piuttosto confuso perché alcuni articoli descrivono il fat tree come la classica rete di accesso-aggregazione-core. Faccio riferimento al documento RFC 7938, secondo cui il fat tree si basa sulla topologia di rete Clos piegata.

A prima vista, termini come Clos, Clos piegato, leaf-spine e fat tree possono creare confusione. Permettetemi di chiarire questi termini.Chiusura oppure Rete Clos è il termine che copre le basi teoriche del tipo di topologia di rete Clos.Chiusura piegata è una rappresentazione più conveniente della rete Clos, in cui ingressi e uscite hanno lo stesso ruolo e hanno la stessa ubicazione.Spina dorsale fogliare è una topologia di rete basata sullo schema di rete Clos che viene utilizzata nella pratica nei data center per costruire reti, comprese le reti MSP.Albero grasso è solitamente indicato come una variante della rete Clos. Questo termine è piuttosto confuso perché alcuni articoli descrivono il fat tree come la classica rete di accesso-aggregazione-core. Faccio riferimento al documento RFC 7938, secondo cui il fat tree si basa sulla topologia di rete Clos piegata.

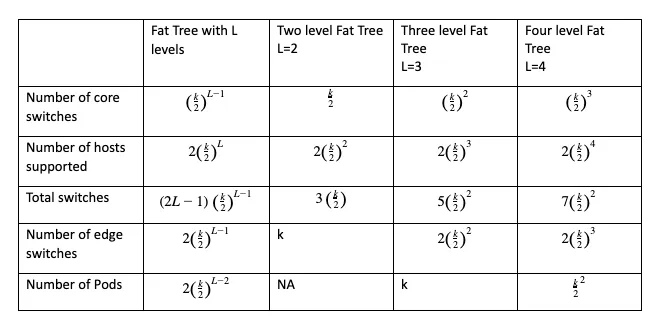

Calcoli

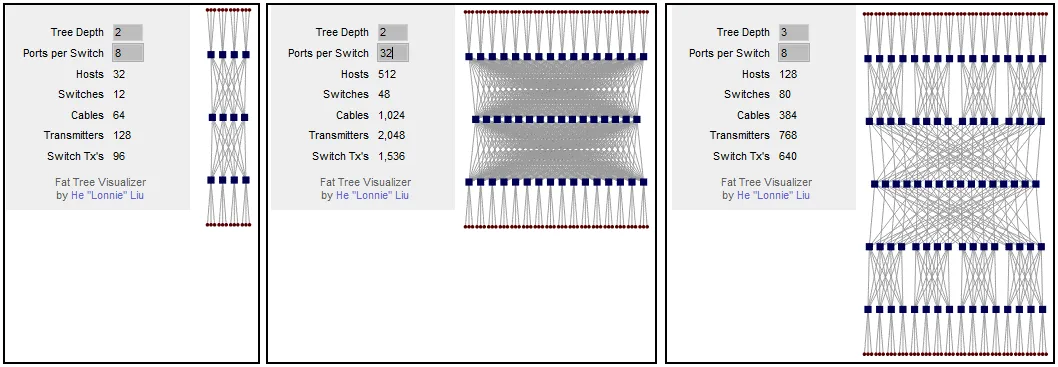

È possibile calcolare il numero di switch core, switch edge, switch totali necessari e il numero totale di host che possono essere collegati alla rete della configurazione selezionata utilizzando le formule in cui:k è il numero di porte dello switchL è il numero di livelli nella topologia di rete leaf-spine (fat tree) Il parametro principale da calcolare prima di costruire la rete è il numero di host supportati. La configurazione fat-tree può essere scritta come FT(k, L). Ad esempio, FT(32,3) è una rete fat-tree a tre livelli con switch a 32 porte. È possibile utilizzare questo calcolatrice gratuita per reti Clos che genera anche lo schema di visualizzazione per la configurazione selezionata.È possibile calcolare che se lo schema di rete fat-tree ha 2 livelli e 8 porte per switch, è possibile collegare 32 host alla rete. Se si aumenta il numero di porte per switch, il numero di host supportati aumenta a 512. Come si può vedere, il numero di host collegati dipende dal numero di porte su ciascuno switch. Se si lascia il fat tree a 2 livelli (la rete Clos a 3 stadi) e si aumenta il numero di porte per switch, il numero di spine aumenta in modo significativo. È possibile risolvere questo problema aggiungendo un altro livello al fat tree. Per un fat tree a tre livelli, se il numero di porte per switch è 8, è possibile collegare 128 host.

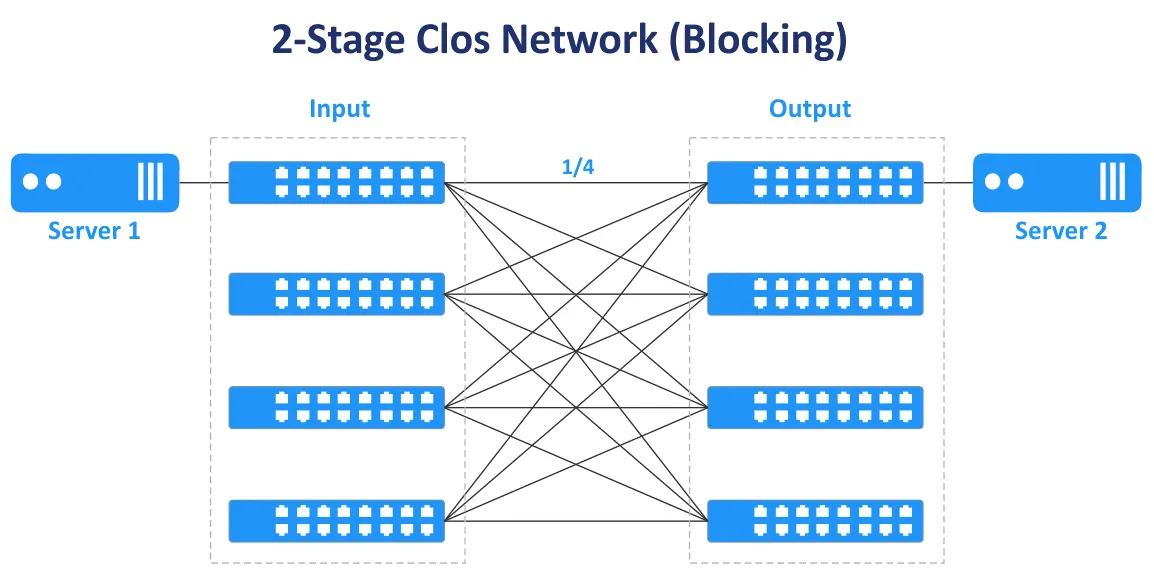

Il parametro principale da calcolare prima di costruire la rete è il numero di host supportati. La configurazione fat-tree può essere scritta come FT(k, L). Ad esempio, FT(32,3) è una rete fat-tree a tre livelli con switch a 32 porte. È possibile utilizzare questo calcolatrice gratuita per reti Clos che genera anche lo schema di visualizzazione per la configurazione selezionata.È possibile calcolare che se lo schema di rete fat-tree ha 2 livelli e 8 porte per switch, è possibile collegare 32 host alla rete. Se si aumenta il numero di porte per switch, il numero di host supportati aumenta a 512. Come si può vedere, il numero di host collegati dipende dal numero di porte su ciascuno switch. Se si lascia il fat tree a 2 livelli (la rete Clos a 3 stadi) e si aumenta il numero di porte per switch, il numero di spine aumenta in modo significativo. È possibile risolvere questo problema aggiungendo un altro livello al fat tree. Per un fat tree a tre livelli, se il numero di porte per switch è 8, è possibile collegare 128 host. Se aumenti il numero di porte per switch a 32, puoi collegare 8192 host utilizzando questa topologia di rete. Questo numero per la rete Clos a 5 stadi è 16 volte superiore a quello della rete Clos a 3 stadi. Tenete presente i limiti del rack del server quando pianificate lo schema di installazione dei server e delle apparecchiature di rete nel data center.Per costruire reti Clos non bloccanti si utilizzano numeri dispari di stadi (3, 5, 7, ecc.). La rete Clos a 2 stadi non fornisce connettività non bloccante e connessioni multiple tra gli switch.Nel diagramma seguente, è possibile vedere che nel caso della rete Clos a due stadi, esiste un solo percorso di trasmissione per connettere il Server 1 e il Server 2. Solo ¼ delle porte sono connesse, le altre porte non sono connesse e bloccano il passaggio.

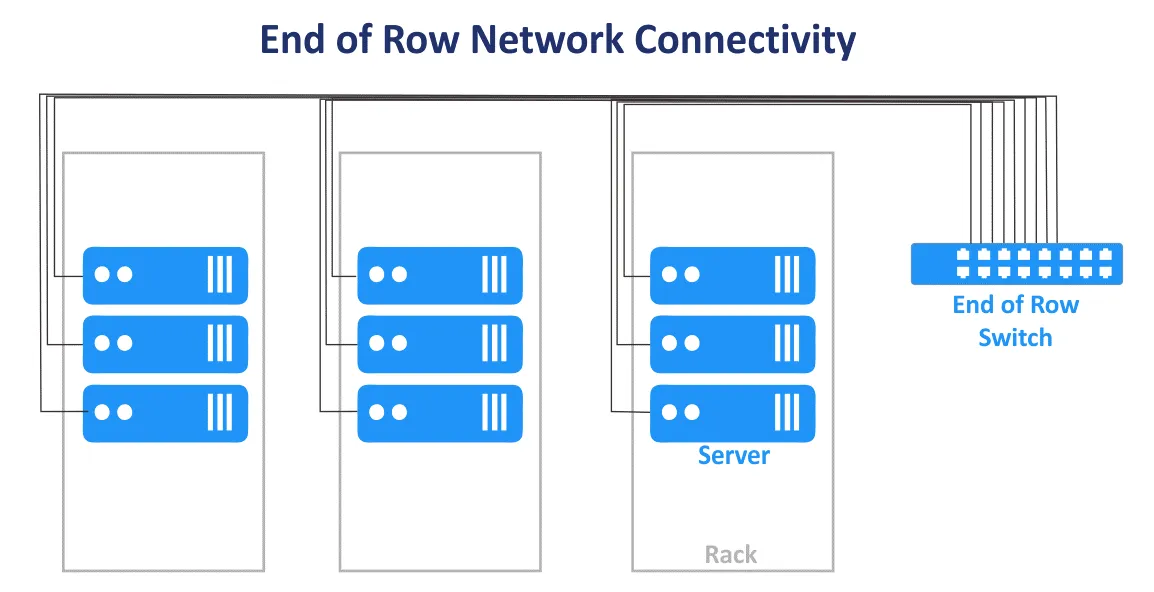

Se aumenti il numero di porte per switch a 32, puoi collegare 8192 host utilizzando questa topologia di rete. Questo numero per la rete Clos a 5 stadi è 16 volte superiore a quello della rete Clos a 3 stadi. Tenete presente i limiti del rack del server quando pianificate lo schema di installazione dei server e delle apparecchiature di rete nel data center.Per costruire reti Clos non bloccanti si utilizzano numeri dispari di stadi (3, 5, 7, ecc.). La rete Clos a 2 stadi non fornisce connettività non bloccante e connessioni multiple tra gli switch.Nel diagramma seguente, è possibile vedere che nel caso della rete Clos a due stadi, esiste un solo percorso di trasmissione per connettere il Server 1 e il Server 2. Solo ¼ delle porte sono connesse, le altre porte non sono connesse e bloccano il passaggio. Il rapporto di sovrasottoscrizione è il rapporto tra la larghezza di banda in ingresso e quella in uscita nella direzione dagli strati inferiori a quelli superiori. Il rapporto di oversubscription varia solitamente da 2 a 4.Esempio: uno switch ha 48 porte da 10 Gbit e 4 porte uplink da 40 Gbit. La larghezza di banda totale dei downlink verso i server è 48×10=480 Gbit/s. La velocità totale degli uplink è 4×40=160 Gbit/s. Il rapporto di oversubscription è 480/160=4.Se la velocità totale della larghezza di banda è uguale per tutte le porte downlink e uplink dello switch, lo switch non è oversubscribed e in questo caso non ci sono colli di bottiglia. Un rapporto di oversubscription 1:1 è il caso ideale. Stimare il traffico in diverse direzioni prima di acquistare switch con la velocità e il numero di porte appropriate.Gli switch con un rapporto di oversubscription superiore a 1 sono spesso utilizzati nella fase leaf nelle reti con topologia leaf-spine. Gli switch non sovrascritti dovrebbero essere utilizzati nella fase spine. Gli switch a livello leaf nella topologia di rete leaf-spine sono solitamente utilizzati come switch ToR. Tuttavia, è possibile installare switch leaf come switch End of Row.

Il rapporto di sovrasottoscrizione è il rapporto tra la larghezza di banda in ingresso e quella in uscita nella direzione dagli strati inferiori a quelli superiori. Il rapporto di oversubscription varia solitamente da 2 a 4.Esempio: uno switch ha 48 porte da 10 Gbit e 4 porte uplink da 40 Gbit. La larghezza di banda totale dei downlink verso i server è 48×10=480 Gbit/s. La velocità totale degli uplink è 4×40=160 Gbit/s. Il rapporto di oversubscription è 480/160=4.Se la velocità totale della larghezza di banda è uguale per tutte le porte downlink e uplink dello switch, lo switch non è oversubscribed e in questo caso non ci sono colli di bottiglia. Un rapporto di oversubscription 1:1 è il caso ideale. Stimare il traffico in diverse direzioni prima di acquistare switch con la velocità e il numero di porte appropriate.Gli switch con un rapporto di oversubscription superiore a 1 sono spesso utilizzati nella fase leaf nelle reti con topologia leaf-spine. Gli switch non sovrascritti dovrebbero essere utilizzati nella fase spine. Gli switch a livello leaf nella topologia di rete leaf-spine sono solitamente utilizzati come switch ToR. Tuttavia, è possibile installare switch leaf come switch End of Row.

Differenze essenziali

Quando si crea una rete, alcune decisioni influiscono sulla sua configurazione. Ecco alcune decisioni alternative che influiscono sulla funzionalità della rete.

Parte superiore del rack vs estremità della fila

Il Parte superiore del rack Lo schema di connessione di rete ToR (Top of Rack) in un data center prevede l’installazione di uno o più switch in ogni rack. Per collegare la parte superiore dello switch del rack con altre apparecchiature di rete e server all’interno del rack vengono utilizzati cavi patch corti. Gli switch ToR dispongono solitamente di uplink ad alta velocità verso gli switch/router di livello superiore e possono essere collegati con cavi in fibra ottica. Il vantaggio è che, quando si utilizza questo schema di connessione per una rete MSP, non è necessario installare una grande quantità di cavi da ogni rack nel data center. L’utilizzo dei cavi nel data center è più razionale quando si utilizza lo schema ToR. In questo caso, si spende meno per il cablaggio e si ha una migliore gestione dei cavi. È possibile gestire ogni rack come un singolo modulo senza influire sugli altri rack all’interno di un data center, poiché sono interessati solo i server di un unico rack. Nonostante il nome dello schema, è possibile montare uno switch al centro o nella parte inferiore di ogni rack. Il Fine della riga Lo schema di connessione di rete EoR (End of Row) prevede che un rack server all’estremità della fila contenga le apparecchiature di rete. Le apparecchiature includono uno switch di rete comune per collegare tutti i server e gli altri dispositivi di tutti i rack server della fila. I cavi delle apparecchiature di rete installate nel rack server EoR sono collegati ai dispositivi di tutti i rack della fila tramite pannelli di permutazione montati in ciascun rack. Di conseguenza, per collegare tutti i dispositivi di rete di una fila vengono utilizzati cavi lunghi. Se si utilizzano connessioni di rete ridondanti, aumenta anche il numero di cavi. I cavi ingombranti possono ostacolare l’accesso dell’aria alle apparecchiature.I rack server sono solitamente disposti in file affiancate in un data center. Una fila può contenere, ad esempio, 10 o 12 rack. L’intera fila è considerata una singola unità di gestione quando si utilizza lo schema di connessione EoR per la rete MSP in un data center. In questo caso viene utilizzato il modello di gestione per fila. Nel modello di connessione di rete EoR sono necessari meno switch individuali. La flessibilità è inferiore quando è necessario eseguire la manutenzione o l’upgrade degli switch, poiché quando uno switch EoR viene scollegato sono interessati più dispositivi. Nonostante il nome, un rack con uno switch (o switch) comune può essere posizionato al centro della fila.

Il Fine della riga Lo schema di connessione di rete EoR (End of Row) prevede che un rack server all’estremità della fila contenga le apparecchiature di rete. Le apparecchiature includono uno switch di rete comune per collegare tutti i server e gli altri dispositivi di tutti i rack server della fila. I cavi delle apparecchiature di rete installate nel rack server EoR sono collegati ai dispositivi di tutti i rack della fila tramite pannelli di permutazione montati in ciascun rack. Di conseguenza, per collegare tutti i dispositivi di rete di una fila vengono utilizzati cavi lunghi. Se si utilizzano connessioni di rete ridondanti, aumenta anche il numero di cavi. I cavi ingombranti possono ostacolare l’accesso dell’aria alle apparecchiature.I rack server sono solitamente disposti in file affiancate in un data center. Una fila può contenere, ad esempio, 10 o 12 rack. L’intera fila è considerata una singola unità di gestione quando si utilizza lo schema di connessione EoR per la rete MSP in un data center. In questo caso viene utilizzato il modello di gestione per fila. Nel modello di connessione di rete EoR sono necessari meno switch individuali. La flessibilità è inferiore quando è necessario eseguire la manutenzione o l’upgrade degli switch, poiché quando uno switch EoR viene scollegato sono interessati più dispositivi. Nonostante il nome, un rack con uno switch (o switch) comune può essere posizionato al centro della fila.

Connessione Layer 2 vs Layer 3

Decidere le connessioni all’interno di una rete è un calcolo che coinvolge affidabilità, velocità e costi, oltre alla topologia che si sta creando.Ad esempio, esistono segmenti di rete per la topologia di rete a tre livelli Access-Aggregation-Core e la topologia Leaf-Spine. In questo caso, il traffico viene trasferito sul modello OSI L2 e L3. Nella rete gerarchica a tre livelli, il livello di accesso opera su L2, il livello di distribuzione/aggregazione aggrega i collegamenti L2 e fornisce il routing L3, mentre il livello di rete centrale esegue il routing sul terzo livello del modello OSI. La rete della topologia Leaf-Spine a più livelli può essere configurata utilizzando L2 con VLAN e L3 con routing IP e sottoreti.Le apparecchiature di rete L2 sono più convenienti rispetto a quelle L3, ma l’utilizzo della rete L2 per connettere i dispositivi di rete nella rete MSP di un data center presenta alcuni svantaggi. Le VLAN vengono solitamente utilizzate per isolare logicamente le reti che utilizzano lo stesso ambiente fisico. Il numero massimo di VLAN è 4095 (meno alcune VLAN riservate come 0, 4095, 1002-1005).Un altro svantaggio, come accennato in precedenza, è l’impossibilità di utilizzare collegamenti ridondanti quando si utilizza STP su L2. Questo perché solo un collegamento può essere attivo alla volta e non viene utilizzata tutta la larghezza di banda disponibile di tutti i collegamenti. Quindi il dominio L2 con STP diventa grande, aumenta la probabilità di problemi causati da un cablaggio improprio e da errori umani e la risoluzione dei problemi diventa difficile.Una configurazione di rete L3 consente agli ingegneri di migliorare la stabilità e la scalabilità della rete MSP e delle reti dei data center in generale.I seguenti protocolli di rete aiutano a gestire la rete L3 e a instradare il traffico.Il BGP (Border Gateway Protocol) è un protocollo per il routing dinamico ampiamente utilizzato e considerato lo standard in molte organizzazioni con data center su larga scala. Il BGP è un protocollo altamente scalabile, estendibile ed efficiente.L’ECMP (Equal Cost Multipath Routing) è una tecnologia di routing di rete utilizzata per distribuire il traffico utilizzando più percorsi ottimali definiti da metriche sul terzo livello del modello OSI. L’ECMP con protocolli di routing viene utilizzato per il bilanciamento del carico in reti di grandi dimensioni. La maggior parte dei protocolli di routing, inclusi BGP, EIGRP, IS-IS, OSPF, supportano la tecnologia ECMP.Cercate sempre di utilizzare i protocolli di rete più avanzati. Ricordate però che meno protocolli vengono utilizzati nella rete, più comoda sarà l’amministrazione della rete.

Topologia di rete per NV e SDN

Oltre alla virtualizzazione hardware e all’utilizzo di VM, anche la virtualizzazione di rete con un approccio incentrato sulle applicazioni è diventata popolare. Le soluzioni di virtualizzazione di rete (NV) come VMware NSX, OpenStack networking e Cisco ASI utilizzano intensivamente il traffico est-ovest nella rete fisica e, per questo motivo, una topologia di rete leaf-spine è adatta alle soluzioni di virtualizzazione di rete. Leggi il post sul blog dedicato a VMware NSX Per scoprire di più sulla virtualizzazione di rete.Il Software-defined networking (SDN) viene utilizzato per virtualizzare le reti al fine di garantire un utilizzo efficace delle risorse, flessibilità e amministrazione centralizzata. Si tratta di una soluzione ottimale in un data center virtualizzato in cui vengono utilizzate VM connesse alla rete. Le VM possono migrare tra i server, creando così traffico est-ovest all’interno del data center. L’SDN è ampiamente utilizzato per le reti MSP dai fornitori di servizi gestiti (MSP) che offrono IaaS (infrastruttura come servizio).La configurazione delle reti definite dal software è efficace quando si utilizza la topologia di rete leaf-spine sottostante con routing dinamico, un numero fisso di hop, bassa latenza prevedibile e ottimizzazione del traffico est-ovest per la comunicazione da server a server in un data center.

VXLAN

VXLAN (Virtual eXtensible Local Area Network) è un protocollo di rete migliorato utilizzato al posto della VLAN nelle reti overlay. I tunnel L2 vengono creati utilizzando le reti L3 sottostanti (rete L3 underlay) per fornire connettività di rete L2 senza le tradizionali limitazioni della VLAN. Con VXLAN è possibile configurare la rete L2 sulla rete L3. La topologia virtuale potrebbe essere diversa dalla topologia di rete fisica della rete sottostante.I frame VXLAN vengono incapsulati in pacchetti IP utilizzando lo schema di incapsulamento MAC-in-UDP. VNI è l’equivalente dell’ID VLAN. Il numero massimo di VNI è 2^24, ovvero circa 16 milioni. VXLAN viene utilizzato per creare reti L2 in ambienti geograficamente estesi, ad esempio quando è necessario creare una rete tra due data center distribuiti geograficamente.L’utilizzo di VXLAN e della virtualizzazione di rete aiuta a ottimizzare le dimensioni della tabella degli indirizzi MAC per gli switch ToR. Questo perché gli indirizzi MAC utilizzati dalle VM e il traffico L2 correlato vengono trasferiti tramite la rete overlay L2 utilizzando VXLAN. Non sovraccaricano le tabelle MAC degli switch fisici. Le tabelle degli indirizzi MAC degli switch fisici non superano la capacità massima disponibile degli switch.

Conclusione

Tradizionalmente, le reti nei data center venivano costruite utilizzando la classica topologia a tre livelli di accesso-aggregazione-core. Data l’evoluzione delle moderne applicazioni client-server e distribuite, dei microservizi e di altri software che sono fonti di traffico est-ovest all’interno delle reti MSP, la topologia di rete leaf-spine, basata sul concetto di rete Clos, è preferita nei moderni data center ed è una delle topologie di rete più comuni. La topologia di rete leaf-spine è la migliore topologia di rete per i data center di grandi dimensioni perché è altamente affidabile e scalabile. Prima di installare una rete in un data center, effettuare i calcoli e stimare il traffico e i carichi di lavoro generati. Tenere conto del traffico di servizio, come il traffico di backup e replica nella rete.NAKIVO Backup & Replication è un potente software di backup per macchine virtuali in grado di proteggere i carichi di lavoro VMware Cloud Director, le macchine virtuali VMware, le macchine virtuali Hyper-V, nonché le macchine fisiche Linux e Windows e l’Oracle Database. I fornitori di servizi gestiti che offrono infrastruttura come servizio (IaaS), backup come servizio (BaaS) e DRaaS possono utilizzare NAKIVO Backup & Replication installato in modalità multi-tenant. Scarica la prova gratuita di NAKIVO Backup & Replication per MSP che fornisce il supporto per la modalità di installazione multi-tenant.